为什么压缩文件压缩后大小不变呢?为什么zip压缩后大小没变呢?有以下几个原因,检查手里的压缩文件格式,有些文件格式已经是有损压缩算法,比如视频里的MP4格式、图片里的jpg格式以及音频里的MP3格式,如果这个时候还使用压缩包格式尤其是zip压缩包格式,那么对文件体积当然不会有明显的变小,首先压缩包格式本身便是一种无损压缩格式,解压缩即可恢复到原有的文件大小,其次zip压缩包格式压缩级别较小,可以更改为高压缩率的7z格式。其次我们可以使用文件有损压缩工具对不同的文件进行分类压缩,在人眼不易察觉的范围内进行压缩,这种方法可以大大降低文件体积。下面就向大家介绍如何有效的压缩文件体积大小的具体步骤。

方法一:分类压缩+压缩包压缩

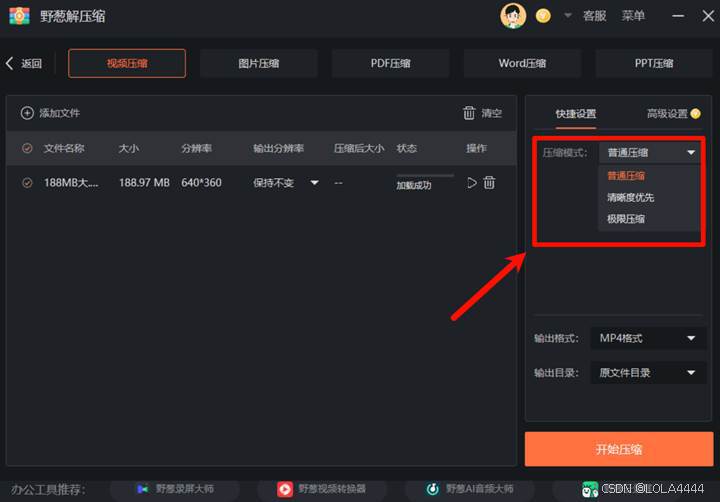

1、野葱解压缩

以视频压缩为例,我们可以先使用有损压缩将文件压缩到一个合适的大小,然后再选择使用压缩包格式进行二次压缩,选择压缩包格式也有技巧,相比zip格式,7z 格式是一种压缩率很高的格式,压缩率一般在 20% - 50% 左右。下面是具体的操作步骤:

步骤1,打开软件界面,可以看到分为上下两类压缩类型,不仅支持一键解压缩,还支持对视频、图片、PDF、Word、PPT文件进行分类压缩。我们先选择【文件大小压缩】里的【视频压缩】功能。

步骤2,选择合适的【压缩模式】,普通压缩(约20%)、清晰度优先(约10%)、极限压缩(约50%)。

步骤3,压缩完成后,返回到主界面,二次压缩,点击【一键压缩】

步骤4,在【压缩偏好】中,选择【自定义】,选择目标格式为【7z】,压缩方式为【体积更小】,最后点击立即压缩即可。

方法二:有损压缩类工具

2、SmallPDFs(压缩PDF)

特点:在线操作,无需安装软件,支持多种设备访问。可自动优化图片质量,去除不必要的元数据,有效减小文件体积,且不影响文档的可读性。对 PDF 文件兼容性好,能保持原有格式和排版。

步骤:打开 SmallPDFs 官网,选择 “压缩 PDF” 选项,上传目标文件,系统自动压缩,压缩完成后点击下载按钮,将压缩后的文件保存到本地。

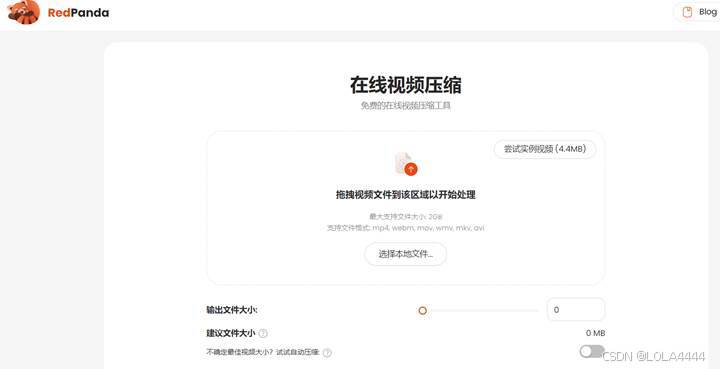

3、Red panda compress(压缩视频)

特点:在线转换平台,无需下载软件,操作便捷。压缩处理后的视频无水印,但压缩选项有限。支持 MP4、WebM、MOV、WMV 等格式,最大支持 2GB 文件。

步骤:在浏览器搜索进入网站,上传待压缩的视频文件,通过拖动进度条或手动调整设置输出文件的大小,点击 “开始压缩”,完成后下载压缩后的文件。

4、TinyPNG(压缩图片)

特点:采用智能有损压缩技术,能在保留图像质量的同时大幅减小文件大小。支持 PNG、JPEG 等常见图片格式,压缩速度快,效果好。可批量上传图片,且提供下载链接。

步骤:打开 TinyPNG 官方网站,将需要压缩的图片拖动到网站页面中,或点击 “选择文件” 按钮上传,上传完成后自动压缩,显示压缩后的文件大小和压缩比例,点击 “下载全部” 按钮保存压缩后的图片。

类型三:无损压缩类工具

5、360压缩(win端/mac端)

特点:兼容 42 种压缩文件格式,解压速度快,内置木马云查杀功能,保护电脑安全。

步骤:可通过右键菜单,选中文件后,选择【添加到压缩文件…】,设置好选项,点击【立即压缩】;也可打开软件主界面,点击【添加】图标,设置选项后点击【立即压缩】。

6、keka(mac端)

特点:操作简便:无需打开软件,将文件拖放到 Dock 上的 Keka 图标即可压缩,也可打开软件将文件拖入窗口进行压缩。支持加密压缩、分卷压缩,还可设置压缩级别,满足不同需求。

压缩步骤:打开 Keka,选择要压缩的文件或文件夹拖放到 Keka 窗口,选择压缩格式,如 7z、zip 等,设置压缩级别、密码等选项,点击 “压缩” 按钮,压缩后的文件将保存在原文件所在位置。

总结

以上就是为什么压缩后大小没变化的原因啦,以及如何把文件尽可能的压缩变小的方法,因为有些文件格式已经是有损压缩算法,我们可以使用文件有损压缩工具对不同的文件进行分类压缩,在人眼不易察觉的范围内进行压缩,或者更换压缩包格式为7z格式,可以有效减小文件的体积。

1028

1028

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?