前语

之前写过三篇和Scikit-Learn相关的内容,现在回来填坑了~~

不过和之前是主要翻译官方文档的工作不同的是,从这次开始,会更加像一个技术手札,而不是翻译了:

之前主要说了一个最简单的聚类方式:基于邻居的聚类,对应的,今天就聊一聊最简单的回归:线性回归。

Linear Regression

首先,我们要做的任务是什么呢?我也是初学者,所以就不正式的直接饮用其文档的内容了:

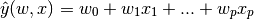

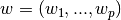

大致就是如上的工作,我们要通过给定的训练数据训练出相关的系数w,使得在给定x的时候,能预测出一个值y

在Linear Regression当中,就是需要求解这样一系列的系数

残差平方和:为了明确解释变量和随机误差各产生的效应是多少,统计学上把数据点与它在回归直线上相应位置的差异称为残差,把每个残差平方之后加起来 称为残差平方和,它表示随机误差的效应。

每一点y的估计值与实际值之差的平方之和称为残差平方和,而y的实际值和平均值的差的平方之和称为总平方和。

简单来说,一组数据的残差平方和越小,其拟合程度越好。

本文介绍了线性回归的基本概念和在Scikit-Learn中的应用。通过训练数据,利用线性回归求解最小残差平方和的系数,以实现对给定输入x的y值预测。示例中展示了如何生成带有噪声的数据并进行线性回归训练,从而得到理想的预测结果。

本文介绍了线性回归的基本概念和在Scikit-Learn中的应用。通过训练数据,利用线性回归求解最小残差平方和的系数,以实现对给定输入x的y值预测。示例中展示了如何生成带有噪声的数据并进行线性回归训练,从而得到理想的预测结果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1637

1637

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?