本文仅作学习分享

摘要

- 本文的核心:单张RGB图像 → 估计高质量稠密深度图

- 本文的工作流程:一个基线编码解码卷积网络+基于transformer的架构块block,

- 核心:AdaBins,将深度范围划分为bins,其中心值为自适应估计每张图像;最终的深度值是bin center的线性组合。

介绍

- 计算机视觉领域的经典问题:输入单张RGB图像→估计其高质量稠密深度图。

- 本文动机:推测当前的架构对输出值没有作足够的全局分析;卷积层处理全局信息条件苛刻。

- 工作概述:坚信全局处理对高分辨率影响效果显著;因而,对传统编码解码器输出的图像进行全局统计分析,并利用一个在高分辨率情况下学习的后处理构建块以优化输出图;进而分析和修整深度的分布值。

- 不同RGB输入对应的深度分布会有很大的不同——深度直方图

- 本文研究:一种网络学习自适应方法,关注于输入图像场景中更容易出现深度范围的区域。

相关工作

单眼深度估计、编码解码、Transformer

方法

动机:前人的工作,建议将深度范围划分为确定宽度的固定数量的bin,其有所限制。作者想将其进一步泛化:首先,提出计算根据输入场景的特征动态变化的自适应容器;其次,分类方法会导致深度值离散化,导致视觉质量差,深度不连续现象明显,预测的最终深度值作为一个线性组合的bin中心;因而能够将分类的优点与深度图回归的优点结合起来。

AdaBins细节:4种架构选择,bins→fixed/trained;bins width→fixed/trained

重点分析:

- 前人工作:encoder - attention - decoder;

- 本文工作:encoder - decoder - attention;

- 工作原因:在空间分辨率更高的张量上使用注意力可以获得更好的结果。

- 两个版块:an encoder-decoder block + AdaBins Module

An encoder-decoder block AdaBins Module a pre-trained EfficientNet B5 encoder GPU硬件限制,输入H/2 W/2 a standard feature upsampling decoder 模块1输出的仅为 a tensor -decoded features

基于[1]的网络,修改:

1.EfficientNet B5

2.a diffierent loss function

见详细介绍

Mini-ViT 估计深度范围的子区间,给定的图像同时需要局部架构信息和全局分布信息

如果利用全局attention——计算bin widths vector——昂贵、复杂

灵感:vision transformers获取bin width

Bin-widths 基于transformers需要解决:

mViT:接收的是a tensor of decoded features

transformer:需要的输入是a sequence of fixed size vectors

方案:利用一个卷积块(Conv p × p),得到a tensor of size (h/p × w/p × E)

Transformer patch embeddings + learned positional encodings → input transformer Range attention maps transformer → Bin Widths & 更多的全局信息

keys:计算点积的注意力权重之间的像素特征

Queries : transformer输出嵌入

则网络将来自transformer的自适应全局信息集成到解码特征的局部信息中。

final depth → 全局信息 R + 局部信息 b

Hybrid regression R:a softmax activation → obtain N-channels

c(b):bin中心深度

depth=该像素处的Softmax分数与深度bin中心c(b)的线性组合

估计最有可能的bin的中心vs 估计所有bin中心的线性组合,能够预测平滑的深度图,而不需要离散的伪影。

Loss function Pixel-wise depth loss Bin-center density loss,

损失函数&度量指标:

| SI Scale-Invariant loss | 尺度不变损失YES | 像素深度损失 |

| bi-directional chamfer loss | 双向槽损失YES | Bin中心稠密损失 |

| L1 loss & LAD & LAE | L1范数损失函数 | 把目标值与估计值的绝对差值的总和最小化 |

| RMSE Root Mean Square Error | 均方根误差 | 衡量观测值与真实值之间的偏差 |

| SSIM structural similarity index | 结构相似性指数 | 度量两幅图像间的结构相似性 |

| REL average relative error | 平均相对误差 | 反映测量的可信度 |

| Sq.Rel squared Relative difference | 相对差平方平均误差 | |

| average( | 平均( | |

| threshold accuracy ( | 阈值准确性 |

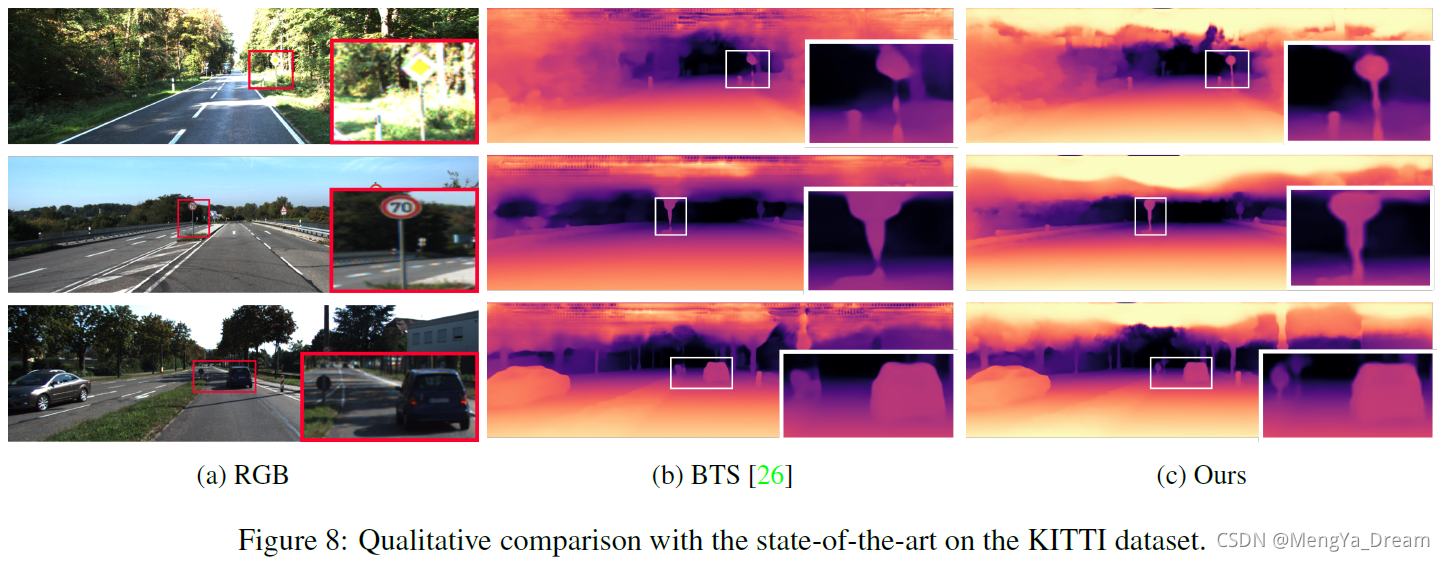

实验

数据集、度量指标、与最新技术相比、消融实验

总结

- 本文重点:AdaBins(CNN+Transformer)

- 期望:研究在高分辨率的信息全局处理是否也可以提高其他任务的性能,如分割,正常估计,和多图像的三维重建。

146

146

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?