麻雀算法算法SSA优化LSTM实现多维输入,单维输出的预测模型,代码内注释详细,可学习性强,直接替换数据就可以用。

SSA-LSTM模型预测。

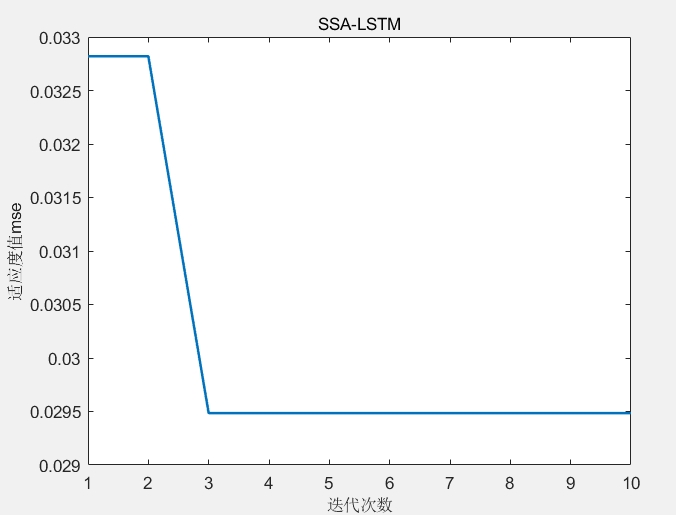

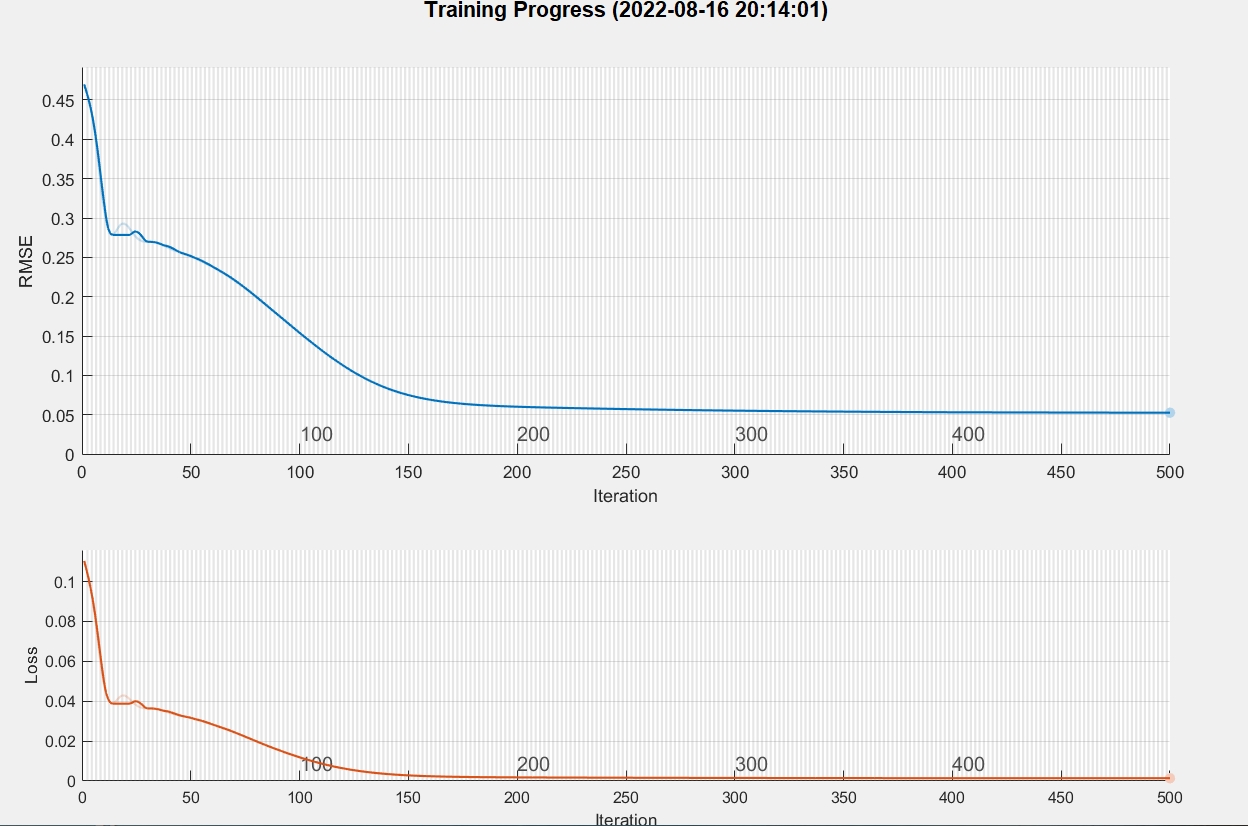

优化参数为学习率,隐藏层节点个数,正则化参数。

多输入单输出预测模型,matlab

ID:3630681022881952

傲ptp

麻雀算法在优化LSTM模型中的应用

摘要:在深度学习领域,长短期记忆(LSTM)模型已经在多个领域中取得了显著的成果。然而,传统的LSTM模型在处理多维输入、单维输出的预测问题上存在一定的局限性。本文提出

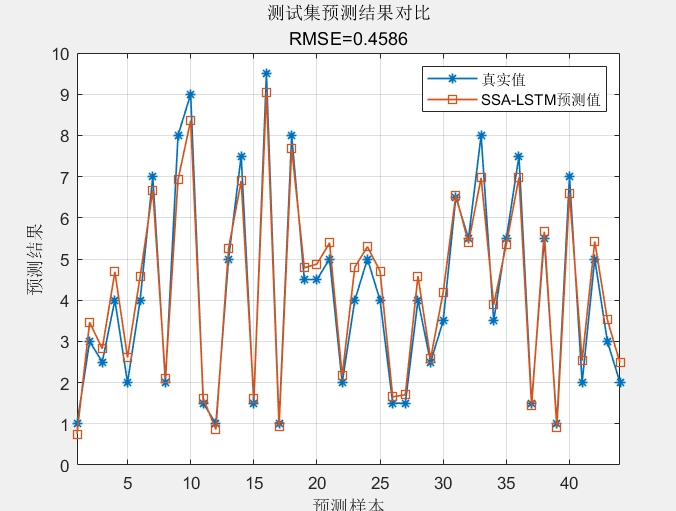

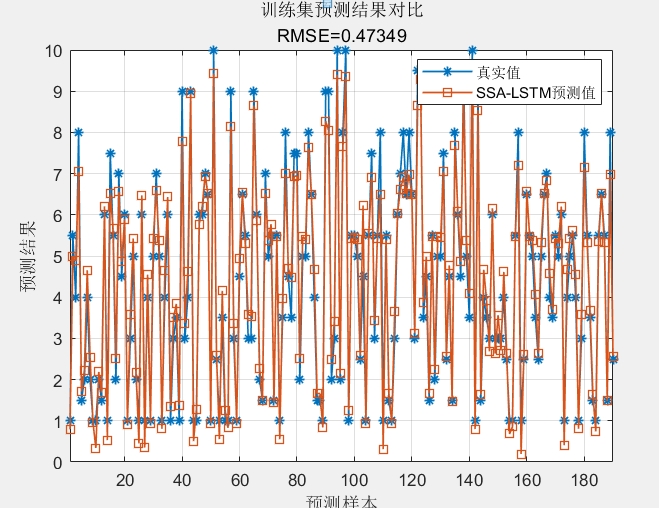

本文介绍了一种利用麻雀算法优化的LSTM模型,用于处理多维输入单维输出的预测问题。通过调整学习率、隐藏层节点和正则化参数,提升模型预测性能,并提供Matlab实现代码供学习者参考。

本文介绍了一种利用麻雀算法优化的LSTM模型,用于处理多维输入单维输出的预测问题。通过调整学习率、隐藏层节点和正则化参数,提升模型预测性能,并提供Matlab实现代码供学习者参考。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

353

353

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?