Handling Information Loss of Graph Neural Networks for Session-based Recommendation

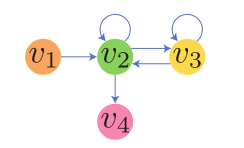

本篇文章也是使用图神经做推荐,主要解决两个问题,第一个问题是有损的session编码问题,由于从session到图的有损编码以及消息传递期间的排列不变聚合,因此会忽略有关item转换的某些顺序信息,针对第一个问题举个栗子,比如两个不同的session,[v1,v2,v3,v3,v2,v2,v4]和[v1,v2,v2,v3,v3,v2,v4],按照传统的构建图的方法,两个session就会构建成同一个图(如下图所示),这就使得用图结构的数据重构session时,得到的session可能不是唯一的,这样就有可能影响预测的准确性。

第二个问题是无效的长期依赖捕捉问题,由于层数的限制,因此无法捕获会话中的某些远程依赖。在使用GNN时,一层GNN只能捕获一层的邻居信息,两层可以捕获两层的邻居信息,但是如果层数过多的话,就会有可能出现过拟合或者过光滑的问题,一般的论文模型中的GNN层数设置为3层,但是有的邻居信息远大于设置的层数,这样也会影响最终的推荐效果。

为了解决第一个问题,本文提出无损的编码模式和基于GRU的边序保留聚合层(EOPA),为了解决第二个问题 ,本文提出了快捷图注意层(SGAT),通过快捷连接,有效的捕获长期依赖。该论文的模型如下:

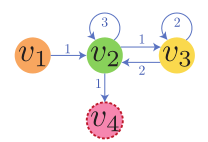

首先,将session转换为图结构数据,以便使用GNN,本论文首先将引入S2MG将session转换为边序保多图(EOP),是一个带有权重的有向图,权重是在session中转换u–>v(u和v都是item)出现的次数,这样的话,从session到图就会形成一对一的映射,这样就可以解决第一个问题即信息的编码损失问题,EOP图如下:

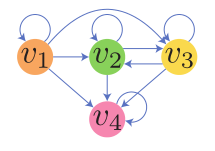

为了解决在现有的基于session的推荐模型中无效的长期依赖问题,使用S2SG模型将session转换为快捷图,之所以叫做快捷图,是因为它连接item而且不需要中间的item,这样就可以解决因为GNN层数的限制而引起的第二个问题,即无效的长期依赖问题,假设一个session s1 = [v1, v2, v3, v3, v2, v2, v4],构建的快捷图如下图所示:

接下来我们介绍两个层,分别是边序保留聚合层(EOPA层)和快捷图注意力层(SGAT层)

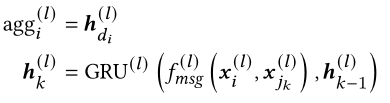

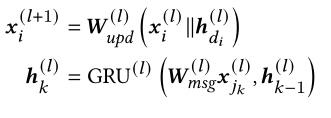

EOPA层主要是使用GRU聚合从邻居节点传播来的信息,公式如下:

考虑到GRU具有强大的表达能力,我们仅对消息和更新函数都使用了线性变换,因此把所有内容放在一起,模型EOPA层的定义如下:

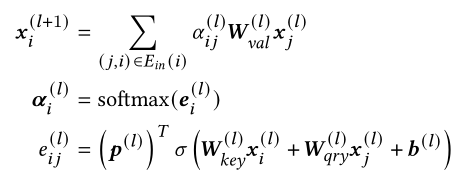

一般来说每层只能传播一跳的信息,因此一层只能捕获节点一跳的关系,为了解决多层GRU引起的过拟合或者过光滑问题,引入SGAT层,它本质上是用使用S2SG获得的快捷图中的边快速进行信息传播,具体来说就是SGAT层使用以下注意力机制沿着快捷图中的边缘传播信息,SGAT层可以有效的捕获长期依赖问题,公式如下

这里要注意在模型中将EOPA层和SGAT层交错叠加,原因有如下几点

1、快捷图是原始会话的有损转换,因此连续堆叠多个SGAT层将引入有损会话编码问题。 对于更多的SGAT层,此问题更加严重,因为信息丢失量不断累积。 通过交错EOPA和SGAT层,丢失的信息可以保留在后续的EOPA层中,而SGAT层可以仅专注于捕获远程依赖项。

2、交错两种类型的层的另一个优点是,每种类型的层都可以有效利用另一种类型的层捕获的特征。 由于EOPA层更能捕获本地上下文信息,而SGAT层更能捕获全局依存关系,因此将这两种层进行交织可以有效地结合两者的优势,并提高模型学习更复杂依存关系的能力。

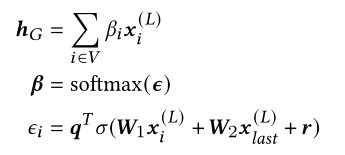

在所有层的消息传递完之后,我们获得了所有节点的item表示,为了获得最终的session表示,应用读出函数,公式如下:

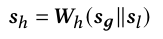

图级的嵌入表示可以捕获当前session中全局的偏好,考虑用户最近的偏好也是非常重要的,将当前sesion中的最后一个item作为用户最近的偏好,引入线性的转换将全局和局部的session偏好组合在一起,公式如下

最后经过打分和softmax函数做出最终的预测,然后进行推荐。

总结,本论文的亮点在于解决有损的sesson编码问题和无效的长期依赖捕获问题,解决的方法主要集中在图的构建上,是一种非常值得借鉴的方法。

647

647

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?