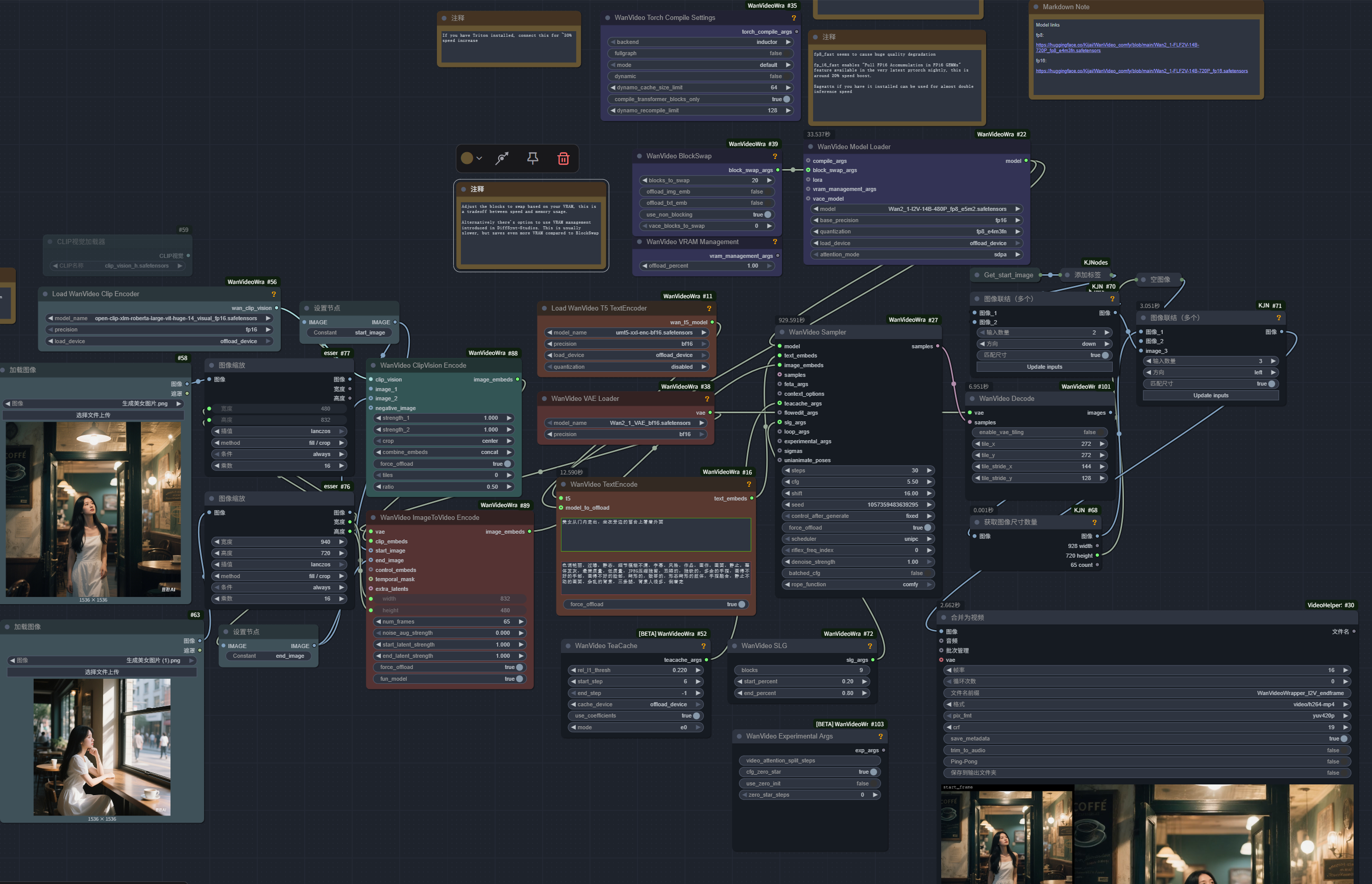

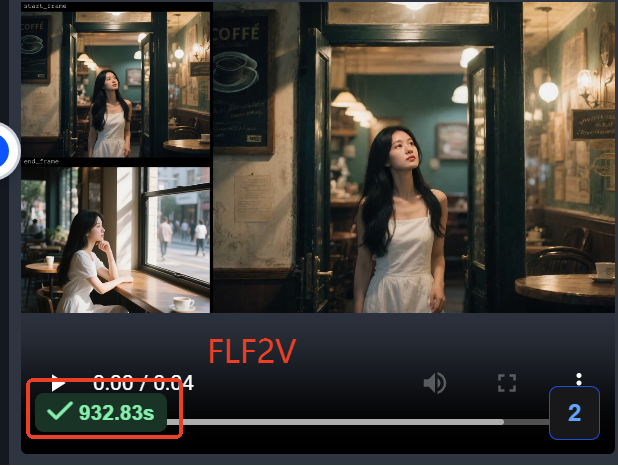

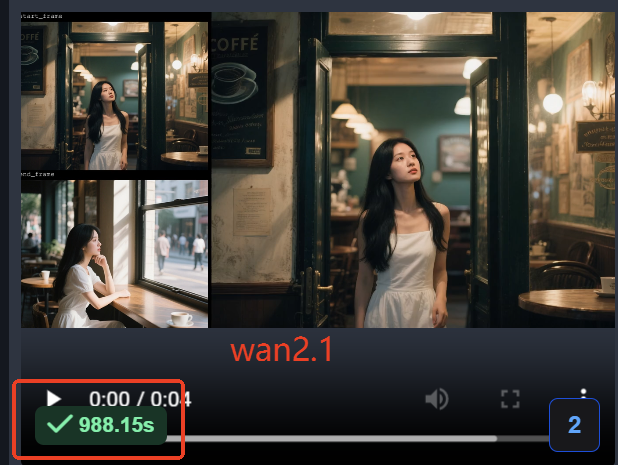

提示词:“美女从门内走出,坐在旁边的窗台上看着外面的人群”

wan2.1模型首尾帧控制

FLF2V首尾帧控制模型

模型下载地址:Wan2_1-FLF2V-14B-720P_fp8_e4m3fn.safetensors · Kijai/WanVideo_comfy at main

所有工作流关注后台私信免费获取,本期点赞评论量高会再出一期工作流拆解教程~

一、核心架构差异

普通Wan2.1模型

- 定位:通用视频生成模型

- 支持任务:文生视频(T2V)、图生视频(I2V)、视频编辑等

- 架构:基于DiT(Diffusion Transformer)架构

- 特点:使用3D因果VAE进行视频压缩,支持多模态输入

FLF2V首尾帧控制模型

- 定位:首尾帧精准控制视频生成

- 核心改进:新增首尾帧条件控制分支

- 机制:通过CLIP提取语义特征,利用交叉注意力注入

- 优势:实现更精准的首尾帧过渡和平滑转换

二、训练数据差异

| 维度 | 普通Wan2.1 | FLF2V |

| 基础数据集 | 大规模多模态数据(1.5亿视频+10亿图像) | 继承基础数据集,增加首尾帧专项数据 |

| 数据增强 | 四步清洗流程(基础/视觉/运动质量) | 额外优化首尾帧过渡的时序逻辑和物理规律 |

| 分辨率训练阶段 | 480P → 720P渐进式提升 | 480P混合任务训练 → 720P高精度专项优化 |

FLF2V在训练阶段特别针对首尾帧控制进行了优化,构建了专门的数据集,并在第二阶段强化了控制能力,使其在首尾帧生成任务上表现更佳。

三、推理效率对比

硬件需求

- 普通Wan2.1: 14B专业版需高端GPU(如A100),生成5秒480P视频约4分钟;1.3B极速版兼容消费级显卡(如RTX 4090,8.2GB显存)

- FLF2V: 14B模型通过模型切分和序列并行策略,显存占用优化20%,生成5秒720P视频约8分钟(单卡),多卡并行可缩短至3分钟

加速技术

- 普通Wan2.1: 采用特征缓存机制,减少33%内存消耗,支持FP8量化和分布式推理加速

- FLF2V: 使用模型分割和序列并行策略,显著缩短推理时间

四、输出质量评估

普通Wan2.1

- 流畅性: 良好,但可能不如FLF2V精准

- 一致性: 较高,支持多模态任务

- 细节复刻度: 中等,适合常规任务

- 分辨率: 支持480P到720P

FLF2V首尾帧控制模型

- 流畅性: 极佳,首尾帧过渡自然

- 一致性: 高,通过条件控制分支实现

- 细节复刻度: 高,动作连贯性好

- 分辨率: 支持720P高清视频

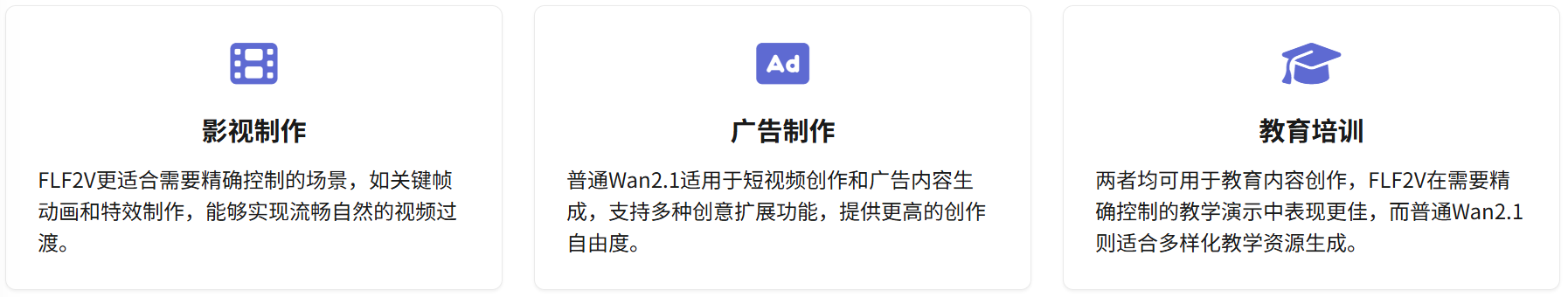

五、应用场景对比

六、局限性与优化方向

阿里Wan2.1系列模型代表了阿里巴巴在视频生成领域的最新成果。普通Wan2.1作为通用视频生成模型,支持多种任务,适合广泛的创意应用场景。而FLF2V首尾帧控制模型则在普通Wan2.1的基础上进行了针对性优化,专注于首尾帧控制,实现了更精准的时序控制和运动轨迹预测。

选择哪个模型取决于具体需求:如果需要精确控制视频的首尾帧过渡,FLF2V是更好的选择;如果需要更广泛的创作自由度和多模态支持,普通Wan2.1可能更适合。

5590

5590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?