贴吧地址 :

http://tieba.baidu.com/f?kw=%E7%94%9F%E6%B4%BB%E5%A4%A7%E7%88%86%E7%82%B8&ie=utf-8

通过对贴吧URl地址进行分析,“utf-8”是编码格式,支持中文。

当我们点击下一页时,url变为:

http://tieba.baidu.com/f?kw=%E7%94%9F%E6%B4%BB%E5%A4%A7%E7%88%86%E7%82%B8&ie=utf-8&pn=50

观察可知:在原网页的基础上+&pn=50 第二页 每一页有50个帖子

&pn=100 第三页

http://tieba.baidu.com/f?kw=%E7%94%9F%E6%B4%BB%E5%A4%A7%E7%88%86%E7%82%B8&ie=utf-8

通过对贴吧URl地址进行分析,“utf-8”是编码格式,支持中文。

当我们点击下一页时,url变为:

http://tieba.baidu.com/f?kw=%E7%94%9F%E6%B4%BB%E5%A4%A7%E7%88%86%E7%82%B8&ie=utf-8&pn=50

观察可知:在原网页的基础上+&pn=50 第二页 每一页有50个帖子

&pn=100 第三页

&pn=50*n 第n-1页

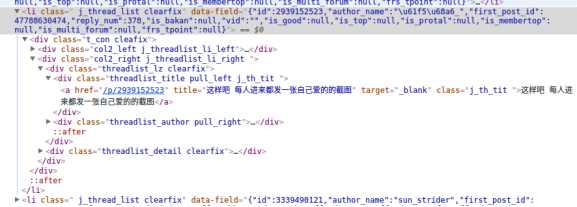

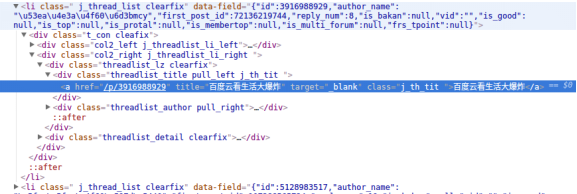

本文介绍了如何使用Python爬虫抓取百度贴吧的数据,包括解析页面结构,获取帖子的标题、作者、回复数和发帖日期,并讨论了爬虫的基本步骤和目标。

本文介绍了如何使用Python爬虫抓取百度贴吧的数据,包括解析页面结构,获取帖子的标题、作者、回复数和发帖日期,并讨论了爬虫的基本步骤和目标。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

538

538

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?