随着互联网的飞速发展,web已经成为人们主要的检索,和发布的主要平台,在海量的数据中如何快速,准确的找到用户所需要的信息成为人们当前所需求的,而网络爬虫就是为了满足这一需要而产生的研究领域。在现实中我们的资源是有限的,如何在有限的资源中区分我们每个人不同的需求,有的想听歌,有的想看电影,而有的是工作需要的机密文件,不想让别人看,只能自己看等等一系列这样的问题,他能保护每个人的隐私以及满足不同人的需求,因此,分不同用户区分爬取内容还是有研究必要的。

在检索信息和搜集信息中实现web信息展示,核心在于设计网络爬虫模块,主要是全文搜索引擎模块。本文主要设计了全文搜索并实现页面搜集器的详细介绍,该工作流程影响到核心算法和数据的存储,克服了该技术难点,实现良好的实际运行和良好的效果,进一步改进引擎效果。anaconda是一个开源的python发行版,现已发行至4.3.0版本,其中默认包含了大量第三方库及其相互依赖的库,完成了多种环境的搭建,其中就包括scrapy的环境。为了避开scrapy复杂的环境配置问题,直接安装已经集成scrapy架构所需要的所有环境的anaconda,完成对scrapy环境的安装。安装完成后,所有所需环境变量已自动配置好,所需的各种python库也已安装成功,可直接开始scrapy项目

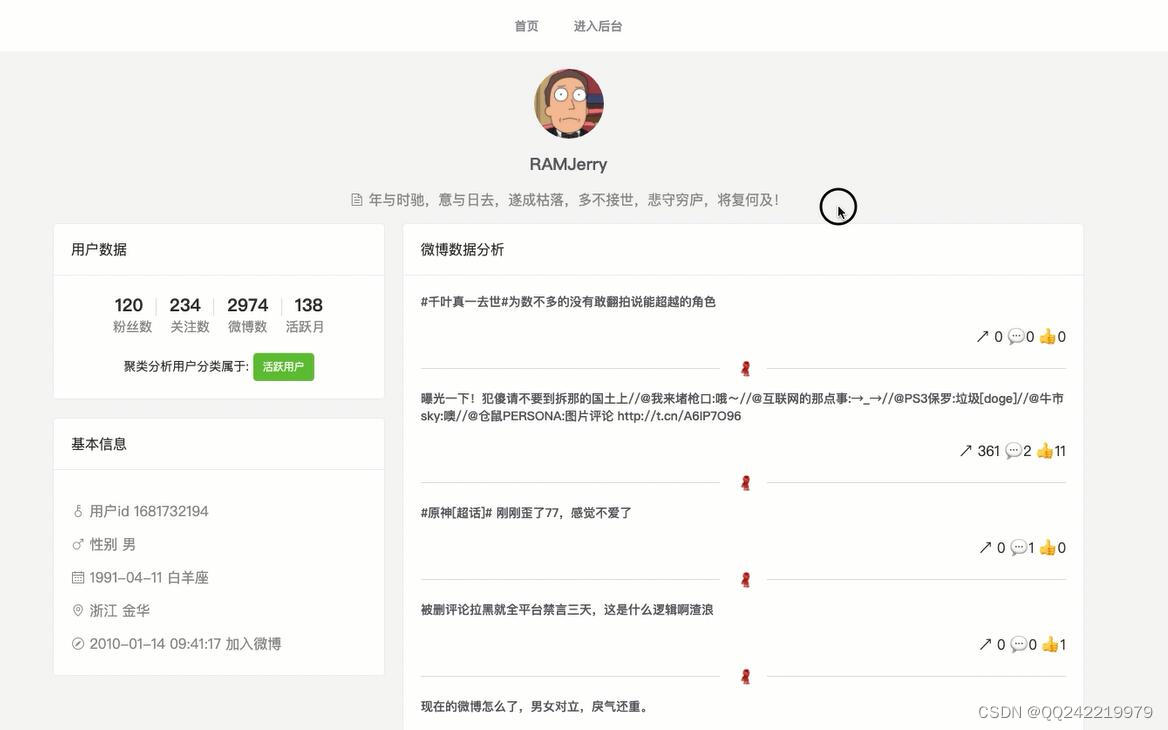

本网站基于B/S模式对该爬虫网站进行设计,并要求爬取的操作简单,多用户数据鲜明,开发一个爬虫网站实现对多用户管理,数据分层管理,并且把数据存储到指定的数据库中。区分出重复的网页,解决去重问题;加上主题的相关性;更快速的抓取数据;存储数据;实现数据可视化。

关键词:数据采集;数据可视化;Scrapy框架

目 录

摘 要 I

Abstract II

目 录 III

第1章 绪 论 1

1.1研究的目的与意义 1

1.1.1研究的目的 1

1.1.2研究的意义 1

1.2国内外研究现状及发展趋势 1

第2章 相关理论及技术 4

2.1可行性分析 4

2.2爬虫 4

2.3python发展现状 9

第3章 系统设计 10

3.1系统体系结构 10

3.2系统功能模块设计 10

第4章 系统实现 13

4.1数据采集模块的实现 13

4.2数据分析与展示模块的实现 13

第5章 系统测试 17

5.1测试方法 17

5.2功能测试 17

结 论 19

参考文献 20

致 谢 21

2739

2739

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?