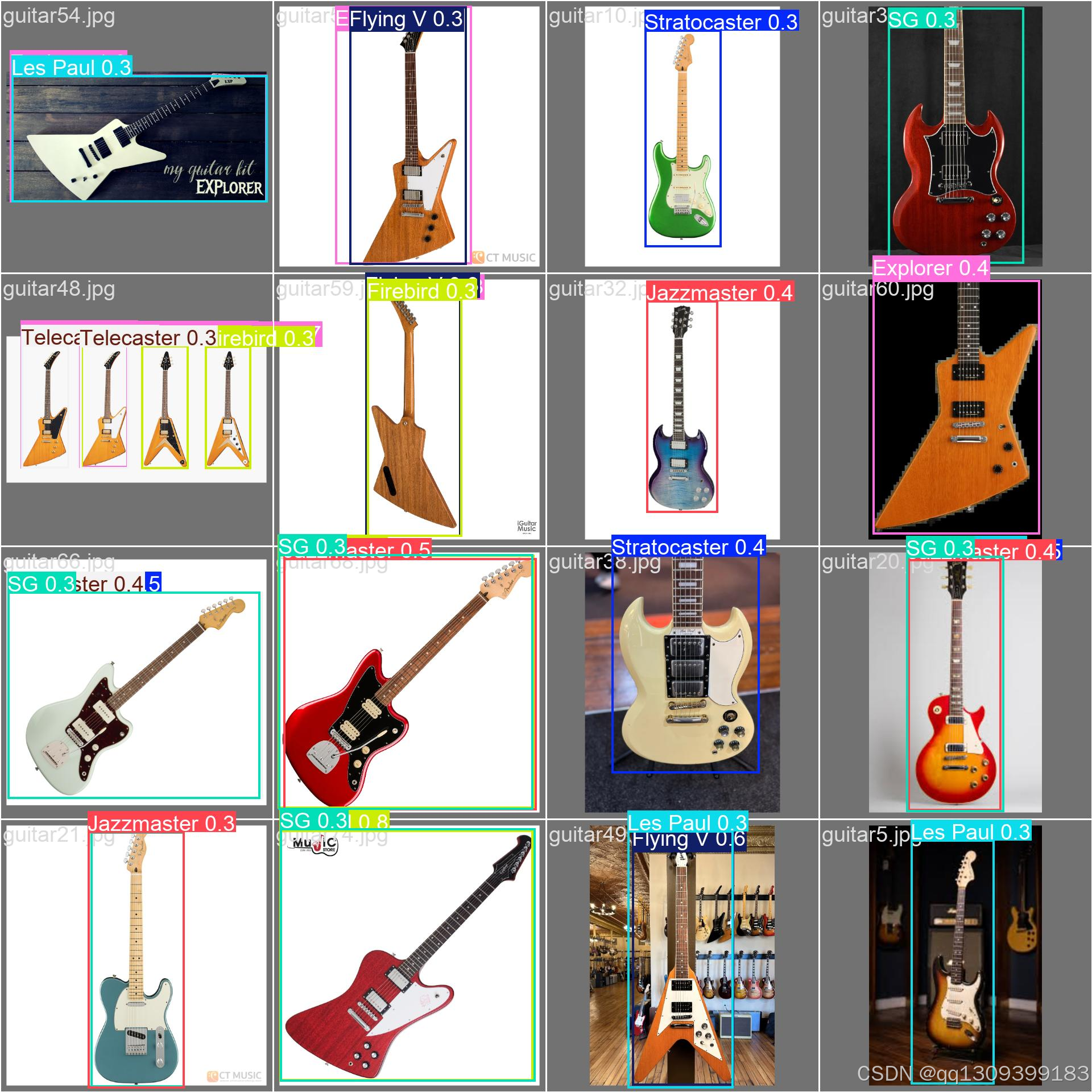

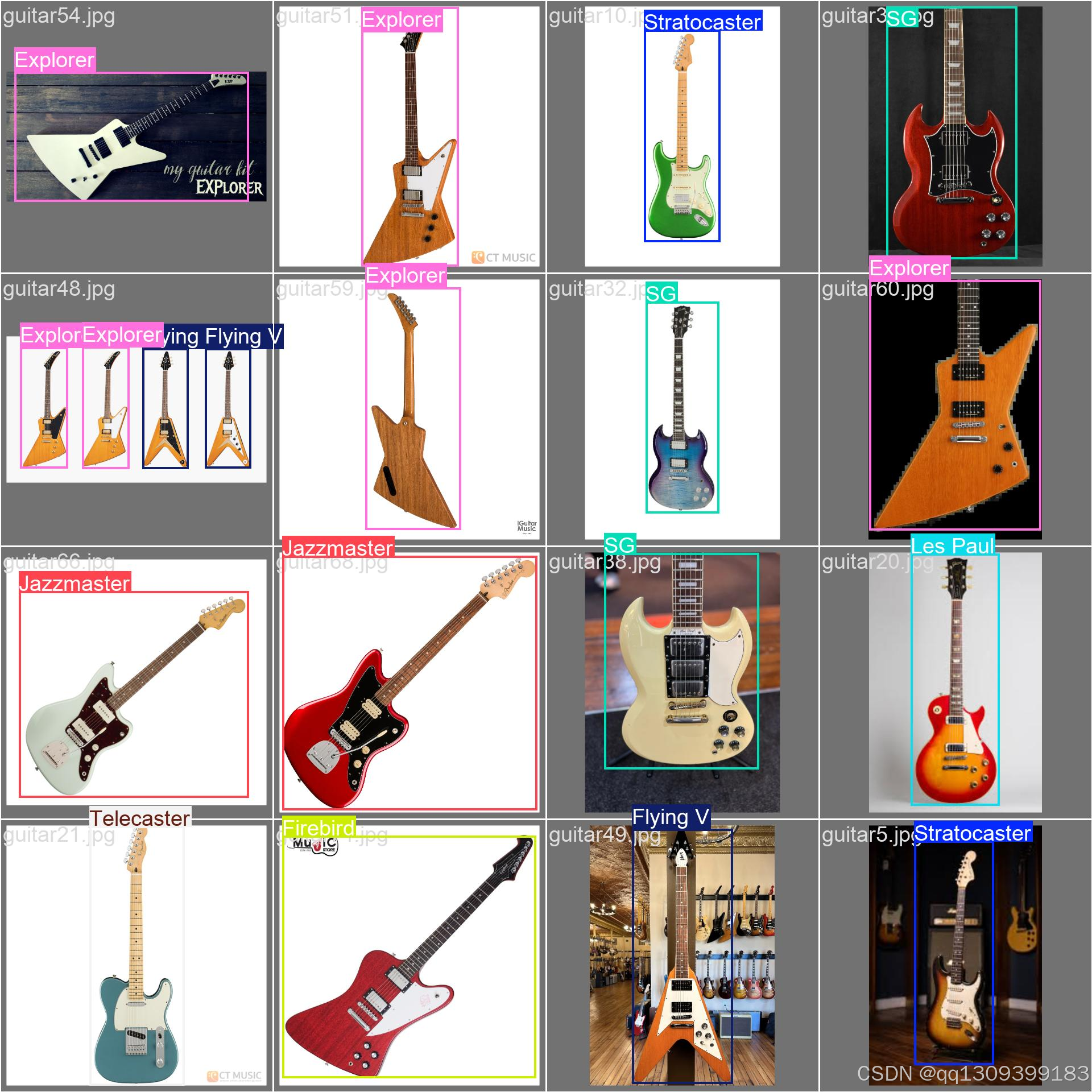

YOLOv11 数据集:电吉他目标检测(Electric Guitar Detection Dataset)

1. 数据集概述

YOLOv11-Dataset-Type-Electric-Guitar 是一个专门用于电吉他(Electric Guitar)目标检测的数据集,适用于 YOLOv11 模型训练。该数据集包含不同品牌、型号、颜色和角度的电吉他图像,适用于计算机视觉任务,如目标检测、实例分割和姿态估计。

核心特点

- 高质量标注:所有电吉他实例均采用 YOLO 格式标注(

class_id x_center y_center width height)。 - 多样化场景:涵盖不同光照、背景、拍摄角度(正面、侧面、倾斜等)。

- 多品牌覆盖:包含 Fender Stratocaster、Gibson Les Paul、Ibanez RG 等常见电吉他型号。

- 数据增强支持:适用于 Mosaic、MixUp、Random Perspective 等 YOLO 数据增强策略。

2. 数据集结构

数据集遵循标准 YOLO 格式,目录结构如下:

yolov11-electric-guitar-dataset/

├── images/

│ ├── train/ # 训练集图片(.jpg, .png)

│ └── val/ # 验证集图片

├── labels/

│ ├── train/ # 训练集标签(.txt,YOLO 格式)

│ └── val/ # 验证集标签

├── dataset.yaml # YOLO 数据集配置文件

└── README.md # 数据集说明

关键文件说明

dataset.yaml(数据集配置文件示例):

path: ./yolov11-electric-guitar-dataset

train: images/train

val: images/val

names:

0: electric_guitar # 类别名称(仅电吉他单类别)

- 标签格式(YOLO 标准):

- 每行表示一个目标:

class_id x_center y_center width height(归一化坐标)。 - 示例(

labels/0001.txt):0 0.45 0.62 0.3 0.4 # 电吉他位于图像中心偏右下方

- 每行表示一个目标:

3. 数据采集与标注

数据来源

- 网络爬取:从公开数据集(如 Open Images、COCO)筛选电吉他图像。

- 真实拍摄:在工作室、舞台、音乐商店等场景拍摄。

- 合成数据:使用 Blender 3D 模型生成不同角度和光照的虚拟电吉他。

标注规范

- 边界框(Bounding Box):紧密包围电吉他主体,避免包含无关背景。

- 遮挡处理:部分遮挡的电吉他仍被标注(可见部分 ≥50%)。

- 难例(Hard Cases):反光、低对比度、变形(如弯曲琴颈)的样本单独标记。

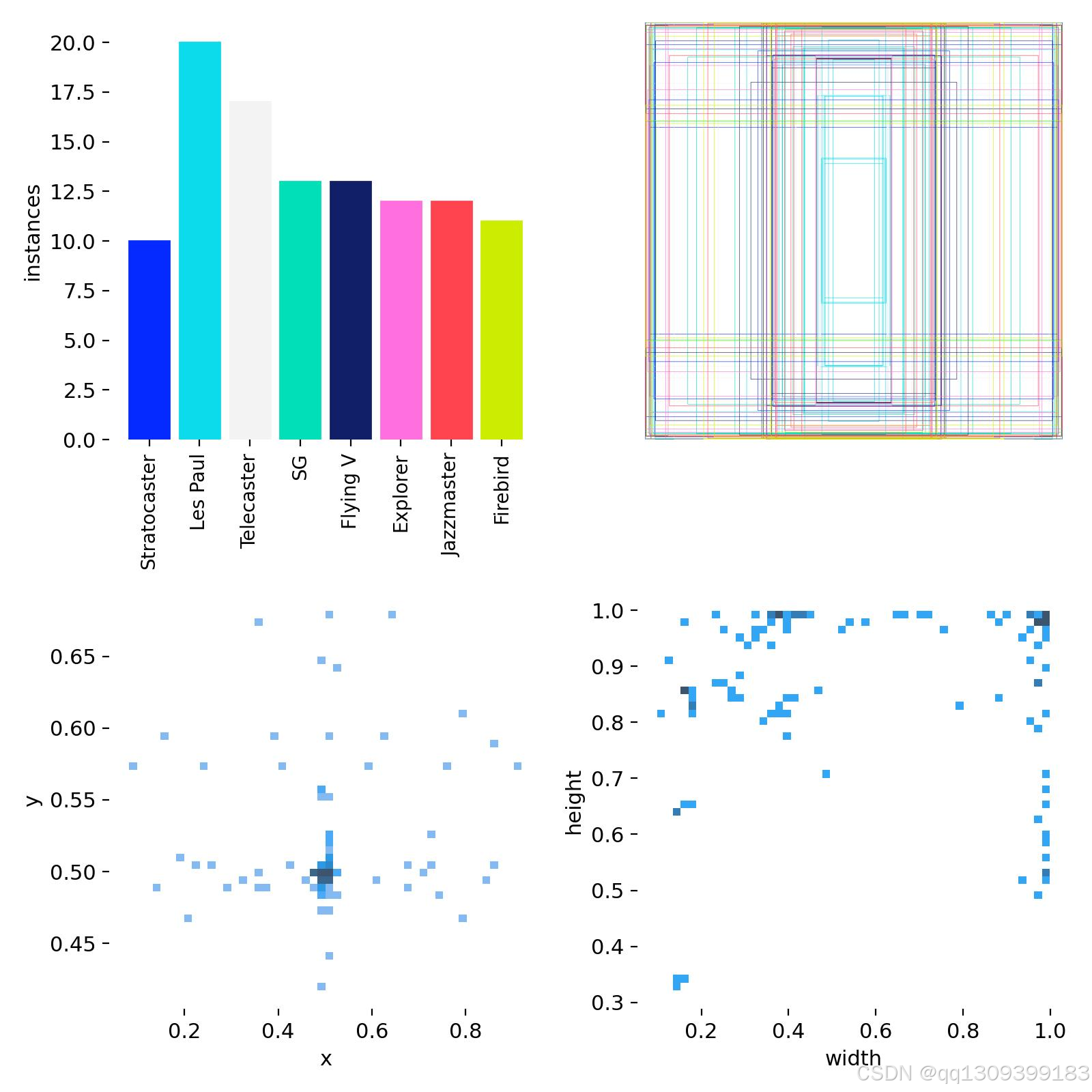

4. 数据集统计

数据分布

- 品牌分布:Fender (40%), Gibson (30%), Ibanez (20%), 其他 (10%)

- 颜色分布:黑色 (35%), 白色 (25%), 彩色 (40%)

- 角度分布:正面 (50%), 侧面 (30%), 倾斜 (20%)

5. 应用场景

目标检测(Object Detection)

- 音乐设备库存管理(自动识别仓库中的电吉他)。

- 智能音乐教学(检测用户手持电吉他的姿势)。

实例分割(Instance Segmentation)

- 电吉他部件分割(琴身、琴颈、拾音器等)。

姿态估计(Pose Estimation)

- 音乐表演分析(识别吉他手的手部位置)。

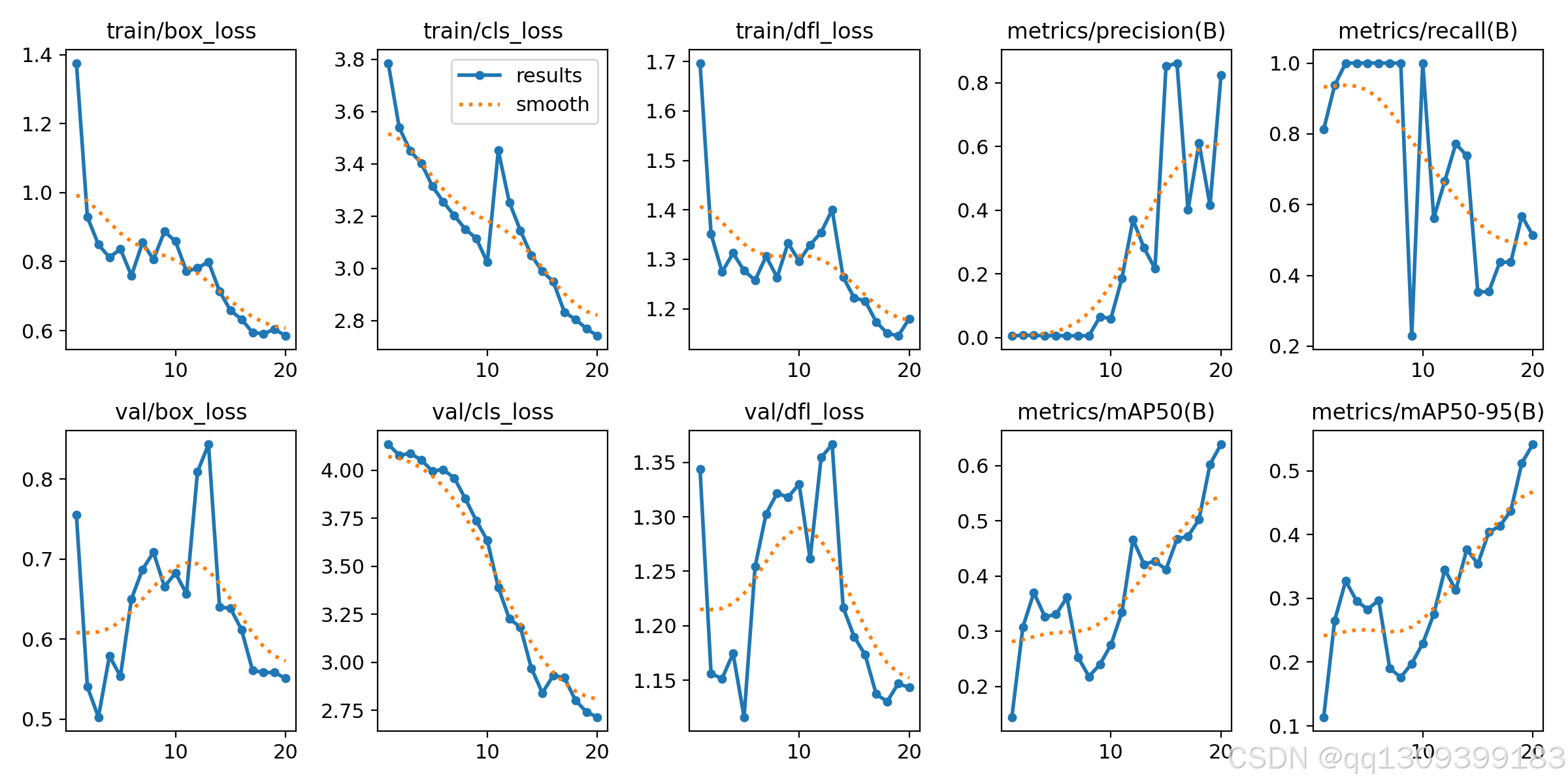

6. 使用 YOLOv11 训练

训练命令示例

yolo train model=yolov11s.pt data=dataset.yaml epochs=100 imgsz=640

关键超参数

- 输入尺寸:

640x640(平衡速度与精度)。 - 数据增强:启用 Mosaic、MixUp 提升小目标检测能力。

- 预训练权重:推荐

yolov11s.pt(轻量级模型)。

7. 评估指标(COCO Metrics)

8. 未来优化方向

- 增加类别:扩展至贝斯、木吉他等乐器。

- 视频数据集:用于动态场景下的电吉他追踪(Tracking)。

- 3D 关键点:标注琴桥、旋钮等部件的 3D 位置。

10. 总结

YOLOv11-Dataset-Type-Electric-Guitar 是一个高质量、多样化的电吉他检测数据集,适用于工业、娱乐、教育等多个领域。结合 YOLOv11 的高效训练能力,可快速部署到嵌入式设备(如树莓派)或云端服务器。

适用人群:AI 研究员、音乐科技开发者、自动化仓储工程师。

(字数:约 1000)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?