文章目录

此博客,是根据Rancher官网文档,使用RKE测试部署最新发布版 Rancher v2.5.8 高可用集群的总结文档。

一 了解 Rancher

Rancher 是为使用容器的公司打造的容器管理平台。Ranhcer 简化了使用 Kubernetes 的流程,开发者可以随处运行 Kubernetes(Run Kubernetes Everywhere),满足IT需求规范,赋能 DevOps 团队。

Rancher 可以创建来自 Kubernetes 托管服务提供商的集群,自动创建节点并安装 Kubernetes 集群,或者导入任何已经存在的 Kubernetes 集群。

Rancher 支持集中化认证、权限控制、监控和管理所有 Kubernetes 集群。

- 使用活动目录(Active Directory)的认证信息访问云端 Kubernetes 集群,如 GKE、AKS、EKS 等;

- 设置用户、用户组、项目组、集群、云服务的权限控制策略和安全策略;

- 一站式监控您名下所有集群的健康状态。

1 关于Helm

Helm 是安装 Rancher 高可用集群时会用到的工具。

Helm 是 Kubernetes 的软件包管理工具。Helm chart 为 Kubernetes YAML manifest 文件提供了模板语法。通过 Helm,可以创建可配置的 Deployment YAML,而不是只能用静态的 YAML。如果您想了解更多关于如何创建自己的应用商店应用(catalog),请查阅 Helm官方网站 。

2 关于RKE

RKE 全称是 Rancher Kubernetes Engine。可以通过 CLI 的方式独立于 Rancher 2.x 使用。可以在安装好 docker 的 linux 主机上,快速方便的搭建 Kubernetes 集群。

关于 RKE 和 Rancher 的关系,RKE 是 Rancher 2.x 中的一个重要组成部分,在 UI 上通过“自定义主机”创建的集群和通过“主机驱动”创建的集群,都是 Rancher Server 调用 RKE 模块来实现的。

3 关于K3S

K3s 是经过精简和用户体验优化的 k8s。K3s 减少了运维负担。一条命令就可以启动 K3s。加入一个新节点,使用 4 层 LB 等也都非常简单。同时也可以使用 MySQL/SQLite 等关系型数据库作为数据库。

4 Rancher 名词解释

4.1 仪表盘

仪表盘会显示 Prometheus 收集到的监控数据。单击右边的 Grafana 图标,浏览器会打开一个新的标签,在 Grafana 里呈现这些监控数据。

①. CPU

- 已预留6中的2.4:6为集群节点的 CPU 总和,2.4为集群中所有工作负载spec.containers.resources.requests.cpu 的总和。

- 已使用6中的0.2:6为集群节点的 CPU 总和,0.2为集群中所有节点已使用 CPU 的总和。

②. Memory

- 已预留11.1GiB中的1.5:11.1GiB为集群节点的 memory 总和,1.5为集群中所有工作负载spec.containers.resources.requests.memory 的总和。

- 已使用11.1GiB中的2.3:11.1GiB为集群节点的 memory 总和,2.3为集群中所有节点已使用 memory 的总和。

③. Pods

集群可以创建的最大 Pod 数量,单节点默认110个 pod,可以通过设置 kubelet 的max-pods来修改默认最大 Pod 数量。

4.2 项目

项目是 Rancher 中的一个概念,能够帮助您管理 kubernetes 集群中的命名空间,您可使用项目创建多租户集群,这种集群允许多个用户使用相同的底层资源创建应用,而应用之间不会相互影响。

更多详情,请参阅 项目管理 文档。

4.3 多集群应用

通常,大多数应用都部署在单个 kubernetes 集群上,但是有时候您可能希望跨不同的集群或项目部署同一个应用的多个副本。在 Rancher 中多集群应用使用 Helm Chart,并可以跨多个集群部署应用。因为能够跨多个集群部署相同的应用,因此可以避免在对每个集群上重复执行相同的操作期间引入的人为错误。使用多集群应用,您可以确保应用在所有项目/集群中具有相同的配置,并能够根据目标项目来覆盖不同的参数。由于多集群应用被视为单个应用,因此易于管理和维护。

更多详情,请参阅 多集群应用 文档。

4.4 应用商店

Rancher 提供了基于 Helm 的应用商店的功能,该功能使部署和管理相同的应用变得更加容易。

- 应用商店可以是 GitHub 代码库或 Helm Chart 库,其中包含了可部署的应用。应用打包在称为 Helm Chart 的对象中。

- Helm Charts 是描述一组相关 Kubernetes 资源的文件的集合。单个 Chart 可能用于部署简单的内容(例如 Mencached Pod)或复杂的内容(例如带有 HTTP 服务,数据库,缓存等的完整的 Web 应用)。

Rancher 改进了 Helm 应用商店和 Chart。所有原生 Helm Chart 都可以在 Rancher 中使用,但是 Rancher 添加了一些增强功能以改善用户体验。

更多详情,请参阅 应用商店 文档。

4.5 Rancher Server URL

第一次登录 Rancher 后,Rancher 将提示您输入一个Rancher Server URL。您应该将 URL 设置为 Rancher Server 的主入口点。当负载均衡器位于 Rancher Server 集群前面时,URL 应该设置为负载均衡地址。系统会自动尝试从运行 Rancher Server 的主机的 IP 地址或主机名推断 Rancher Server 的 URL,但只有在运行单节点的 Rancher Server 时,上述推断才会正确。因此,在大多数情况下,您需要自己将 Rancher Server URL 设置为正确的值。

更多详情,请参阅 配置 Rancher Server URL 文档。

4.6 RKE 模板

RKE 的全称是Rancher Kubernetes Engine,它是 Rancher 用来创建 Kubernetes 集群的工具。RKE 集群模板制定了 DevOps 和安全团队的标准,简化了 Kubernetes 集群的创建过程。

多集群管理面临着如何强制实施安全策略和附加配置的挑战,在将集群移交给最终用户之前,管理员需要标准化这些配置。RKE 集群模板提供了标准化集群配置的方式。无论是使用 Rancher UI、Rancher API 还是自动化流程创建的集群,Rancher 都将保证从 RKE 集群模板创建的每个集群在生成方式上是一致的。

更多详情,请参阅 RKE 模板 文档。

4.7 GIS 扫描

Rancher 充分利用了kube-bench来对 Kubernetes 集群进行安全扫描。Rancher 会检查 Kubernetes 集群是否遵循了 CIS (Center for Internet Security,互联网安全中心) Kubernetes Benchmark 中定义的最佳实践。

CIS Kubernetes Benchmark 是一个可以用来给 Kubernetes 创建安全基准的参考文档。

互联网安全中心(CIS)是一个501©(3)非营利组织,成立于 2000 年 10 月,其使命是“通过识别,开发,验证,推广和维护最佳实践解决方案来防御网络攻击,并建立和引导社区打造安全可信的网络环境”。

CIS 基准测试是安全配置目标系统的最佳实践。CIS 基准是通过领域专家,技术供应商,公共和私人社区成员以及 CIS 基准开发团队的不懈努力而制定的。

基准提供两种类型的建议:计分和不记分。我们仅运行与“计分建议”相关的测试。

当 Rancher 对一个集群进行 CIS 安全扫描时,它会生成一个展示每个测试结果的报告。报告中包括通过,跳过和失败的测试数量的汇总。报告中同时也给失败的测试提供了补救办法。

更多详情,请参阅 安全扫描 文档。

5 推荐架构

安装 Rancher 的方式有两种:单节点安装和高可用集群安装。因为单节点安装只适用于测试和 demo 环境,而且单节点安装和高可用集群安装之间不能进行数据迁移,所以推荐从一开始就使用高可用集群安装的方式安装 Rancher。

建议将 Rancher Server 安装在高可用的 Kubernetes 集群上,主要是因为它可以保护 Rancher Server 的数据。在高可用安装中,负载均衡器充当客户端的单点入口,并在集群中的多台服务器之间分配网络流量,这有助于防止任何一台服务器成为单点故障。

不建议在单个 Docker 容器中安装 Rancher,因为如果该节点发生故障,则其他节点上将没有可用的集群数据副本,并且可能会丢失 Rancher Server 上的数据。

Rancher 需要安装在高可用的 RKE(Rancher Kubernetes Engine)Kubernetes 集群上,或高可用的K3s (轻量级 Kubernetes) Kubernetes 集群。 RKE 和 K3s 都是经过完全认证的 Kubernetes 发行版。

5.1 K3S Kubernetes 集群安装

如果您是首次安装 Rancher v2.4,建议将其安装在 K3s Kubernetes 集群上。这种 K3s 架构的一个主要优点是,它允许使用外部数据库保存集群数据,从而可以将 K3s 服务器节点视为无状态的。

在 K3s 集群上安装 Rancher 的功能是在 Rancher v2.4 中引入的。K3s 易于安装,仅需要 Kubernetes 一半的内存,而且所有组件都在一个不超过 100 MB 的二进制文件中。

使用 K3s Kubernetes 集群运行 Rancher Management Server 的架构:

5.2 RKE Kubernetes 集群安装

如果要安装 Rancher v2.4 之前的版本,您需要在 RKE 集群上安装 Rancher,该集群中的数据存储在每个有 etcd 角色的节点上。在 Rancher v2.4 中,没有将 Rancher Server 从 RKE 集群迁移到 K3s 集群的方法。所有版本的 Rancher Server(包括 v2.4+)仍然可以安装在 RKE 集群上。

在 RKE 安装中,集群数据将在集群中的三个 etcd 节点上进行复制,这是为了保障在一个 etcd 节点发生故障时,可以提供冗余和数据复制。

使用 RKE Kubernetes 集群运行 Rancher Management Server 的架构:

6 负载均衡配置的推荐配置参数

我们建议您使用以下方案,配置您的负载均衡和 Ingress Controller:

- Rancher 的DNS应该被解析到四层负载均衡器上;

- 负载均衡器应该把 TCP/80 端口和 TCP/443 端口的流量转发到集群中全部的3个节点上;

- Ingress Controller 将把HTTP重定向到HTTPS,在 TCP/443 端口使用 SSL/TLS;

- Ingress Controller 把流量转发到 Rancher Server 的pod的80端口。

在kubernetes集群中安装Ranhcer,并使用四层负载均衡,SSL终止在 Ingress Controller 中。

为了达到最好的性能和安全条件,我们建议您为 Rancher 创建一个专用的 Kubernetes 集群,只在这个机器中部署 Rancher Server,不在这个集群中运行应用或程序。部署 Rancher 后,您可以 创建新集群或导入已有集群 ,然后用这些集群启动您自己的应用或程序。

我们不建议在托管的 Kubernetes 集群上,如 EKS 和 GKE,安装 Rancher。 这些托管的 Kubernetes 集群不会将 etcd 暴露给 Rancher ,达到 Rancher 可以管理的程度,而且它们的特殊改动可能与 Rancher 的操作冲突。

7 节点角色分配建议

根据Rancher是安装在 K3S Kubernetes 集群上还是 RKE Kubernetes 集群上,我们对每个节点的角色的建议有所不同。

7.1 K3S 集群角色

在 K3s 集群中,有两种类型的节点:Server 节点和 Agent 节点。Server 节点和 Agent 节点 都可以运行工作负载。Server 节点运行 Kubernetes Master。

对于运行 Rancher Server 的集群,建议使用两个 Server 节点。不需要 Agent 节点。

7.2 RKE 集群角色

如果将 Rancher 安装在 RKE Kubernetes 集群上,则该集群应具有三个节点,并且每个节点都应具有所有三个 Kubernetes 角色:etcd,controlplane 和 worker。

Rancher Server RKE 集群和下游 Kubernetes RKE 集群的架构对比:

我们对 Rancher Server 集群上的 RKE 节点角色的建议与对运行您的业务应用的下游集群的建议相反。

在配置下游 Kubernetes 集群时,Rancher 使用 RKE 作为创建下游 Kubernetes 集群的工具。注意:在将来的 Rancher 版本中将添加创建下游 K3s 集群的功能。

对于下游 Kubernetes 集群,考虑到稳定性和可扩展性,我们建议下游集群中的每个节点都应只扮演一个角色。

RKE 每个节点至少需要一个角色,但并不强制每个节点只能有一个角色。但是,对于运行您的业务应用的集群,我们建议为每个节点使用单独的角色,这可以保证工作节点上的工作负载不会干扰 Kubernetes Master 或集群数据。

以下是我们对于下游集群的最低配置建议:

- 三个只有 etcd 角色的节点 保障高可用性,如果这三个节点中的任意一个出现故障,还可以继续使用。

- 两个只有 controlplane 角色的节点 这样可以保证 master 组件的高可用性。

一个或多个只有 worker 角色的节点 用于运行 Kubernetes 节点组件和您部署的服务或应用。

在安装 Rancher Server 时三个节点,每个节点都有三个角色是安全的,因为:

- 可以允许一个 etcd 节点失败

- 多个 controlplane 节点使 master 组件保持多实例的状态。

- 该集群有且只有 Rancher 在运行。

因为这个集群中只部署了 Rancher server,没有其他程序或应用,这个集群已经足以应对大多数情况。所以这个集群并不需要像我们建议的下游集群那样的可扩展性和可靠性。

8 扩展 - Ingress

Rancher 安装的 Kubernetes 集群中的每个节点都应该运行一个 Ingress。

Ingress 应被部署为 DaemonSet,以确保你的负载平衡器能够成功地将流量路由到所有节点。

对于 RKE、K3s 和 RancherD 的安装,你不需要手动安装 Ingress,因为它是默认安装的。

对于托管的 Kubernetes 集群(EKS、GKE、AKS)和 RKE2 Kubernetes 安装,你将需要设置 Ingress。

二 软件要求

下面的版本为当前的最新版和稳定版:

| 类型 | Rancher 版本 | Docker 标签 | Helm 仓库 | Helm Chart 版本 |

|---|---|---|---|---|

| 最新版 | v2.5.8 | rancher/rancher:latest | server-charts/latest | v2.5.8 |

| 稳定版 | v2.5.8 | rancher/rancher:stable | server-charts/stable | v2.5.8 |

1 Rancher支持的kubernetes版本

更多信息可以转到官方链接查看。此处我仅列举了本人文档里试验总结的官方最新稳定版的相关信息:https://rancher.com/support-maintenance-terms/all-supported-versions/rancher-v2.5.8/

1.1 在RKE上安装Ranhcer v2.5.8

适用于本地集群的 RKE CLI 和 K8S:

| Rancher版本 | 推荐的CLI版本 | KUBERNETES版本 |

|---|---|---|

| v2.5.8 | v1.2.8 | v1.20.4(默认) v1.19.8 v1.18.16 v1.17.17 |

操作系统和 Docker:

| 类型 | 版本 | 已于1验证/认证 |

|---|---|---|

| CentOS | 7.7、7.8、7.9 | Docker 18.06.3、18.09.x,19.03.x,20.10.x |

1.2 Rancher v2.5.8 中的下游集群

Rancher RKE 下游集群 - Linux Work 节点

注意:Rancher RKE下游群集可以由节点驱动程序或自定义/现有节点配置,也可以注册到Rancher中。

操作系统和Docker:

| 类型 | 版本 | 已于1验证/认证 |

|---|---|---|

| CentOS | 7.7、7.8、7.9 | Docker 18.06.3、18.09.x,19.03.x,20.10.x |

支持的K8S版本:

| 上游K8S版本 | 在2,3,4,5上验证/认证 |

|---|---|

| v1.20.6 | etcd:v3.4.15 flannel:v0.13.0 canal:v3.17.2 nginx-ingress-controller:0.43.0-rancher3 |

1.3 在K3S上安装 Rancher v2.5.8

本地集群:

| K3S版本 | 在2,3,4,5上验证/认证 |

|---|---|

| v1.20.6 + k3s1 | Aurora(MySQL 5.7)2.09.0 MySQL 5.7 PostgreSQL 11.5、12.5、13.1 MariaDB 10.4.8 External Etcd 3.4.15 Embedded Etcd CRI:embedded Containered v1.4.4-k3s1 CNI:embedded Flannel v0.12.0-k3s.1 |

操作系统:

| 类型 | 版本 | 已于1验证/认证 |

|---|---|---|

| CentOS | 7.8、7.9、8.2、8.3 | x86_64架构 |

1.4 Rancher K3S下游集群

注意:Rancher K3S群集只能在Rancher中注册。

操作系统:

| 类型 | 版本 | 已于1验证/认证 |

|---|---|---|

| CentOS | 7.8、7.9、8.2、8.3 | x86_64架构 |

支持的K3S版本:

| K3S版本 | 在2,3,4,5上验证/认证 |

|---|---|

| v1.20.6 + k3s1 | Aurora(MySQL 5.7)2.09.0 MySQL 5.7 PostgreSQL 11.5、12.5、13.1 MariaDB 10.4.8 External Etcd 3.4.15 Embedded Etcd CRI:embedded Containered v1.4.4-k3s1 CNI:embedded Flannel v0.12.0-k3s.1 |

2 RKE-1.2.8

RKE可以兼容当前的所有Docker版本。

每个RKE版本都有受支持的Kubernetes版本的特定列表。如果您要使用的版本与下面列出的版本不同,则需要使用中的系统映像选项来更新Kubernetes cluster.yml。

列举支持的 Kubernetes 版本:

- 请参考 RKE 版本说明 ,获取您当前使用的 RKE 支持的 Kubernetes 版本号。

| Kubernetes版本 |

|---|

| v1.20.6-rancher1-1 |

| v1.19.10-rancher1-1 |

| v1.18.18-rancher1-2 |

| v1.17.17-rancher2-3 |

- 也可以输入以下命令,快速获取支持的版本号:

./rke config --list-version --all

v1.20.6-rancher1-1

v1.17.17-rancher2-3

v1.18.18-rancher1-2

v1.19.10-rancher1-1

3 Kubectl

kubectl 可以比 kube-apiserver 高一个小版本,也可以低一个小版本。

例如:

- 如果 kube-apiserver 当前是 1.21 版本

- kubectl 则支持 1.22、1.21 和 1.20

4 Helm-3.5.x

- 请使用 Helm v3.2.x 或更高版本安装或升级 Rancher v2.5.x。

- Helm v2.16.0 或更高版本需要 Kubernetes v1.16 版本。对于默认的 Kubernetes 版本,请参考发布说明以获取所使用的 RKE 的版本。

- 不能使用 Helm v2.15.0,因为这个版本中有一些关于转换/比较数字的问题。

- 不能使用 Helm v2.12.0,因为这个版本和cert-manager一起使用时会有问题。

| Helm 版本 支持的 Kubernetes 版本 |

|---|

| 3.5.x 1.20.x - 1.17.x |

| 3.4.x 1.19.x - 1.16.x |

| 3.3.x 1.18.x - 1.15.x |

| 3.2.x 1.18.x - 1.15.x |

| 3.1.x 1.17.x - 1.14.x |

| 3.0.x 1.16.x - 1.13.x |

| 2.16.x 1.16.x - 1.15.x |

| 2.15.x 1.15.x - 1.14.x |

| 2.14.x 1.14.x - 1.13.x |

| 2.13.x 1.13.x - 1.12.x |

| 2.12.x 1.12.x - 1.11.x |

| 2.11.x 1.11.x - 1.10.x |

| 2.10.x 1.10.x - 1.9.x |

| 2.9.x 1.10.x - 1.9.x |

| 2.8.x 1.9.x - 1.8.x |

| 2.7.x 1.8.x - 1.7.x |

| 2.6.x 1.7.x - 1.6.x |

| 2.5.x 1.6.x - 1.5.x |

| 2.4.x 1.6.x - 1.5.x |

| 2.3.x 1.5.x - 1.4.x |

| 2.2.x 1.5.x - 1.4.x |

| 2.1.x 1.5.x - 1.4.x |

| 2.0.x 1.4.x - 1.3.x |

5 Docker-20.10.x

将最新的经过验证的Docker版本更新为20.10。

每一个 Kubernetes 版本支持的 Docker 版本都不同。

6 nginx-1.14

官方已在 NGINX 1.14 上进行了测试NGINX 配置。

7 OpenSSH-7.0+

为了可以通过 SSH 访问每一个节点,RKE 要求每个节点上安装的是 OpenSSH 的版本是OpenSSH 7.0+。

三 主机配置

先配置4台最小化安装的主机,其中3台使用RKE配置k8s集群,然后在这个集群上配置高可用Rancher。

要在高可用性 RKE 集群上安装 Rancher 管理服务器,我们建议设置以下基础设施:

- 三个 Linux 节点,通常是虚拟机。

- 一个负载均衡器,将前端流量引导到三个节点。

- 一个 DNS 记录,将一个 URL 映射到负载均衡器。这将成为 Rancher 服务器的 URL,下游的 Kubernetes 集群需要到达它。

注意:Rancher对于配置k8s集群的主机性能要求较高,如果配置较低,会有k8s集群被迫中断的风险。nginx主机性能满足基本要求就可以了,配置要求不大。经试验几次后,我给予的虚拟机Rancher集群k8s主机配置的是:2U,运行内存4G和存储内存50G。

1 主机基本信息

国内用户可根据此链接可以下载所有资源:http://mirror.cnrancher.com

| 主机IP | 主机名 | 配置 | 角色 |

|---|---|---|---|

| 192.168.4.21 | k8s-node01 | 2线程4G | controlplane,etcd,worker |

| 192.168.4.22 | k8s-node02 | 2线程4G | controlplane,etcd,worker |

| 192.168.4.23 | k8s-node03 | 2线程4G | controlplane,etcd,worker |

| 192.168.4.24 | nginx | 2线程2G | nginx负载均衡 |

2 主机初始化配置

注 意 : 以 下 步 骤 , 四 台 主 机 均 要 操 作 。 \color{red}注意:以下步骤,四台主机均要操作。 注意:以下步骤,四台主机均要操作。

2.1 查看系统版本是否满足要求

cat /etc/centos-release

CentOS Linux release 7.9.2009 (Core) #若系统版本为7.7 7.8 7.9 均符合

2.2 安装小工具安装包

yum -y install epel-release

yum -y install lrzsz vim gcc glibc openssl openssl-devel net-tools wget curl

yum -y update #更新软件包版本和内核版本

2.3 关闭防火墙和selinux

测试环境中,为了方便将防火墙和selinux关闭;生产环境中,建议关闭selinux,防火墙规则根据环境需要自定义即可。

#关闭selinux

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

#关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

2.4 时钟同步

为了防止后续集群在客户端和服务器之间因为时钟不同步而发生验证错误。

- 第一种方法:

yum install ntp #每台主机安装ntp服务

systemctl start ntpd #启动时钟同步服务

systemctl enable ntpd #设置开机启动

ntpq -p #查看时钟同步状态

- 第二种方法:

yum install ntp ntpdate -y

之后,选择一台主机(192.168.4.21)作为ntp时间服务器,修改/etc/ntp.conf文件,删除:

server 1.centos.pool.ntp.org iburst

server 2.centos.pool.ntp.org iburst

server 3.centos.pool.ntp.org iburst

改为:

server ntp3.aliyun.com iburst

另外,原始文件中有一行为如下内容:

#restrict 192.168.1.0 mask 255.255.255.0 nomodify notrap

去掉#,打开注释,并将其ip修改为服务器所在网段:

restrict 192.168.4.21 mask 255.255.240.0 nomodify notrap

在集群中的其他服务器上,也要修改此文件,删除掉:

server 1.centos.pool.ntp.org iburst

server 2.centos.pool.ntp.org iburst

server 3.centos.pool.ntp.org iburst

加入:

server 192.168.4.21 prefer

保存后退出,在集群中的所有服务器上执行如下命令:

systemctl stop chronyd.service

systemctl disable chronyd.service

systemctl restart ntpd

systemctl enable ntpd

之后,在集群中192.168.4.21以外的服务器上执行:

ntpq -p

出现以下结果:

remote refid st t when poll reach delay offset jitter

==============================================================================

*sv1.ggsrv.de 192.53.103.103 2 u 28 64 1 210.439 -0.300 0.305

192.168.4.21 .INIT. 16 u - 64 0 0.000 0.000 0.000

说明时间已经同步。

2.5 内核参数调优

cat >> /etc/sysctl.conf << eof

vm.swappiness=0

net.ipv4.ip_forward=1

net.bridge.bridge-nf-call-iptables=1

net.bridge.bridge-nf-call-ip6tables = 1

net.ipv4.neigh.default.gc_thresh1=4096

net.ipv4.neigh.default.gc_thresh2=6144

net.ipv4.neigh.default.gc_thresh3=8192

eof

使内核参数生效:

modprobe br_netfilter #首先执行这个命令后才不会报错

sysctl -p

2.6 SSH Server配置

SSH server全系统配置文件,位于/etc/ssh/sshd_config,该文件必须包含以下代码,允许 TCP 转发。

AllowTcpForwarding yes

#重启sshd服务

systemctl restart sshd

2.7 修改主机名

#分别修改每条主机的hostname

hostnamectl set-hostname k8s-node01

hostnamectl set-hostname k8s-node02

hostnamectl set-hostname k8s-node03

hostnamectl set-hostname nginx

#修改完后可直接断开Xshell的连接,再重新连接Xshell就可以看到主机名已修改了

在 /etc/hosts 文件中添加主机名配置:

cat >> /etc/hosts << eof

192.168.4.21 k8s-node01

192.168.4.22 k8s-node02

192.168.4.23 k8s-node03

192.168.4.24 nginx

eof

注 意 : 下 面 的 步 骤 仅 在 k 8 s 的 3 台 主 机 上 操 作 , n g i n x 上 不 可 以 操 作 。 \color{red}注意:下面的步骤仅在k8s的3台主机上操作,nginx上不可以操作。 注意:下面的步骤仅在k8s的3台主机上操作,nginx上不可以操作。

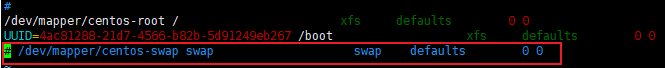

2.8 关闭swap分区

#临时关闭

swapoff -a

#永久关闭

进入/etc/fstab文件,注释掉swap分区的相关配置内容

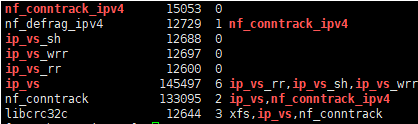

2.9 加载ipvs相关模块

由于ipvs已经加入到了内核的主干,所以为kube-proxy开启ipvs的前提需要加载以下的内核模块。

cat > /etc/sysconfig/modules/ipvs.modules << eof

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

eof

chmod 755 /etc/sysconfig/modules/ipvs.modules

bash /etc/sysconfig/modules/ipvs.modules

lsmod | grep -e ip_vs -e nf_conntrack_ipv4 #查看是否已经正确安装lipset软件包

前面脚本创建了/etc/sysconfig/modules/ipvs.modules文件,保证在节点重启后能自动加载所需模块。

cat >> /etc/rc.d/rc.local << eof

bash /etc/sysconfig/modules/ipvs.modules

eof

chmod +x /etc/rc.d/rc.local

四 安装docker-20.10.6

注 意 : 仅 在 k 8 s 节 点 安 装 d o c k e r \color{red}注意:仅在k8s节点安装docker 注意:仅在k8s节点安装docker

- 若是节点主机上已安装有docker,则先卸载及其依赖包<

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2511

2511

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?