本节我们讲3种求解线性回归问题的方法

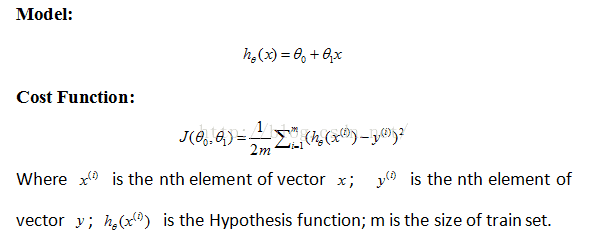

我们首先来看一元线性回归:

1、梯度下降法(Gradient Descent)

这里解释一下,这里的deltaJ是导数,也就是梯度,因此只需要一直迭代就OK,并不需要讨论什么情况下应该采用或者舍弃该迭代过程,但是,注意选取合适的学习速率alpha,防止步数太大找不到最低点。

但是梯度下降法有可能只取到局部最低,并不能达到全局最低,这个和初始点选取有关。

初始点可以多选取几次。

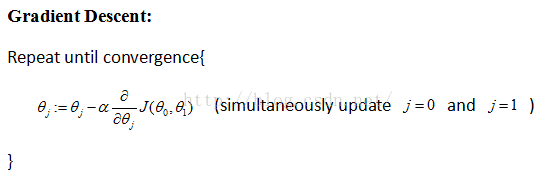

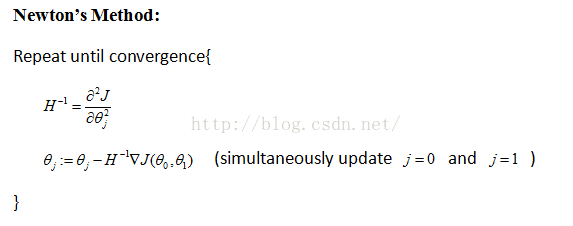

2、牛顿法(Newton's Method)

这个方法用1次导数比上2次导数,没有学习速率

(该图片来自百度百科)

据说比梯度下降法收敛快一些。

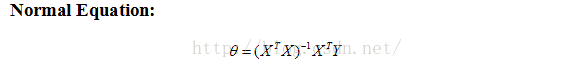

3、正规方程法(Normal Equation)

这个不用迭代,直接就可以把theta求出来。

X第一列全为1,后边几列是数据库里的数据,因为在模型中theta前边的系数为1,x。其实也可以写为 H = THETA * X。此处的THETA和X都是矩阵,也方便之后扩展到多维。

多元的情况就是把X多加几个维度就好啦。公式一样~

8518

8518

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?