sigmoid和softmax在二分类上有什么区别

在二分类问题中,sigmoid 和 softmax 函数都可以用来预测类别概率,但它们在数学形式和概念上有所不同

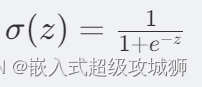

Sigmoid 函数

Sigmoid 函数通常用于二分类问题中的输出层。它将单个输入值映射到 (0, 1) 范围内,表示一个概率值。对于二分类问题,输出层通常只有一个神经元,其激活函数为 sigmoid,公式如下:

其中,( z ) 是神经元的加权输入。Sigmoid 函数的输出可以解释为属于正类的概率。如果输出值大于0.5,通常将样本分类为正类;否则,分类为负类。

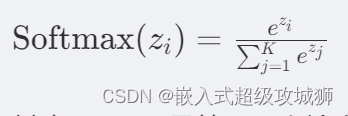

Softmax 函数

Softmax 函数通常用于多分类问题中的输出层,它将一个向量映射到另一个概率分布向量,其中每个元素的值介于 (0, 1) 之间,并且所有元素的和为 1。在二分类问题中,输出层将有两个神经元,每个神经元对应一个类别。Softmax 函数的公式如下:

其中,( z_i ) 是第 ( i ) 个输出神经元的加权输入,( K ) 是输出类别的总数,在二分类问题中 ( K = 2 )。

区别

- 输出神经元数量:在使用 sigmoid 函数时,二分类问题的输出层只需要一个神经元。而在使用 softmax 函数时,输出层需要两个神经元,每个神经元对应一个类别。

- 输出神经元数量:在使用 sigmoid 函数时,二分类问题的输出层只需要一个神经元。而在使用 softmax 函数时,输出层需要两个神经元,每个神经元对应一个类别。

概率解释:在 sigmoid 输出中,我们得到的是单个概率值,表示样本属于正类的概率。在 softmax 输出中,我们得到的是每个类别的概率,它们的和为 1。 - 数学形式:sigmoid 函数只考虑单个输入,而 softmax 函数考虑所有输出类别的加权输入。

在实践中,即使对于二分类问题,我们也可以使用 softmax 函数,只需选择概率较高的类别作为预测结果。然而,由于二分类问题的 softmax 输出的两个概率值是冗余的(一个是 1 减去另一个),通常使用 sigmoid 函数来简化模型并减少计算量。

3550

3550

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?