笔记整理:侯哲衡,东南大学硕士,研究方向为知识图谱问答

链接:https://arxiv.org/abs/2307.05567

1. 动机

事件提取是从文本中提取核心信息元素(如谁、什么、哪里、何时)的任务,它为下游应用程序如摘要、知识库填充、推荐等提供了输入。之前的研究通常将一系列处理步骤或算法连接起来。如首先确定事件触发词/短语和论元候选,然后对成对特征应用分类器以对候选进行分类。然而,这种方式往往会产生错误累计的现象,即上一个步骤的错误累计到下一步当中。

近期的工作研究尝试讲事件提取转换为问答任务,即手动通过模板定义每个论点角色的提问方式。这些研究取得了令人满意的结果,但基于模板的问题存在局限性:因为模板是手动构建的,所以它们是固定的,并且很少包括上下文信息(即特定的输入)。然而,已经证明,生成好的问题可以大大改善标准问答任务的性能。

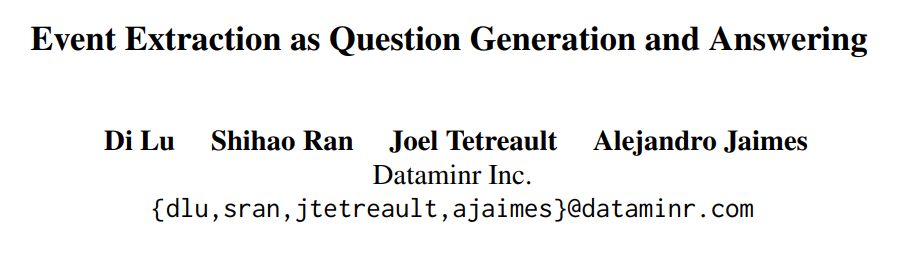

因此,本文提出了QGA-EE,它包括:

(1)一个问题生成模型,用于在目标论据的条件下生成上下文感知问题。

(2)一个问答模型,用于回答上下文感知问题以提取事件论据。

2. 贡献

文章的贡献有:

(1)提出了QGA-EE模型,该模型能够生成融入丰富上下文信息的问题,而不仅仅是使用固定的模板。

(2)提出了动态模板来辅助QG模型的训练。

(3)实验表明,QGA-EE模型在ACE05英语数据集上优于所有基于单任务的先前模型。

3. 方法

(1)整体框架

本文的整体框架如图1所示:

图1 整体框架图

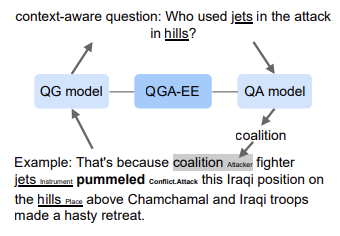

(2)问题生成模型

QGA-EE使用一个QG模型来生成基于输入句子和目标角色的上下文生成问题,该模型基于标准的自注意力架构(例如BART,T5)。为了训练QG模型,本文为ACE本体(https://www.ldc.upenn.edu/sites/www.ldc.upenn.edu/files/english-events-guidelines-v5.4.3.pdf)中的每个角色设计动态模板,即为事件中的每个角色设计多个模板,每个模板都包含其他参数角色的不同组合。最后,为了训练一个 QG 模型来生成尽可能多地涵盖上下文信息的问题,本文使用包含最多上下文参数的问题作为训练过程中的真实值。该过程中的一个例子如图2所示:

图2 问题生成模型输入输出示例

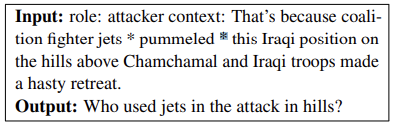

(3)问答模型

QA模型基于标准的自注意力架构(例如BART,T5),并直接生成答案,这使得能够预测与相同角色相关联的多个事件参数。对于生成的答案,本文将输出拆分为候选者列表(以“;”分隔),并通过与原始句子进行精确匹配来检索带有偏移量的参数。本文动态更改搜索的起始位置以保留检索事件参数的顺序。如果某个参数候选者无法与原始句子匹配,则予以丢弃。与QG模型不同,出于数据增强目的,本文使用所有可能的问题作为训练阶段的输入,使得训练数据的大小从15,426增加到20,681。但在测试阶段,本文使用QG模型为每个参数角色生成的单个问题。该过程中的一个例子如图3示:

图3 问答模型输入输出示例

4. 实验

(1)实验设置

本文使用ACE 2005 作为数据集。该数据集包含33类时间类型,22个角色论元,599篇文章。本文延续传统的事件抽取评价方法,即分别判断识别出的触发词等的正确率。

本文设置两个变体:QGA-EEBART 和 QGA-EET5,分别是使用BART 为基础模型和使用 T5为基础模型的变体。

本文设置四个SOTA模型作为对比组,分别是 BERT QA,TANL,TEXT2EVENT和BART-Gen。

(2)实验结果

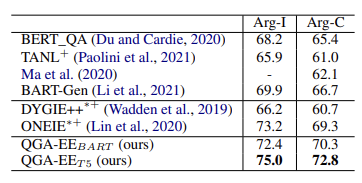

如下图4所示,在事件论元抽取中,与其他模型对比,QAG-EE都可以表现的更好,并且在整体准确率上T5优于BART。

图4 事件论元抽取结果

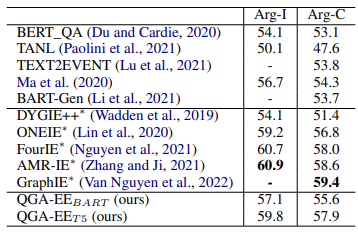

在事件抽取中,QAG-EE展现了类似的效果。实验结果如图5所示:

图5 事件抽取结果

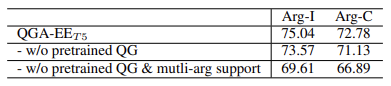

对QAG-EE的消融实验结果如图6所示:

图6 消融试验结果

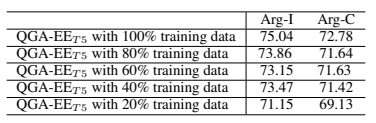

QA模型的构建过程中采用了数据增强,对数据增强的实验分析如图7所示:

图7 数据增强分析实验结果

5. 总结

本文提出了一种文名为QGA-EE的新型序列到序列框架,用于事件抽取(EE)。该框架利用了一个问题生成(QG)模型生成上下文感知的问题,作为输入传递给一个答案抽取(QA)模型进行事件论元抽取(EAE)。该模型自然地支持在特定事件提及中多个事件论元扮演相同角色的情况。研究人员在ACE05-E数据集上进行了实验证明,该模型优于所有基于单任务的模型,并与最先进的联合信息抽取(IE)模型取得了竞争性的结果。未来,研究人员计划利用QA框架的可扩展性,将半结构化的与事件相关的数据(如维基百科信息框)纳入模型中,以丰富知识。他们还计划将这种方法扩展到多语言的事件抽取和联合信息抽取领域。

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。

3684

3684

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?