RNN 基本知识:

Vanilla NN(全连接神经网络)或CNN的一个明显的缺陷是它们的接口太受限:它们接受固定长度的向量作为输入,输出固定长度的向量。模型进行固定步骤的计算来映射向量之间的关系。

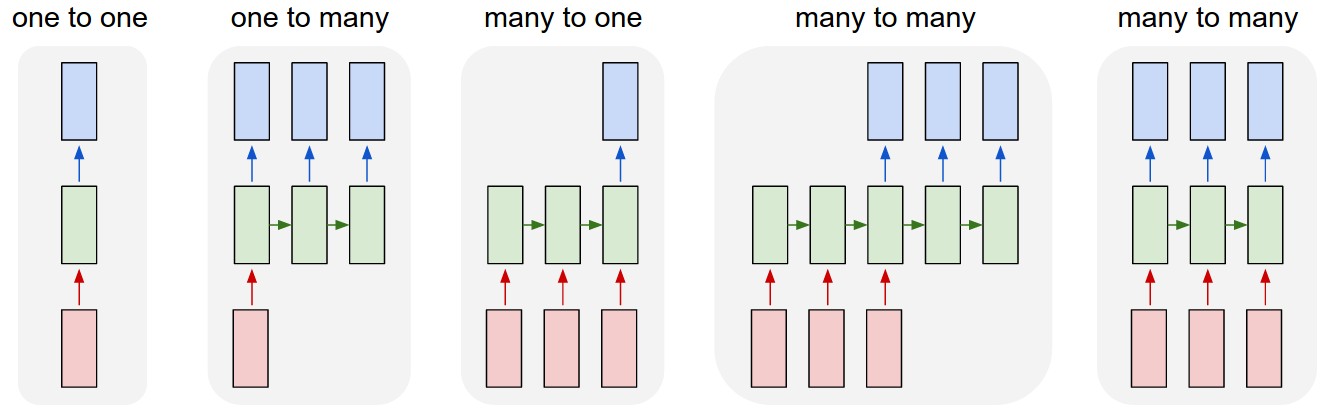

RNN令人惊讶的原因是它允许我们操作向量的序列:输入序列或输出序列,或者输入输出都是序列;

示例

:

每一个矩形是一个向量,箭头代表函数(如矩阵乘);

输入向量是红色的,输出向量是蓝色的,绿色向量保存了RNN的状态信息;

从左向右:1 Vanilla全链接神经网络模型(从固定的输入到固定的输出)

2 序列输出(例如图像字幕:有一幅图像生成一句话)

3 序列输入(例如对一个句子进行情感分析)

4 输入序列和输出序列(例如机器翻译)

5 同步输入和输出序列(视频分类:对每一帧进行标签)

注意:每种情况都没有对序列长度进行预先设置的约束。因为循环转换过程是不变的,能够被复用任何次;

与固定的神经网络(Vanilla NN)相比,序列操作方法更加有力度,因此可以用来构建更加智能

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?