神经网络

神经网络是一种人工智能方法,用于教计算机以受人脑启发的方式处理数据。

这是一种机器学习过程,称为深度学习。

它使用类似于人脑的分层结构中的互连节点或神经元。它可以创建自适应系统,计算机使用该系统来从错误中进行学习并不断改进。因此,人工神经网络可以尝试解决复杂的问题,例如更准确地总结文档或人脸识别。

神经网络可在有限的人类协助下,帮助计算机制定明智的决策。这是因为它们可以学习非线性和复杂的输入数据与输出数据之间的关系,并为其建模。

自然语言处理

自然语言处理 (NLP) 是指处理自然、人类创建的文本的能力。神经网络可以帮助计算机从文本数据和文档中收集见解和含义。NLP 具有多种使用案例,包括在以下功能中:

自动虚拟座席和聊天机器人

写入数据的自动组织和分类

长格式文档(如电子邮件和表格)的业务情报分析

用于表示情绪(如社交媒体上的正面和负面评论)的关键短语索引

给定主题的文档摘要和文章生成

神经网络架构的灵感源自人脑。人脑细胞称为神经元,构成了一个复杂、高度互联的网络,并能互相发送电信号,以帮助人类处理信息。同样,人工神经网络由人工神经元组成,它们共同合作以解决问题。人工神经元是软件模块,称为节点;人工神经网络是软件程序或算法,在其核心,使用计算系统求解数学计算。

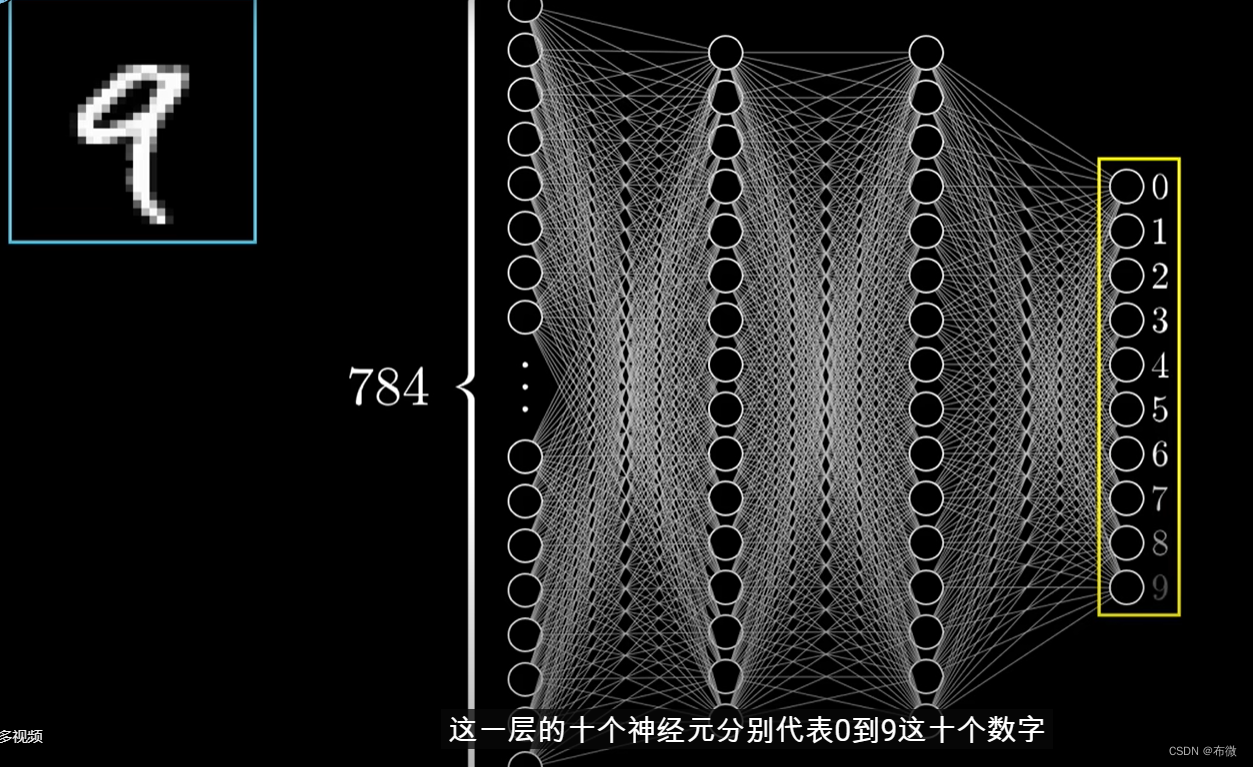

多层感知器MLP

神经元——装数字的容器,装0-1之间的数字。

实际上,神经元中装着的值取决于输入图像,所以神经元看成一个函数更好。

一个神经元的输入是上一层所有神经元的输出。

一个神经元的输出是0-1的值。

神经元中装着的数字——激活值。activation

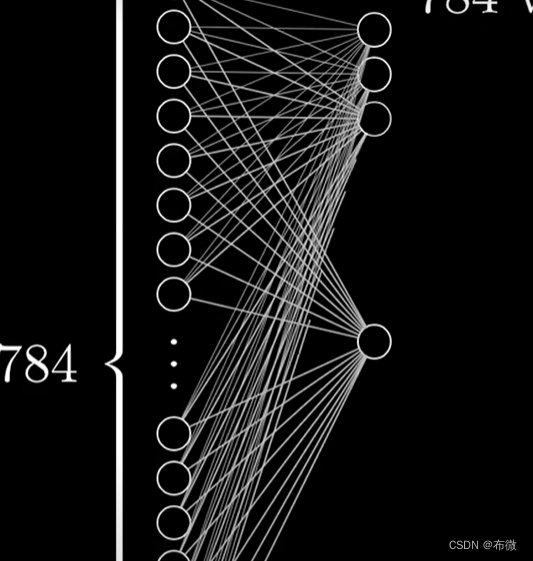

每一个神经元,对应28*28的每一个像素点。共784个神经元,神经元中装着的数字代表像素的灰度值。0是纯黑像素,1 是纯白像素,激活值越大,神经元越亮。

784个神经元组成了网络的第一层。

网络的最后一层,这一层的10个神经元代表0–9十个数字。激活值也都处在0-1之间。这些值表示系统认为输入的图像对应哪个数字的可能性。

输出层会得到结果。

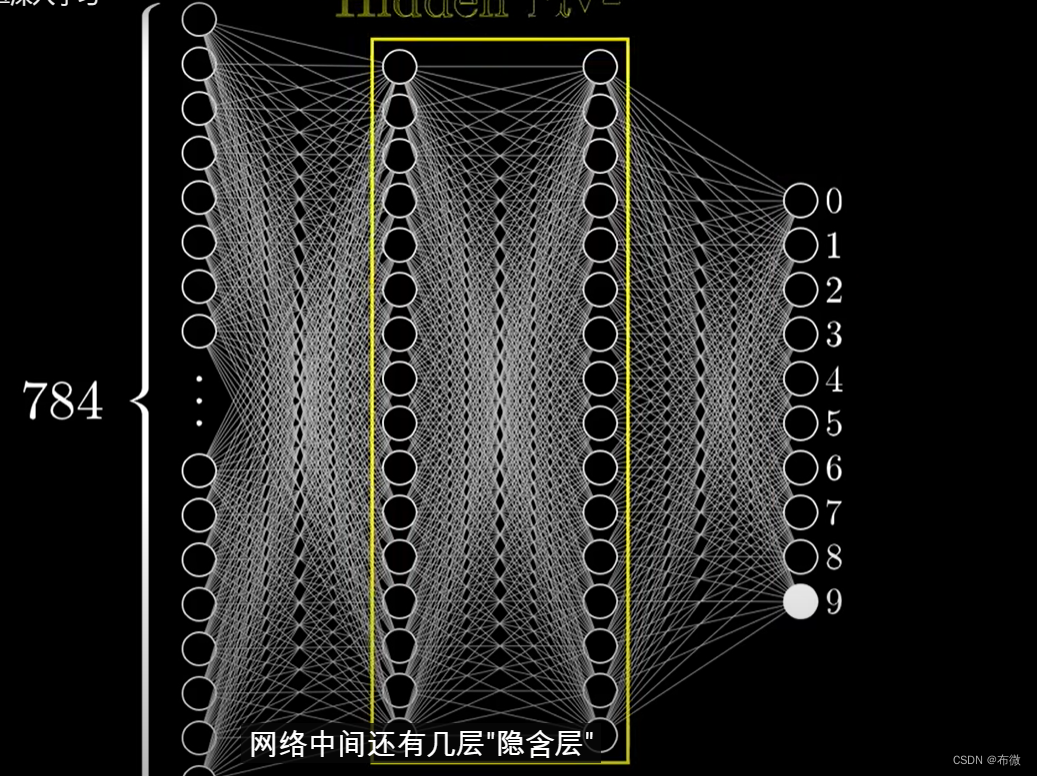

中间是隐含层,里面进行处理数字识别的工作。hidden layers

神经网络运作时,上一层的激活值决定着下一层的激活值。

神经网络处理信息的核心是上一层的激活值是通过怎样的计算决定下一层的激活值。某些神经元激发就会促使另一些神经元激发。

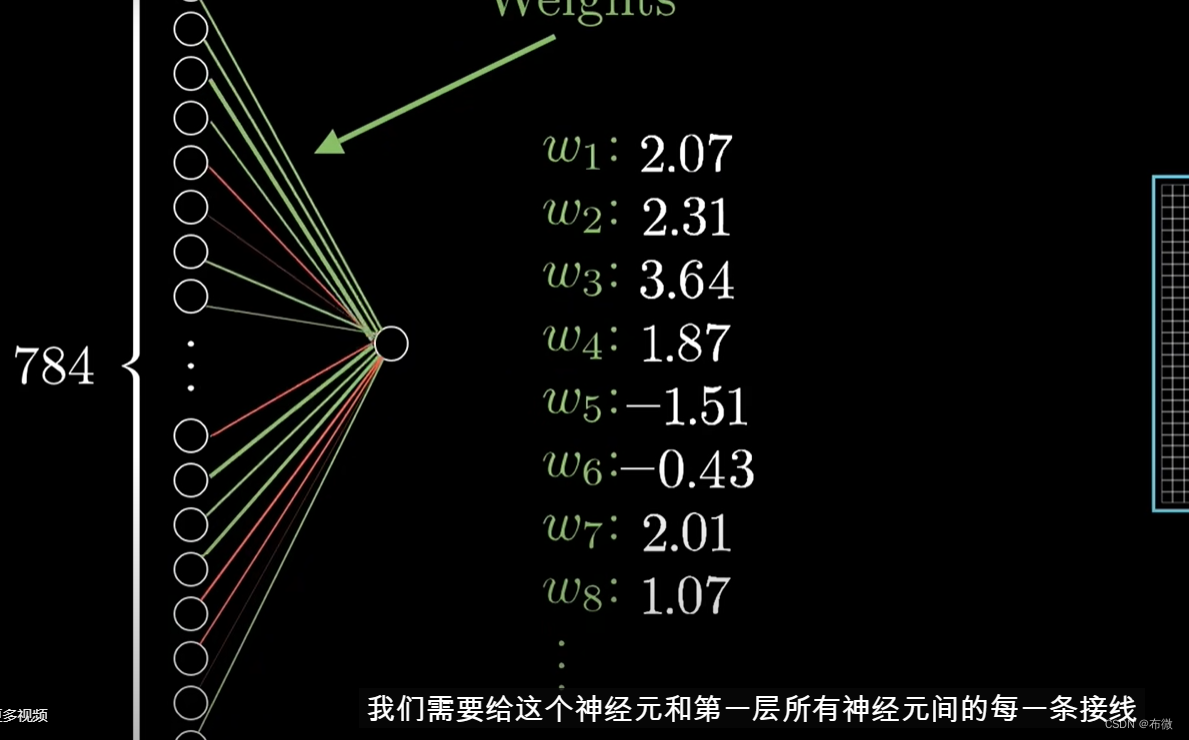

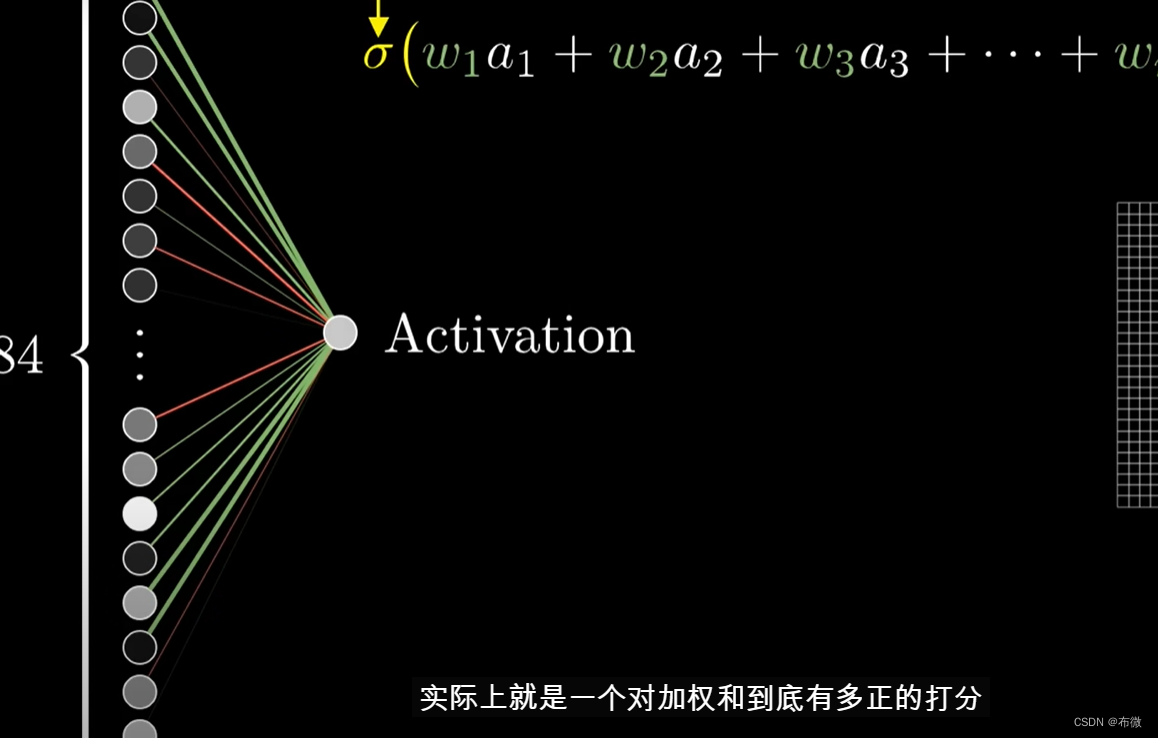

给这些接线都赋上权重值,绿色线条是正值,红色线条是负值,拿第一层所有激活值和权重,算加权和。

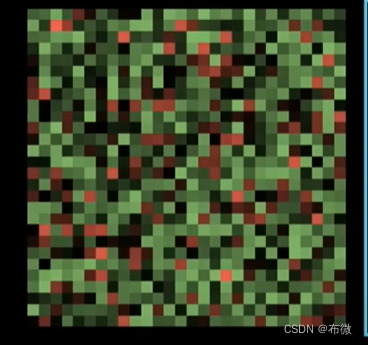

把权重看成表格,784个神经元的连线的权重,绿点是正权重,红点是负权重。颜色越暗,权重越接近0。

把关注区域的权重赋正值,其他权重赋为0 ,对所有像素值取加权和就只会累加关注区域的像素值了。

想识别出是否真的存在一条边,给周围一圈像素赋负的权重,周围像素暗,中间像素亮的时候,加权和到最大。

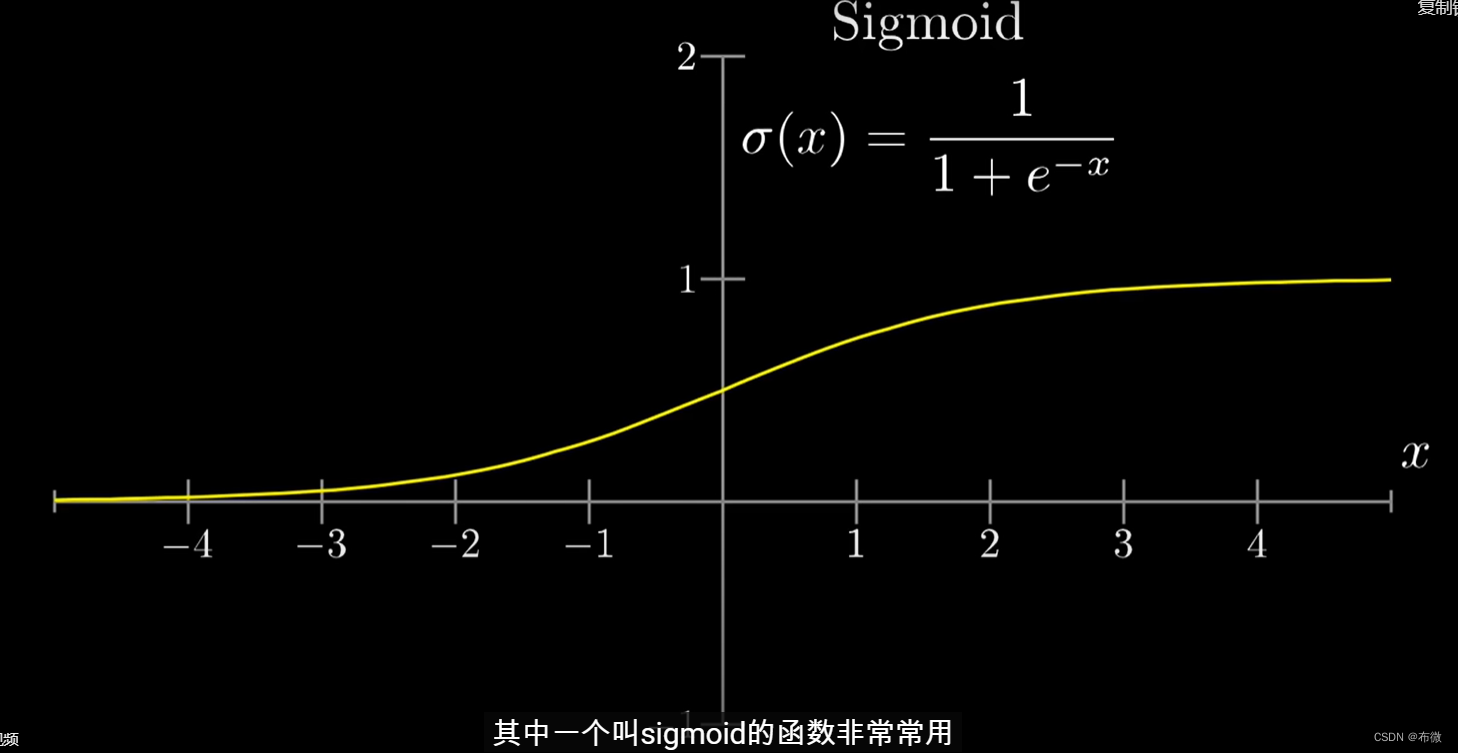

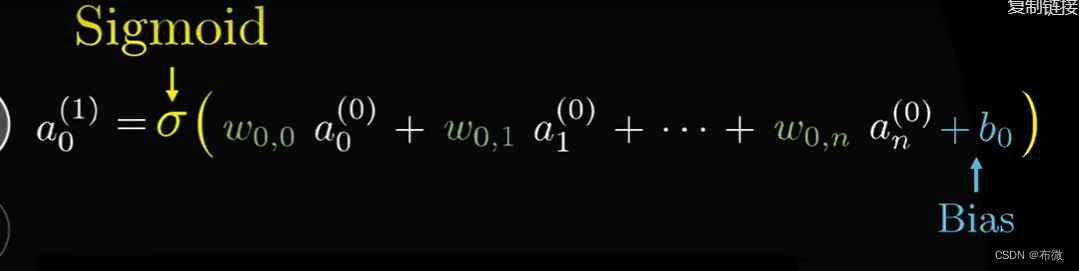

把加权和放入函数,使得取值在0-1之间

也叫logistic曲线,能把非常大的负值变为接近0,非常大的正值变为接近1,在取值0附近是平稳增长。

第二层这个神经元的取值,就是对加权和到底有多正的打分。

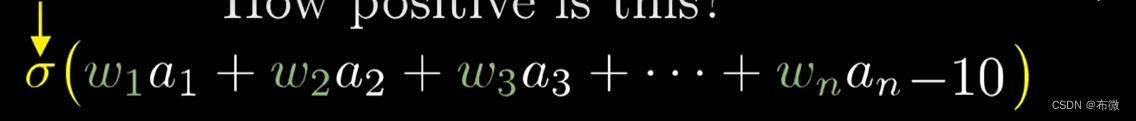

有时,即使加权和大于0也不想把它点亮,可能当加权和大于10的时候才让他点亮,这时候要加上一个偏置值,保证不能随便激发,比如-10

权重告诉你第二层神经元关注什么样的像素图案。

偏置告诉你加权和得有多大,才能让神经元的激发变得有意义。

第二层每个神经元,都会像上面说的那样和第一层784个神经元进行连接。每一个第二层神经元的784根连线上都有权重,并且每一个神经元都会在计算完自己的加权和之后加上自己的偏置,再通过函数压缩自己的输出结果。

这么多条线,所以当我们讨论机器如何学习时,就是讲计算机要如何设置这一堆参数(权重,偏置参数)

当网络的输出和期望出现了偏差,如果一定程度了解这些权重和偏置的意义,再尝试对结构进行修改就有出发点了。

或者当神经网络可以输出正确的结果,但是过程和你想象的不一样时,可以深挖这些权重和偏置的意义,就可以有效挑战自己的假设,从而探索解决方案。

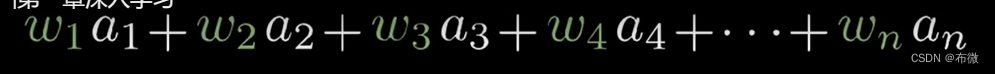

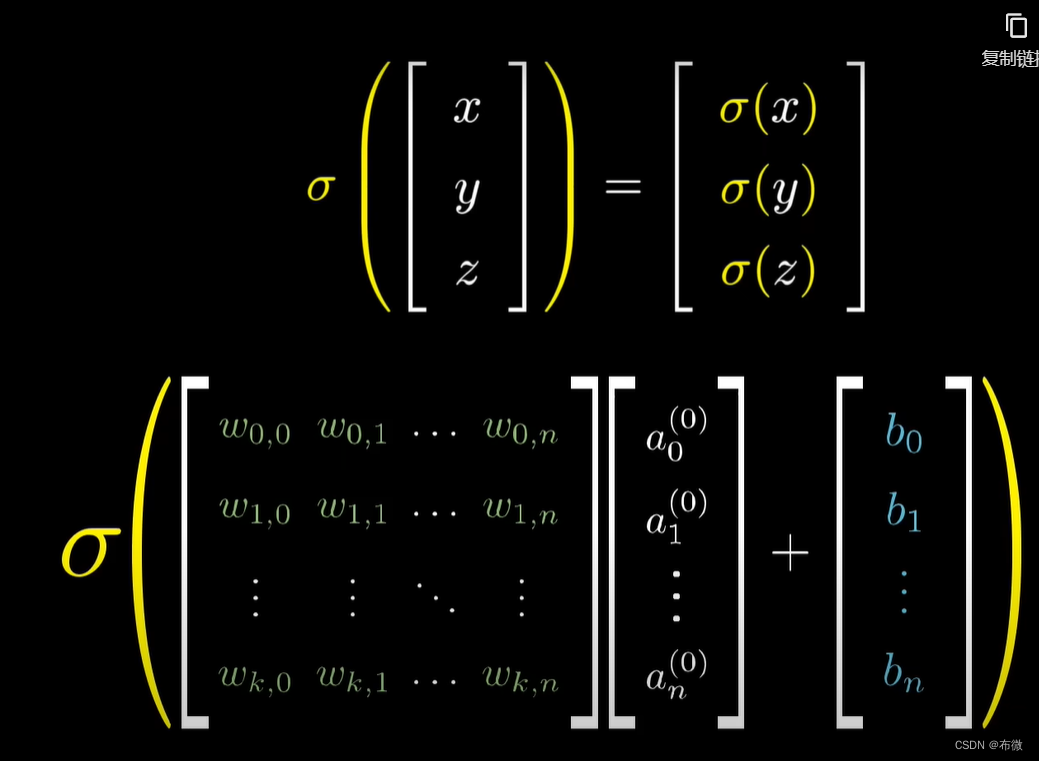

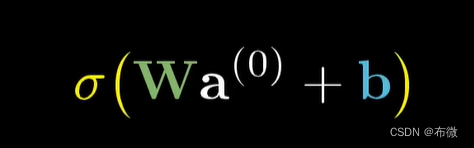

完整的公式如下:

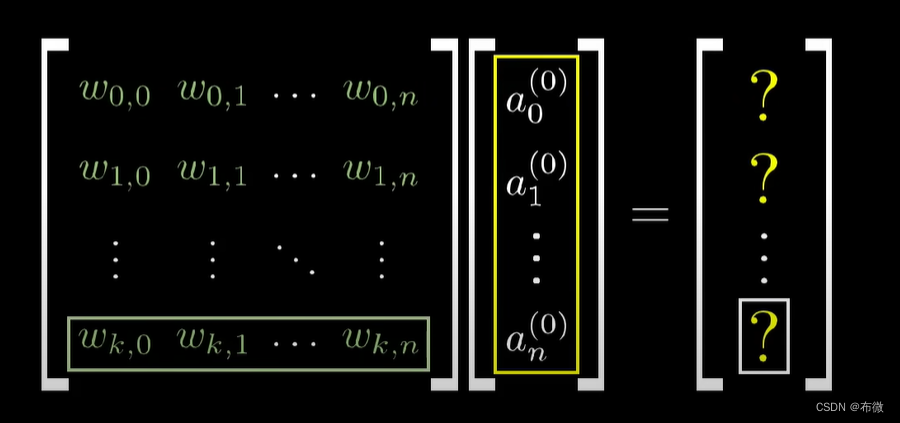

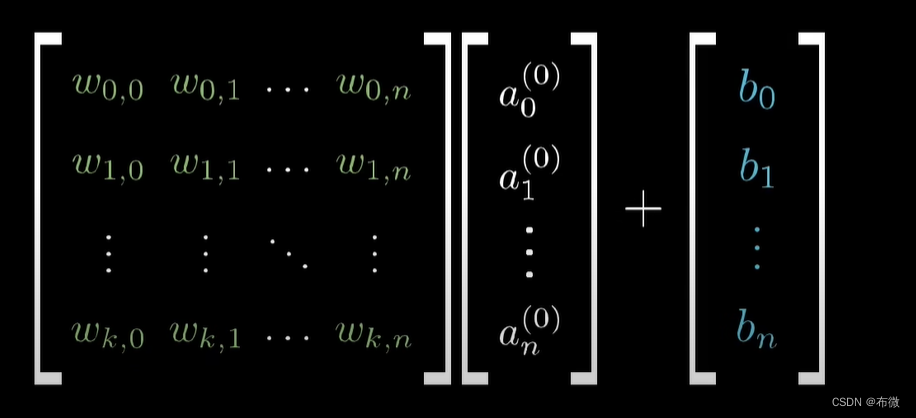

把某一层激活值统一成一个列向量,再把他和下一层所有权重放到一个矩阵里,矩阵第n行就是这一层所有神经元下一层第n个神经元之间所有连线的权重。权重矩阵和向量乘积的第n项就是这一层所有激活值和下一层第n个神经元间的连线权重的加权和。

加上偏置值。

放入函数。

神经网络之间各层激活值的表达。

很多库在矩阵乘法做了优化,比如numpy。

其实整个神经网络就是一个函数,输入784个值,输出十个值的函数,带有很多权重参数和偏置参数。

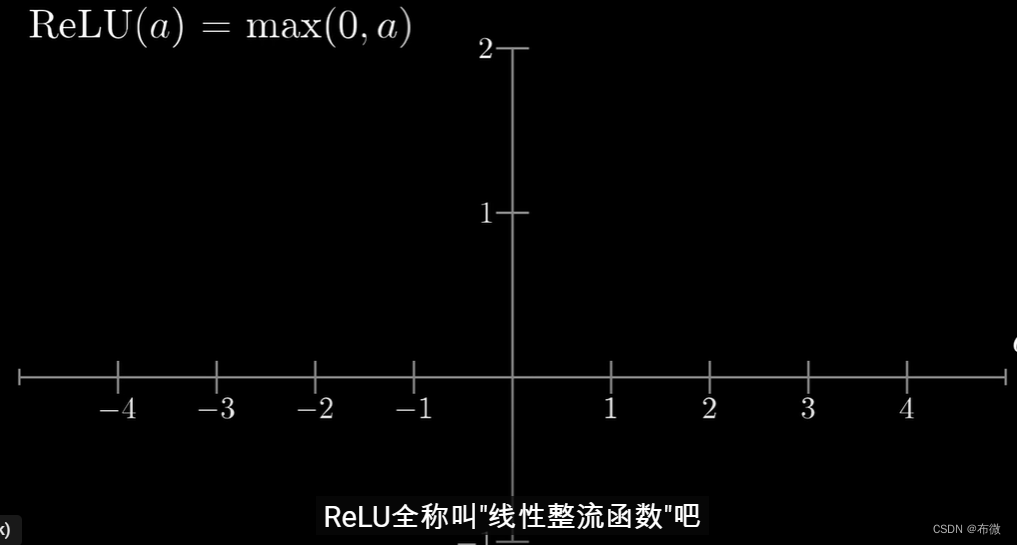

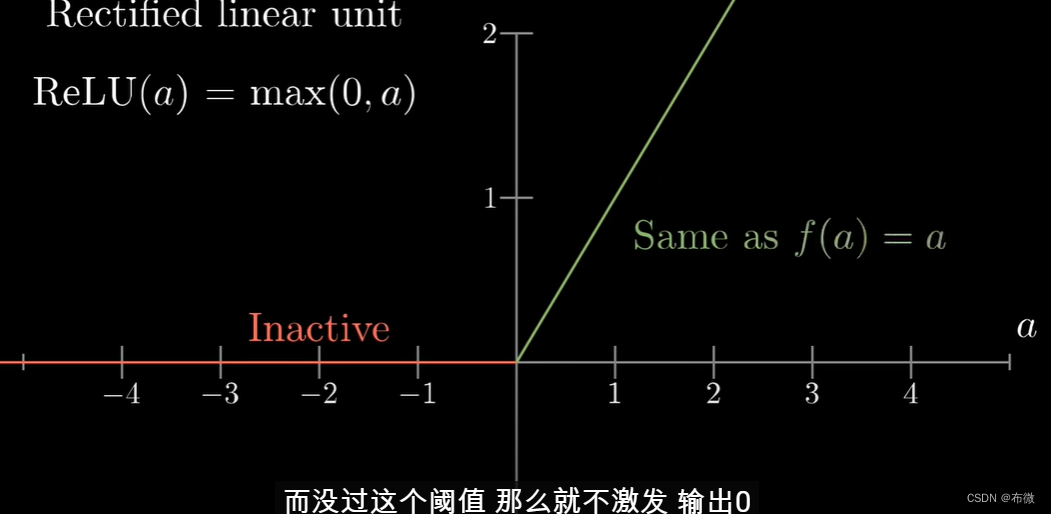

现在的函数一般用ReLU函数,这个函数返回0和a的最大值,a是函数的额输入

超过一个阈值,ReLU就是一个恒定函数。没超过神经元就不被激发,输出0

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?