神经网络如何工作、梯度下降

需要一种向神经网络展示大量训练数据的算法。比如很多手写数字图像,和表明上面是几的一个标签。通过这些训练数据调整权重和偏置,改善神经网络的表现。

概念上,每一个神经元都与前一层所有神经元联系,权重像是神经元间连接强度的参考值,偏置值像是某个神经元倾向于激活还是关闭。

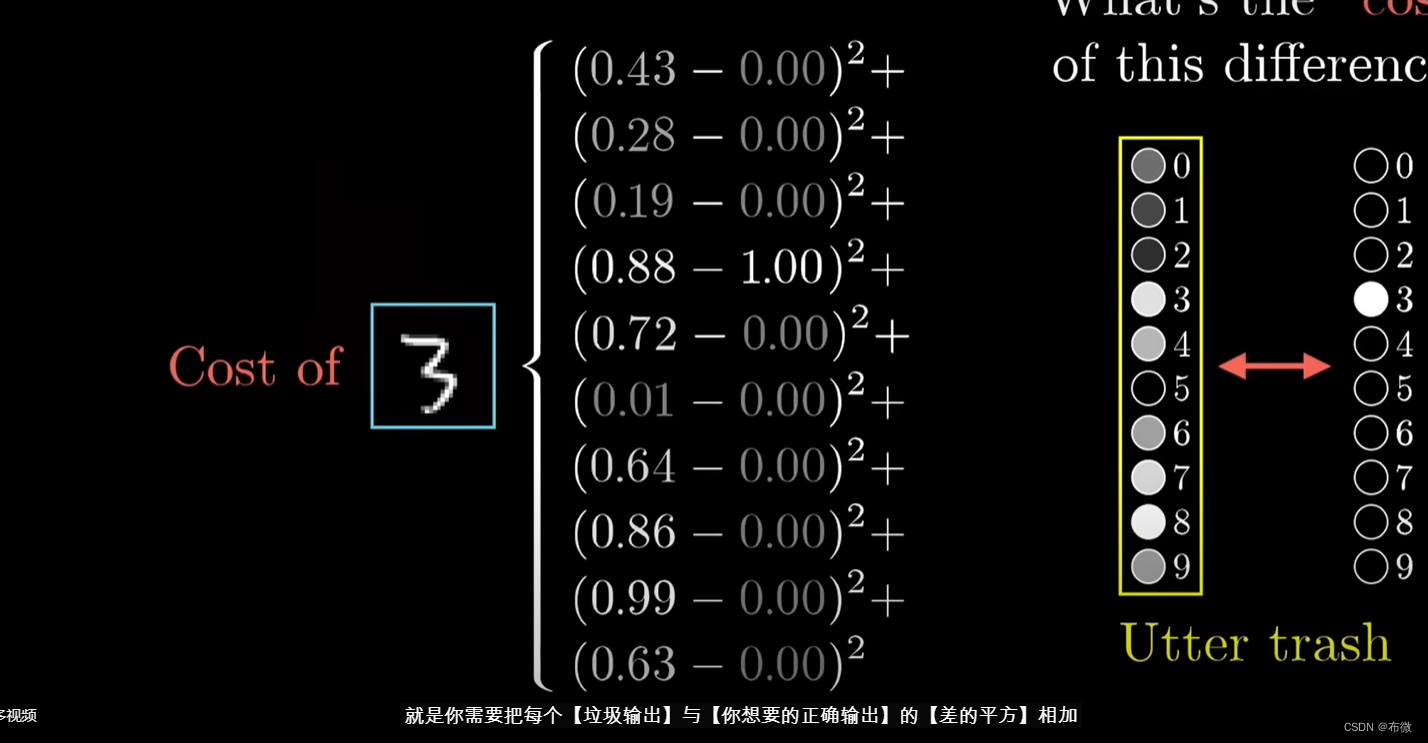

不能瞎设置参数,要不输出的都是垃圾。

定义一个成本函数,cost,告诉电脑做错了,正确输出是多数神经元激活值为0。

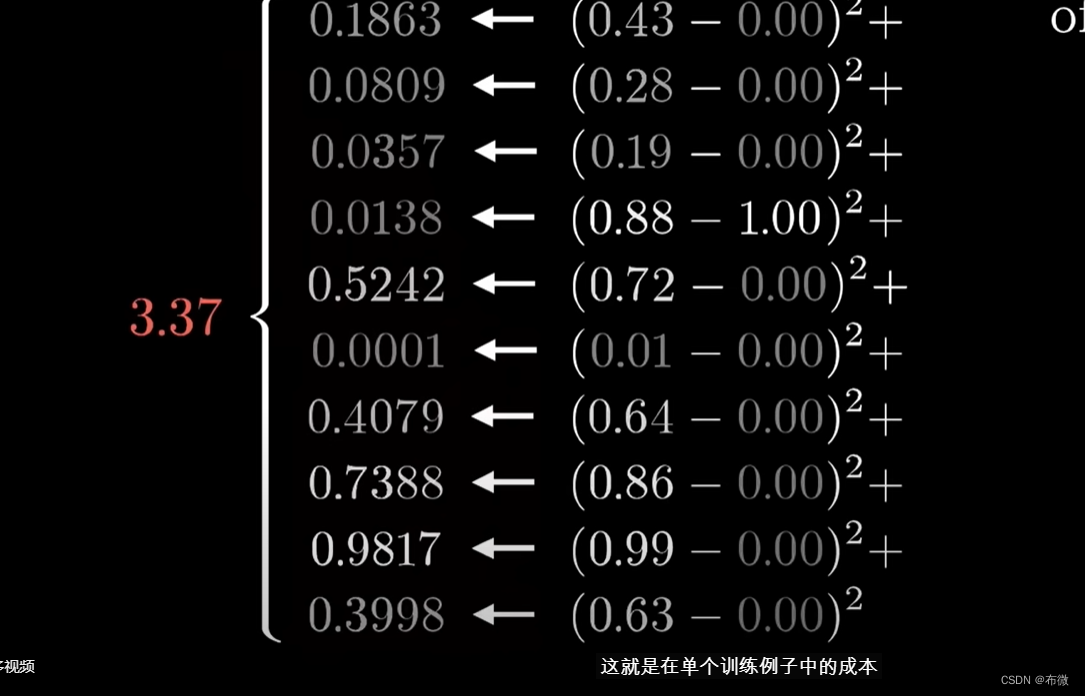

把每个垃圾输出和想要的正确输出的差的平方相加,这是在单个训练例子中的成本。

如果网络能正确的辨别图像,这个和会很小。——所以寻找成本函数的最小值。

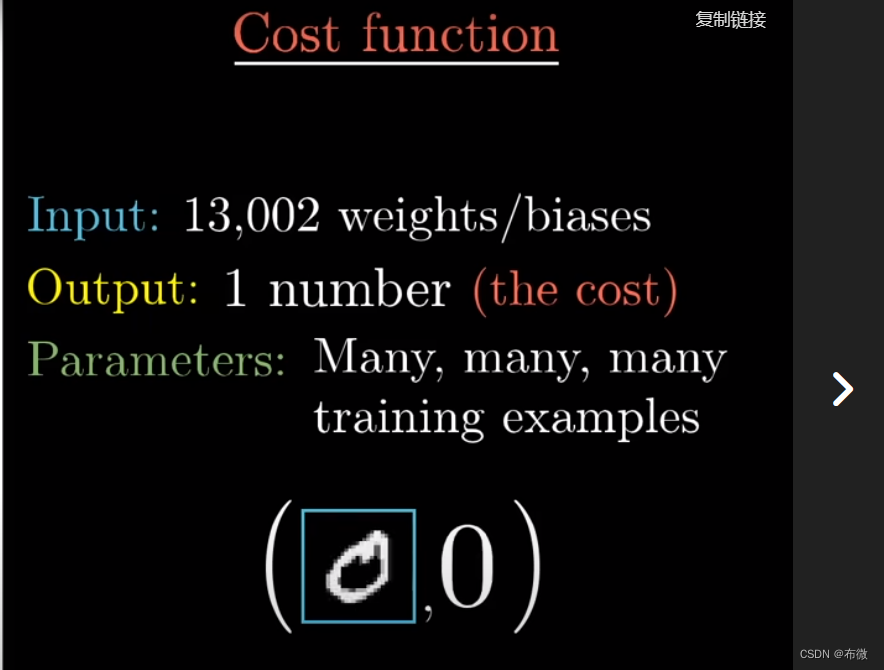

我们要做的就是考虑上万个训练数据的平均成本。

这个平均成本是我们衡量神经网络好坏的一个标准。神经网络本质是个函数。

成本函数:将很多个偏差和权重值作为输入,输出一个数字来表示这些权重和偏置的好坏,他的定义由神经网络经过上万次训练来决定。

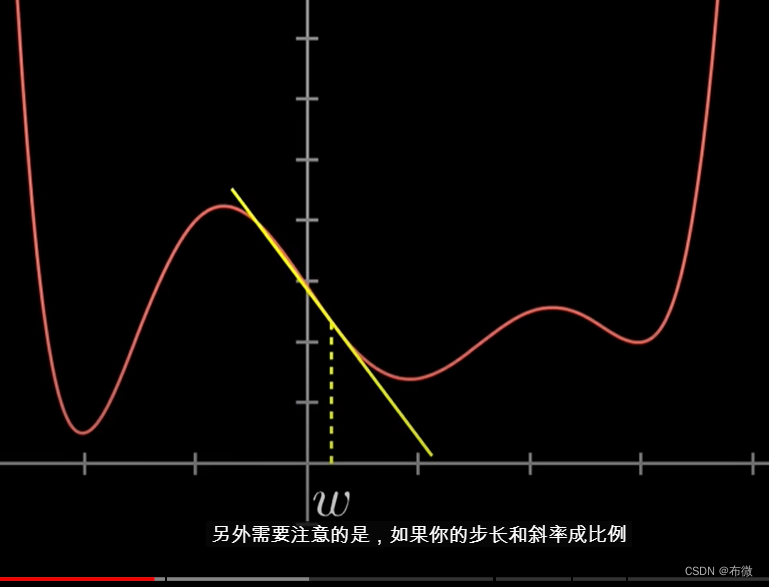

如何寻找最小值:从任意一个输入量开始,找让函数值变小的方向。用合适的步骤不断重复检查每一点的斜率,可以找到局部的最小值。

如果步长和斜率成比例,越接近最小值时,步长越小,避免自己找过头。

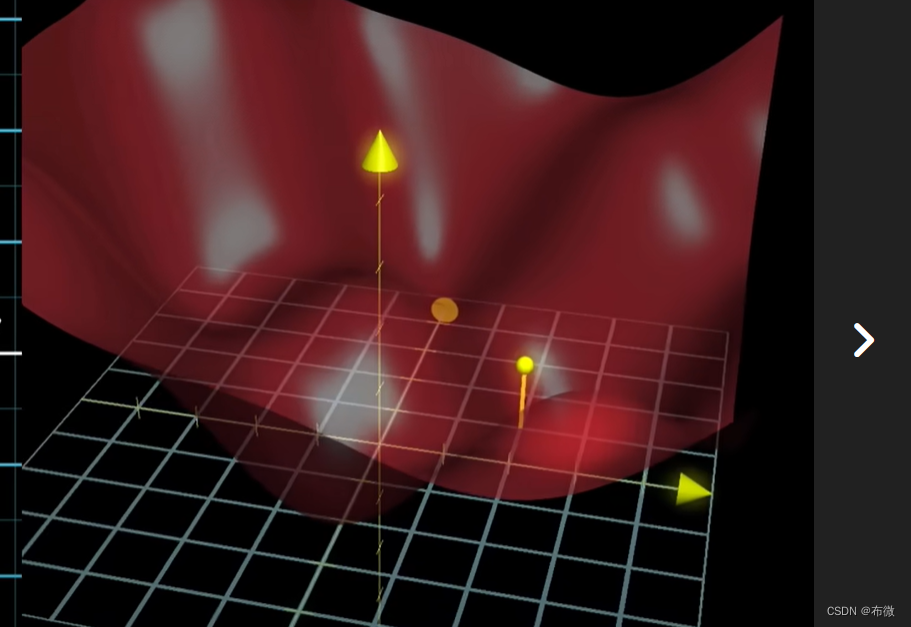

如果一个函数有两个自变量一个因变量,成本函数就是个大曲面。寻找让函数输出减少最快的下山方向是什么

梯度是指函数值增长最快的方向。梯度会给你最陡峭的上升方向。

用负梯度就可以找到函数下降最快的方向。

在机器学习/深度学习中,我们的目标是最小化损失函数,因此要找到最低点,所以每次迭代我们都应该朝梯度的反方向前进(函数值掉得最快),故而叫梯度下降法。这是一种收敛到成本函数局部最小值的方法。

通过计算梯度方向来找到使函数值变小的方向并下山走第一步,可以重复。

这个成本函数是每一组训练数据效果的平均。如果减小这个函数值,就会改善了所有样本的表现。

有效计算梯度的算法是神经网络学习方式的核心——反向传播。

梯度的本意是一个向量(矢量),表示某一函数在该点处的方向导数沿着该方向取得最大值,即函数在该点处沿着该方向(此梯度的方向)变化最快,变化率最大(为该梯度的模)。

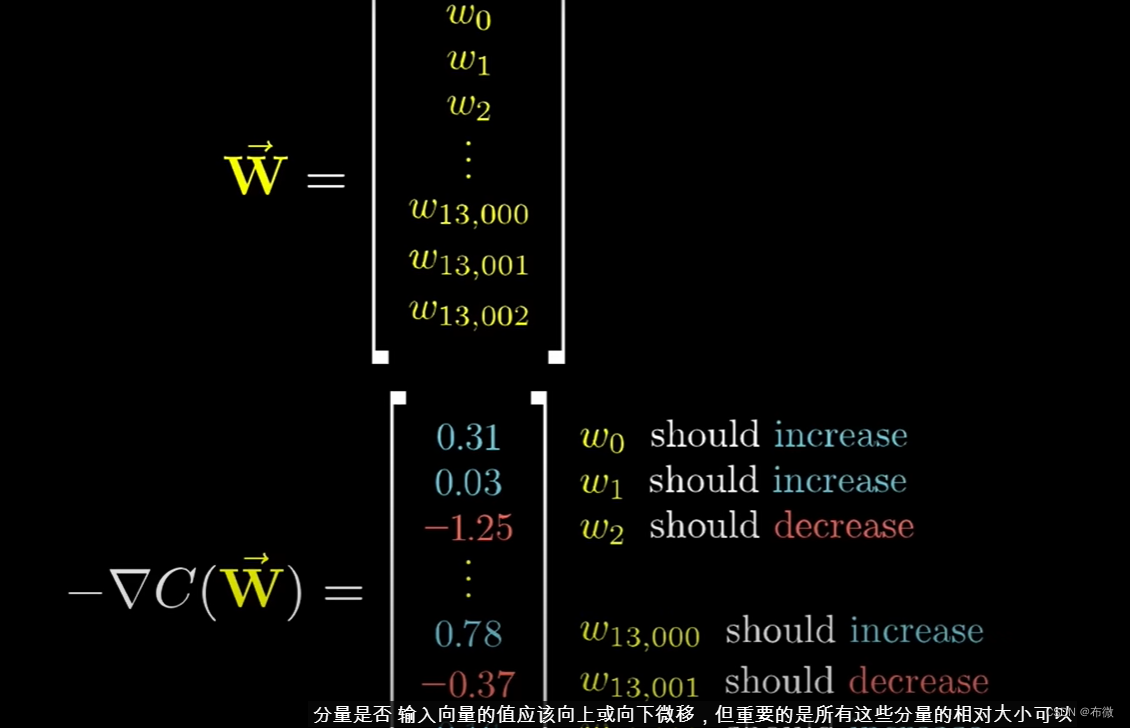

将网络上13000个权重和偏置组成一个巨大的列向量。成本函数的负梯度就是一个向量。告诉你哪个方向会让成本函数最快变小。

函数在某一点的梯度是这样一个向量,它的方向与取得最大方向导数的方向一致,而它的模为方向导数的最大值。

这里注意三点:

1)梯度是一个向量,即有方向有大小;

2)梯度的方向是最大方向导数的方向;

3)梯度的值是最大方向导数的值。

对于成本函数,拥有好输出很重要,所以通过下坡小步找到局部最小值,所以人工神经元具有连续范围的激活

负梯度的每个分量告诉我们两件事:

正负告诉我们向量向上向下偏移。

分量绝对值告诉我们哪个变化更重要。

比如在网络中对其中一个权重的调整,可能会对成本函数产生更大影响,这个权重就更重要。

这个梯度编码了每个权重和偏置的相对重要性。

使用随机权重和偏差初始化网络并根据梯度下降过程多次调整。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?