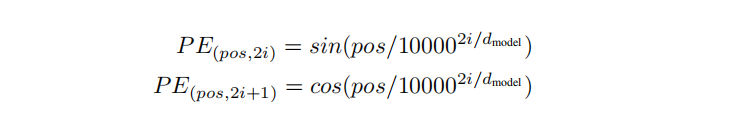

transformer中的position embedding的生成

以上公式就是我们获得position embedding的方法。

pos:表示单词在句子中的位置(1,2,3,...seg_len)

i:表示词向量中的位置(0,1,2,3,......,511)

dmodel:表示的是词向量的维度(512)

根据该公式画图得到:

画图确实有点简陋。从图中我们看到,蓝色线就是pos=1的时候,该蓝线与512个函数有512个交点,那么这512个交点的函数值就构成了pos=1的position embedding。

5158

5158

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?