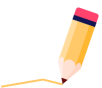

本月初,图灵奖得主 Yann LeCun 在社交平台上发表了一篇名为“The Moon Exploration by Lecun(Lecun登上月球去探索)”的长篇漫画。

关于 Yann LeCun 是谁?其实他还有个传播度更广的中文名字:杨立昆

所以,由这位“卷积网络之父”发布的漫画中的关键词“ StoryDiffusion ”也引起了网友的热议。

StoryDiffusion 这个技术方法出自《StoryDiffusion: Consistent Self-Attention for Long-Range Image and Video Generation》这篇论文,研究团队包含南开大学、字节跳动等机构。

* 论文地址:https://arxiv.org/pdf/2405.01434v1

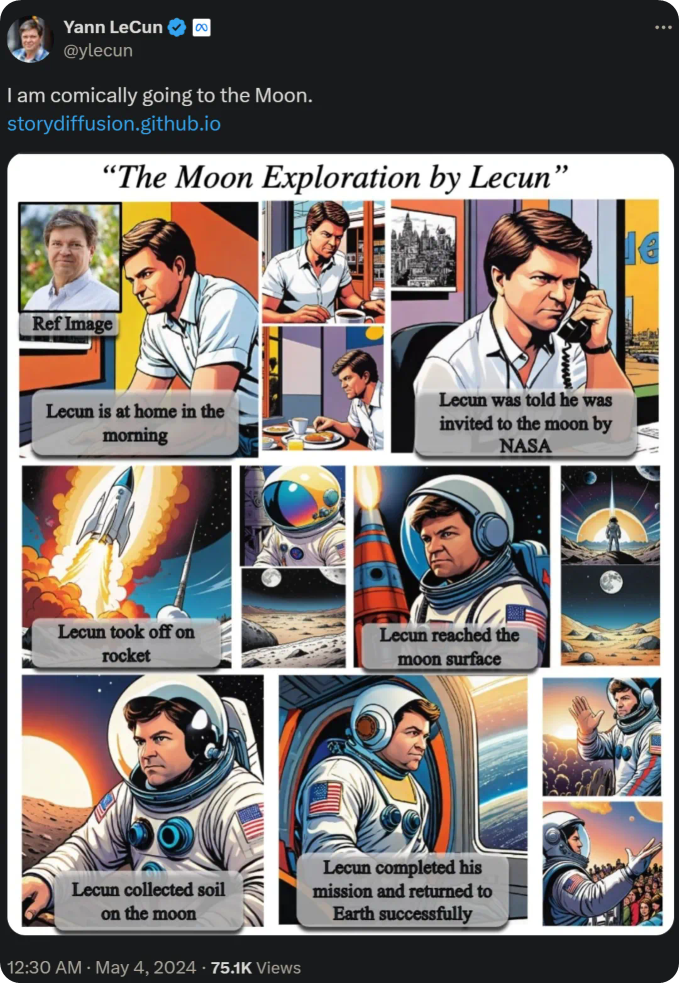

根据论文中的项目演示图片,StoryDiffusion可以 生成各种风格的漫画,在讲述 连贯故事 的同时,保持了 角色风格和服装的一致性。此外,StoryDiffusion 还能够以生成的一致图像或用户输入的图像为条件 生成高质量的视频。

* 通过该团队StroyDiffusion 生成的图像案例

* 通过该团队StroyDiffusion 生成的视频案例截图

论文摘要

《StoryDiffusion:用于长距离图像和视频生成的一致自注意力》

* 论文地址:https://arxiv.org/pdf/2405.01434v1

最近基于扩散的生成模型在生成图像时保持一致的内容,特别是在包含主题和复杂细节的图像中,是一个重大挑战。

本文提出了一种名为一致自我注意力的新方法,显著增强了生成图像之间的一致性,并通过 zero shot 方式增强了流行的基于扩散的文本到图像模型。

为了扩展到远程视频生成,我们进一步引入了一种新的语义时空运动预测模块,称为语义运动预测器。它在语义空间中训练,用于估计两个提供的图像之间的运动条件。该模块将生成的图像序列转换为视频,使过渡更加平滑,主题更加一致。与仅基于潜在空间的模块相比,尤其是在生成长视频时,稳定性显著提高。

通过将这两个新组件结合起来,我们提出的框架被称为StoryDiffusion,可以一致地描述基于文本的故事,涵盖丰富多样的内容。StoryDiffusion 在视觉故事生成方面进行了开创性的探索,呈现了图像和视频的展示,希望这能激发更多基于架构修改的研究。

卡通人物生成

StoryDiffusion 可以创建令人惊叹的一致卡通风格的角色。

多个角色生成

StoryDiffusion可以同时维护多个角色的身份,并在图像序列中生成一致的角色。

漫画生成

StoryDiffusion 可以创作令人印象深刻的漫画。通过提出一致的自我关注来创建各种风格的漫画,保持一致的角色风格和服装以实现连贯的故事讲述。

实现方法

一致自注意力的结构

StoryDiffusion到生成主题一致图像的pipeline。为了创建主题一致的图像来描述一个故事,我们将我们一致的自我关注融入到训练的文本到图像扩散模型。我们将一个故事文本拆分为多个提示,并使用这些提示批量生成图像。一致的自我注意在一批图像中建立多个图像之间的连接,以实现主题的一致性。

运动预测器的结构

我们生成过渡视频以获得受试者一致图像的方法的管道。为了有效地对角色的大动作进行建模,我们将条件图像编码到图像语义空间中,对空间信息进行编码,并预测过渡嵌入。然后使用视频生成模型对这些预测的嵌入进行解码,其中嵌入充当交叉关注的控制I信号,以引导每一帧的生成。

在本文中,我们提出了StoryDiffusion,这是一种新的方法,可以以无训练的方式生成一致的图像,用于讲故事,并将这些一致的图像转换为视频。我们始终如一的自我关注在多个图像之间建立联系,以高效地生成图像一致的脸和衣服。我们进一步提出了语义运动预测器,将这些图像转换为视频,更好地讲述故事。我们希望我们的StoryDiffusion能够激励未来可控的图像和视频生成工作。

--- End ---

欢迎关注微软 智汇AI 官方账号

一手资讯抢先了解

喜欢就点击一下 在看 吧~

1558

1558

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?