文章目录

深度学习Week9——利用TensorFlow实现天气识别

一、前言

二、我的环境

三、前期工作

1、配置环境

2、导入数据

四、数据预处理

1、加载数据

2、可视化数据

3、检查数据

4、配置数据集

五、构建CNN模型

五、编译模型

六、训练模型

七、预测与评估

1、Accuracy图

八、总结

一、前言

- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍖 原作者:K同学啊 | 接辅导、项目定制

学习深度学习的第九周,重新学习的第三周

二、我的环境

- 电脑系统:Windows 10

- 语言环境:Python 3.11.3

- 编译器:Pycharm2023.2.3

深度学习环境:TensorFlow

显卡及显存:RTX 3060 8G

三、前期工作

1、导入库并配置环境

import tensorflow as tf

gpus = tf.config.list_physical_devices("GPU")

if gpus:

gpu0 = gpus[0] #如果有多个GPU,仅使用第0个GPU

tf.config.experimental.set_memory_growth(gpu0, True) #设置GPU显存用量按需使用

tf.config.set_visible_devices([gpu0], "GPU")

这一步与pytorch第一步类似,我们在写神经网络程序前无论是选择pytorch还是tensorflow都应该配置好gpu环境(如果有gpu的话)

2、 导入数据

导入天气数据,依次分别为训练集图片(train_images)、训练集标签(train_labels)、测试集图片(test_images)、测试集标签(test_labels),天气数据集来源于K同学啊的网盘:天气数据集

data_dir = "E:\Deep_Learning\Data\Week3\weather_photos"

data_dir = pathlib.Path(data_dir)

image_count = len(list(data_dir.glob('*/*.jpg')))

print("图片总数为:",image_count)

#查看第一张图片:

roses = list(data_dir.glob('sunrise/*.jpg'))

PIL.Image.open(str(roses[0]))

图片总数为: 1125

四、数据预处理

1、加载数据

使用image_dataset_from_directory方法将磁盘中的数据加载到tf.data.Dataset中

tf.keras.preprocessing.image_dataset_from_directory()会将文件夹中的数据加载到tf.data.Dataset中,且加载的同时会打乱数据。

- class_names

- validation_split: 0和1之间的可选浮点数,可保留一部分数据用于验证。

- subset: training或validation之一。仅在设置validation_split时使用。

- seed: 用于shuffle和转换的可选随机种子。

- batch_size: 数据批次的大小。默认值:32

- image_size: 从磁盘读取数据后将其重新调整大小。默认:(256,256)。由于管道处理的图像批次必须具有相同的大小,因此该参数必须提供。

"""

关于image_dataset_from_directory()的详细介绍可以参考文章:

https://mtyjkh.blog.csdn.net/article/details/117018789

"""

train_ds = tf.keras.preprocessing.image_dataset_from_directory(

data_dir,

validation_split = 0.2,

subset = "training",

seed = 123,

image_size = (img_height, img_width),

batch_size = batch_size)

输出:

Found 1125 files belonging to 4 classes.

Using 900 files for training.

这表示在 data_dir 目录中,有1125个图像文件,并且这些文件被组织成了4个类别。

因为设置 validation_split = 0.2,将数据集按照8:2的比例分成了训练集和验证集,其中80%的数据被用作训练数据,而剩余的20%被用作验证数据。所以,1125个文件中的80%(即900个文件)被用作训练数据。

"""

关于image_dataset_from_directory()的详细介绍可以参考文章:https://mtyjkh.blog.csdn.net/article/details/117018789

"""

val_ds = tf.keras.preprocessing.image_dataset_from_directory(

data_dir,

validation_split = 0.2,

subset = "validation",

seed = 123,

image_size = (img_height, img_width),

batch_size = batch_size)

输出:

Found 1125 files belonging to 4 classes.

Using 225 files for validation.

我们可以通过class_names输出数据集的标签。标签将按字母顺序对应于目录名称。

class_names = train_ds.class_names

print(class_names)

[‘cloudy’, ‘rain’, ‘shine’, ‘sunrise’]

2、数据可视化

# 查看前20个图片

plt.figure(figsize=(20, 10))

for images, labels in train_ds.take(1):

for i in range(20):

ax = plt.subplot(5, 10, i + 1)

plt.imshow(images[i].numpy().astype("uint8"))

plt.title(class_names[labels[i]])

plt.axis("off")

3、再次检查数据

for image_batch, labels_batch in train_ds:

print(image_batch.shape)

print(labels_batch.shape)

break

(32, 180, 180, 3)

(32,)

Image_batch是形状的张量(32,180,180,3)。这是一批形状180x180x3的32张图片(最后一维指的是彩色通道RGB。

Label_batch是形状(32,)的张量,这些标签对应32张图片

4、配置数据集

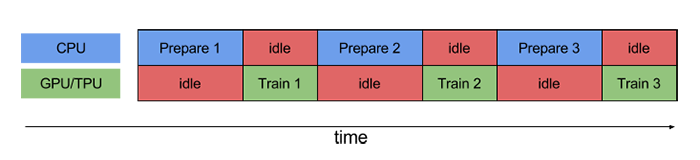

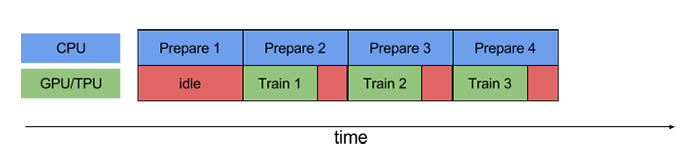

shuffle():打乱数据prefetch():预取数据,加速运行- cache():将数据集缓存到内存当中,加速运行

如果不使用prefetch(),CPU 和 GPU/TPU 在大部分时间都处于空闲状态:

使用prefetch()可显著减少空闲时间:

有点类似于IO总线程序计数器PC;

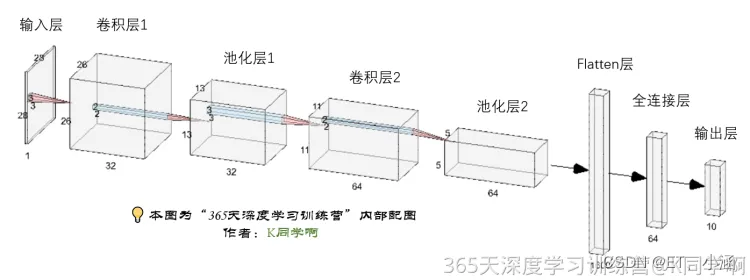

五 、构建CNN模型

卷积神经网络(CNN)的输入是张量 (Tensor) 形式的

(image_height, image_width, color_channels),包含了图像高度、宽度及颜色信息。不需要输入batch size。color_channels 为 (R,G,B) 分别对应 RGB 的三个颜色通道(color channel)。在此示例中,我们的 CNN 输入形状是(180, 180, 3)。我们需要在声明第一层时将形状赋值给参数input_shape

这是一个重难点,在构建模型之前,我们先来看一看各层有什么作用以及网络结构图

- 输入层:

输入层负责接收原始数据,将数据传递到网络中的第一层。 - 卷积层:

卷积层使用卷积核对输入数据进行滤波操作,以提取图像中的特征。 - 池化层:

池化层用于对卷积层的输出进行下采样,以减少数据的维度和计算量。 - Flatten层:

Flatten层用于将多维的输入数据(如卷积层的输出)压缩成一维的向量。

常用在卷积层到全连接层的过渡,将卷积层输出的特征图展平成一维向量,以便输入到全连接层中进行分类或回归等任务。 - 全连接层:

全连接层起到“特征提取器”的作用,将前面层的特征表示映射到输出层。 - 输出层:

输出层负责输出模型的预测结果。

ReLu函数作为激活励函数可以增强判定函数和整个神经网络的非线性特性,而本身并不会改变卷积层;

相比其它函数来说,ReLU函数更受青睐,这是因为它可以将神经网络的训练速度提升数倍,而并不会对模型的泛化准确度造成显著影响。

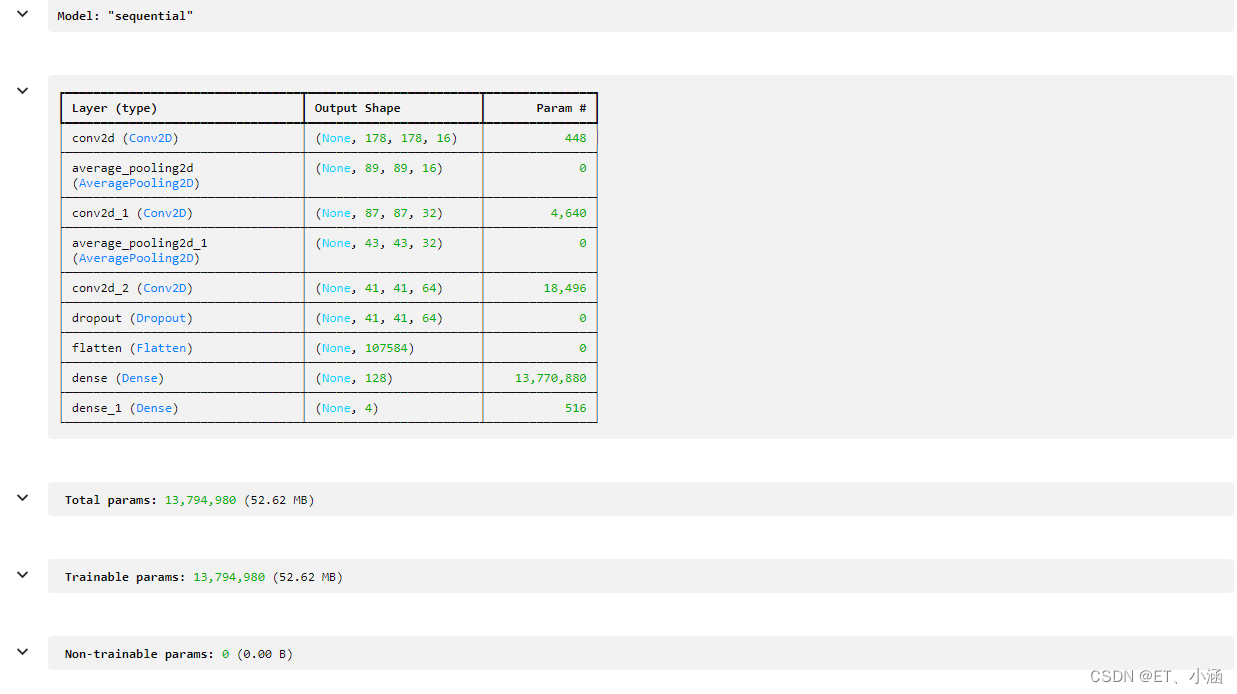

num_classes = 4

model = models.Sequential([

layers.experimental.preprocessing.Rescaling(1./255, input_shape=(img_height, img_width, 3)),

layers.Conv2D(16, (3, 3), activation='relu', input_shape=(img_height, img_width, 3)), # 卷积层1,卷积核3*3

layers.AveragePooling2D((2, 2)), # 池化层1,2*2采样

layers.Conv2D(32, (3, 3), activation='relu'), # 卷积层2,卷积核3*3

layers.AveragePooling2D((2, 2)), # 池化层2,2*2采样

layers.Conv2D(64, (3, 3), activation='relu'), # 卷积层3,卷积核3*3

layers.Dropout(0.3), # 让神经元以一定的概率停止工作,防止过拟合,提高模型的泛化能力。

layers.Flatten(), # Flatten层,连接卷积层与全连接层

layers.Dense(128, activation='relu'), # 全连接层,特征进一步提取

layers.Dense(num_classes) # 输出层,输出预期结果

])

model.summary() # 打印网络结构

五、编译模型

具体函数解释参考上周博客或者K同学啊的博客!

# 设置优化器

opt = tf.keras.optimizers.Adam(learning_rate = 0.001)

model.compile(optimizer = opt,

loss = tf.keras.losses.SparseCategoricalCrossentropy(from_logits = True),

metrics = ['accuracy'])

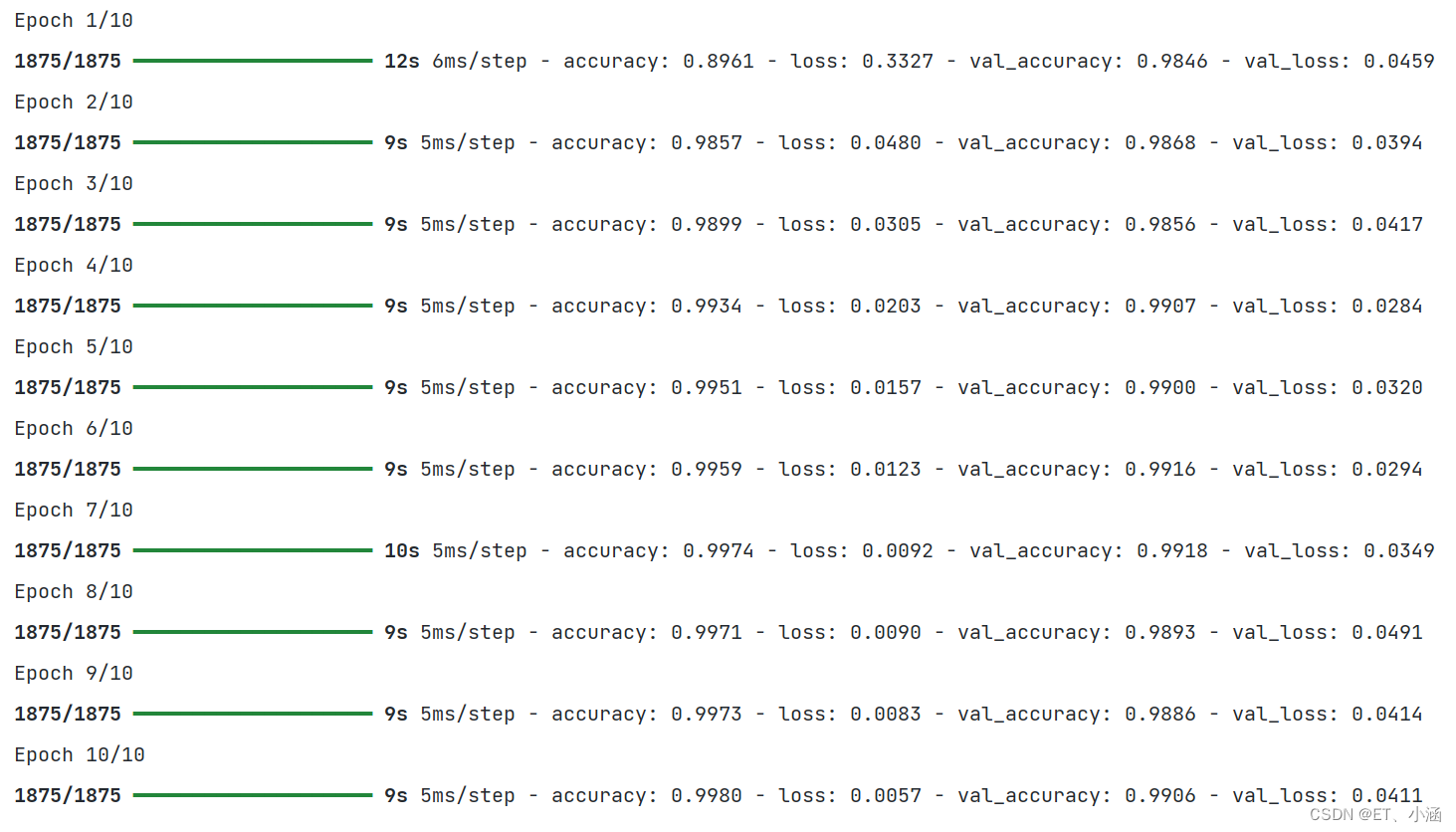

六、训练模型

# 设置输入训练数据集(图片及标签)、验证数据集(图片及标签)以及迭代次数epochs(10个)

epochs = 10

history = model.fit(

train_ds,

validation_data = val_ds,

epochs = epochs

)

七、预测

1、Accuracy图

import matplotlib.pyplot as plt

# 绘制训练过程中的准确率曲线

plt.plot(history.history['accuracy'], label = 'accuracy')

plt.plot(history.history['val_accuracy'], label = 'val_accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.ylim([0.5, 1])

plt.legend(loc = 'lower right')

plt

结果:

八、总结

通过本周学习,复习了如何写一个完整的深度学习程序,初步了解到了我们可以对数据进行随机翻转、缩放、旋转来进行数据增强,提高我们模型的学习率以及防止过拟合;

806

806

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?