TensorFlow实现经典深度学习网络(4):TensorFlow实现ResNet

ResNet(Residual Neural Network)——微软研究院何凯明团队提出的Residual Networks,其通过使用Residual Unit成功训练了152层深的神经网络,在ILSVRC 2015上大放异彩,获得第一名的成绩,取得3.57%的top-5错误率,效果非常突出。ResNet的结构可以极快地加速超深网络的训练,模型的准确率也有非常大的提升。而且Deep Residual Learning for Image Recognition(论文地址Paper)也获得了CVPR2016的best paper,实在是实至名归。本文将介绍ResNet的基本原理,以及TensorFlow如何实现它。

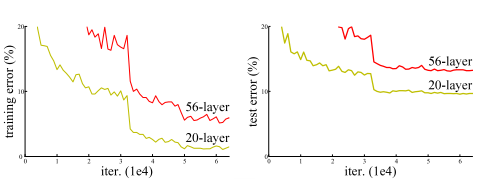

ResNet最初的灵感出自这个问题:深度学习网络的深度对最后的分类和识别的效果有着很大的影响,所以正常想法就是能把网络设计的越深越好,但是事实上却不是这样,常规的网络的堆叠(plain network)在网络很深的时候,效果却越来越差了,即准确率会先上升然后达到饱和,在持续增加深度则会导致准确率下降。

ResNet残差网络:

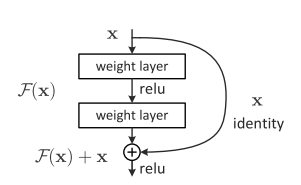

• 核心组件Skip/shortcut connection

• Plain net: 可以拟合出任意目标映射H(x)

• Residual net

•可以拟合出任意目标映射F(x),H(x)=F(x)+x

•F(x)是残差映射,相对于identity来说

•当H(x)最优映射接近identity时,很容易捕捉到小的扰动

这并不是过拟合的问题,因为不光在测试集上误差增大,训练集本身误差也会增大。为解决这个问题,作者提出了一个Residual的结构:

使用全等映射直接将前一层输出传到后面的思想,即增加一个identity mapping(恒等映射),就是ResNet的灵感来源。假定某段神经网络的输入是x,期望输出是H(x),如果我们直接把输入x传到输出作为初始结果,那么此时所需要学的函数H(x)转换成F(x)+x。上图为ResNet的残差学习单元,相当于将学习目标改变了,这一想法也是源于图像处理中的残差向量编码,通过一个reformulation,将一个问题分解成多个尺度直接的残差问题,能够很好的起到优化训练的效果。

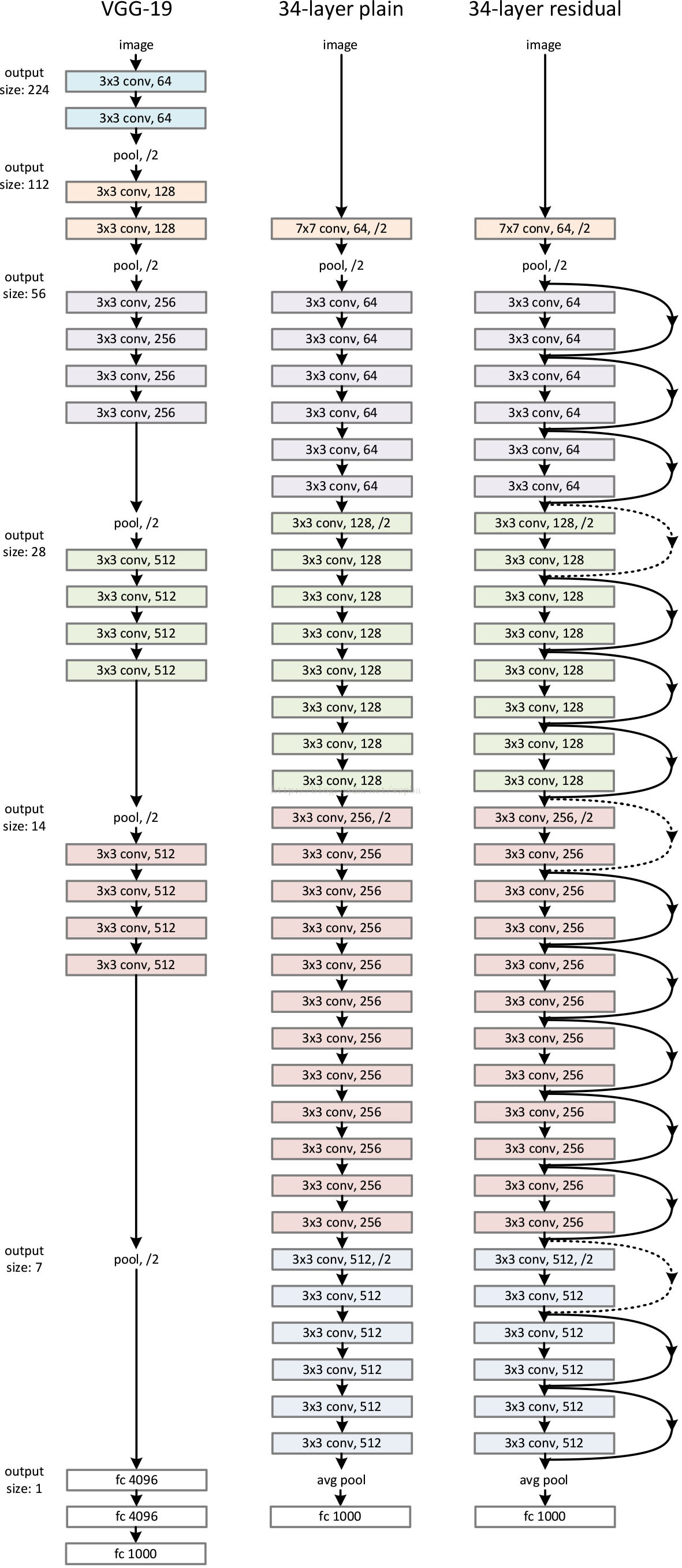

• 其他设计

•全是3x3卷积核

•卷积步长2取代池化

•使用Batch Normalization

•取消

•Max池化

•全连接层

•Dropout

上图为VGGNet-19,以及34层深的普通卷积网络,和34层深的ResNet网络对比图。我们可以看到最大区别在于,ResNet有很多旁路将输入直接连到后面的层,使得后面的层可以直接学习残差,这种结构成为shortcut或skip connections。虽在plain上插入了shortcut结构,但这两个网络的参数量、计算量相同,而且ResNet的效果非常好,收敛速度比plain的要快得多。

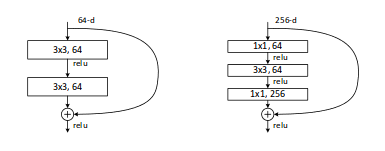

• 更深网络:根据Bootleneck优化残差映射网络

• 原始:3x3x256x256至3x3x256x256

• 优化:1x1x256x64至3x3x64x64至1x1x64x256

除了两层的残差学习单元,还有残层的残差学习单元,这相当于对于相同数量的层又减少了参数量,因此可以拓展成更深的模型

两层及三层的ResNet残差模块

ResNet有50、101、152层等的神经网络&#x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5525

5525

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?