1、xgboost是什么

全称:eXtreme Gradient Boosting

作者:陈天奇(华盛顿大学博士)

基础:GBDT

所属:boosting迭代型、树类算法。

适用范围:分类、回归

优点:速度快、效果好、能处理大规模数据、支持多种语言、支 持自定义损失函数等等。

缺点:发布时间短(2014),工业领域应用较少,待检验

2、基础知识,GBDT

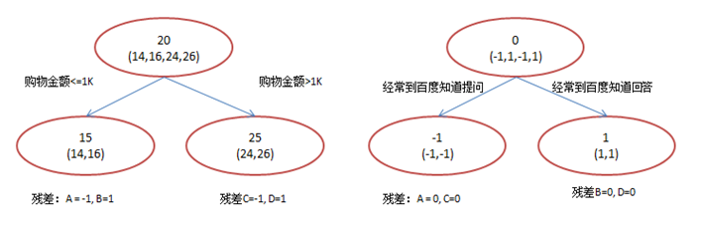

xgboost是在GBDT的基础上对boosting算法进行的改进,内部决策树使用的是回归树,简单回顾GBDT如下:

回归树的分裂结点对于平方损失函数,拟合的就是残差;对于一般损失函数(梯度下降),拟合的就是残差的近似值,分裂结点划分时枚举所有特征的值,选取划分点。

最后预测的结果是每棵树的预测结果相加。

3、xgboost算法原理知识

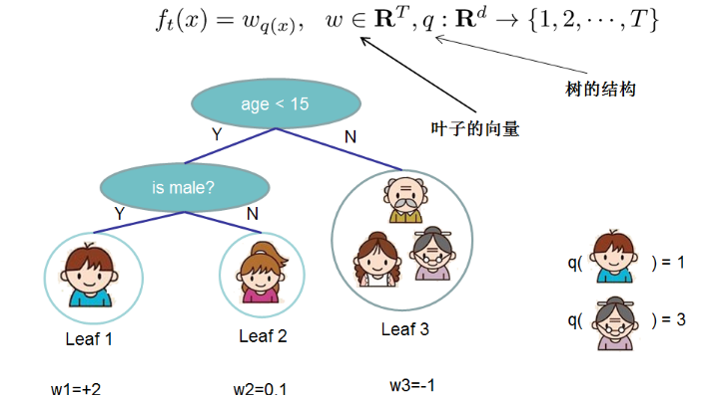

3.1 定义树的复杂度

把树拆分成结构部分q和叶子权重部分w。

树的复杂度函数和样例:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2234

2234

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?