spark有两种不同的交互式运行环境:一种是给python语言提供的(pyspark),一种是给scala语言提供的。

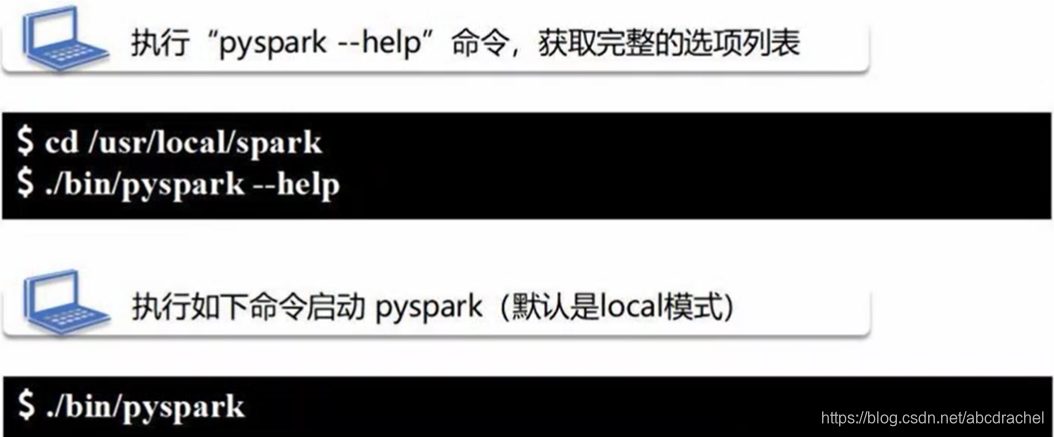

如何进入pyspark?

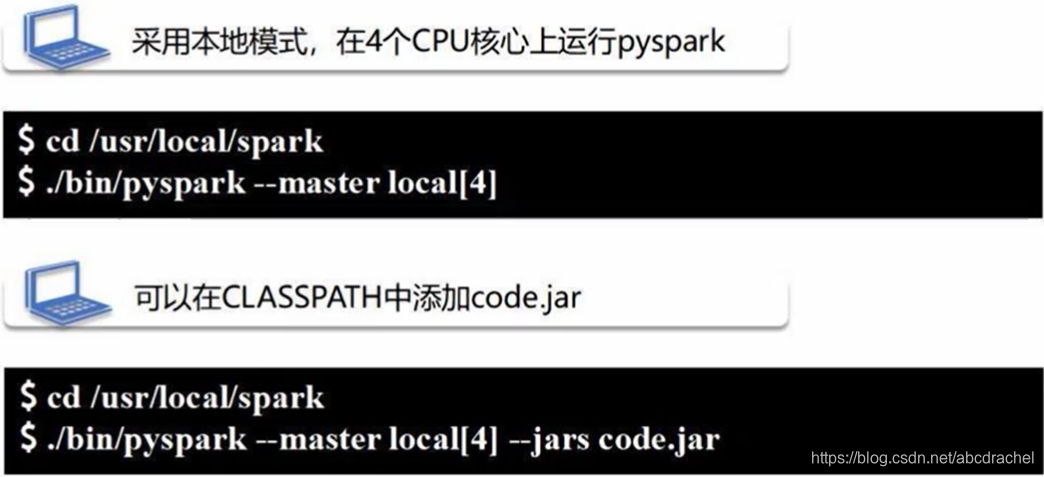

假设现在已经进入linux环境了,然后执行以下命令进入pyspark中:

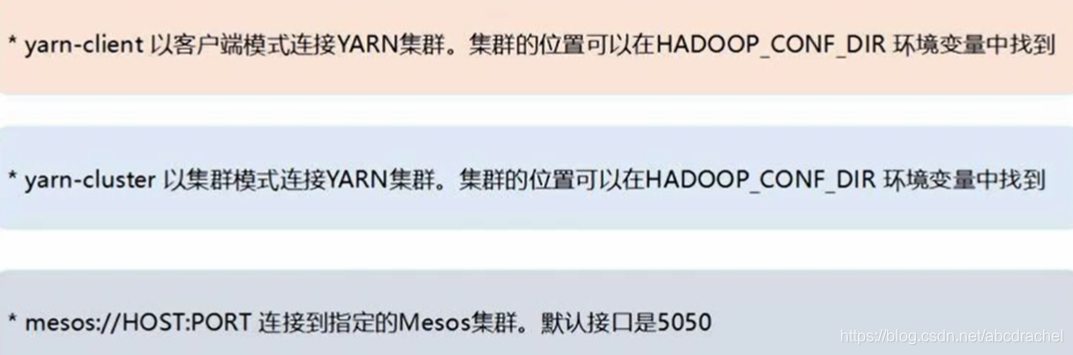

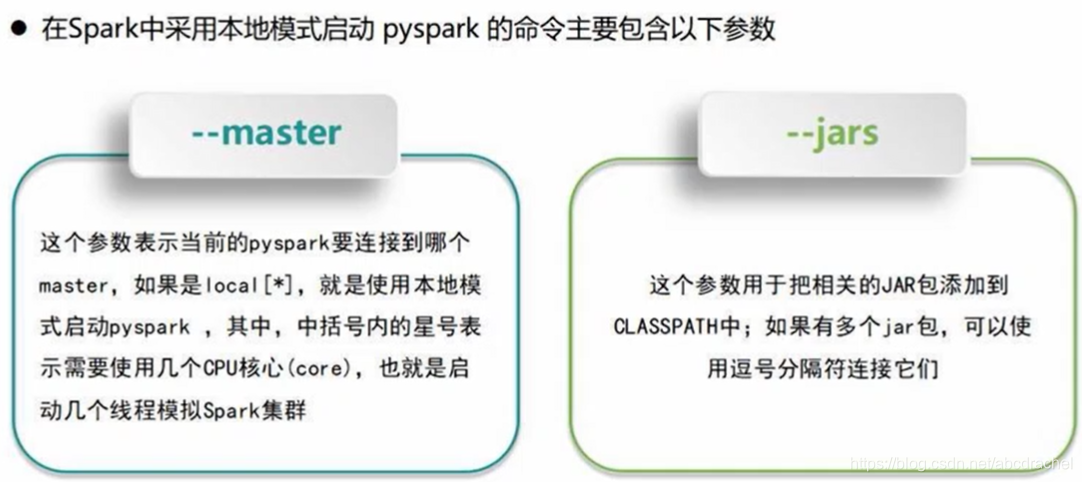

master-url的值可取以下值:

local[*] 逻辑CPU的个数 = 整个物理CPU的个数 * 每个CPU的核数

最后一个连接集群 HOST:主机名 PORT:端口号

集群模式:

spark应用程序

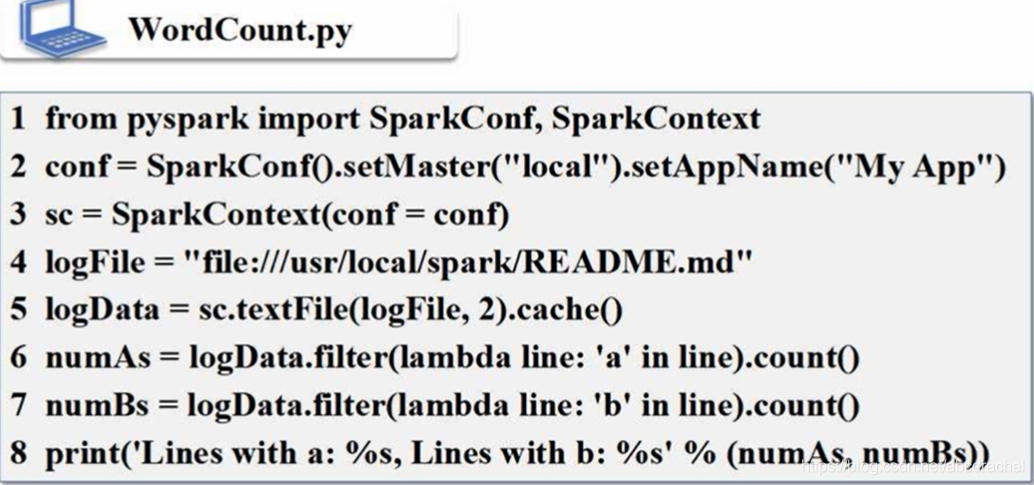

1:导入相应类

2:生成配置的上下文信息

3:生成sparkcontext对象,即生成名为sc的指挥官

4:本地文件地址

5:该句将文本文件加载进来生成一个rdd

6:logData为rdd的名称,对rdd进行过滤所有包含a的行

1646

1646

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?