【Linear Regression with One Variable】

1. 单变量线性回归模型

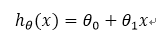

单变量线性回归是通过给出的样本变量与输出,预测一个变量的对应输出,属于监督学习。单变量与预测输出之间的函数关系的一般化定义如下:

我们可以看出,对于不同的

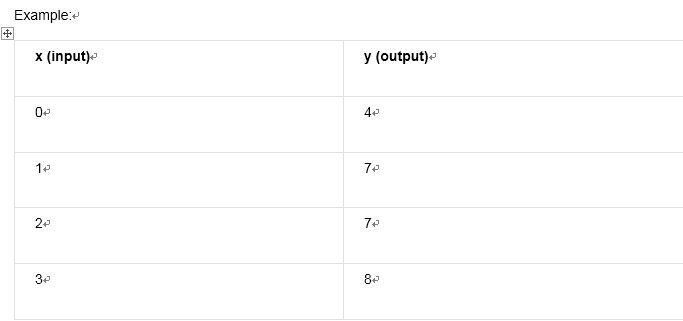

例如给定样本如下:

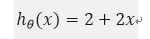

我们随意猜测

当x=1时,预测输出为2+2*1=4,与真实输出之间的误差为3。为了衡量预测的正确性,下面引入Cost Function(代价函数)。

2. 代价函数

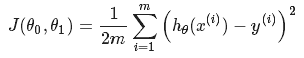

定义代价函数如下:

即为均方误差(Mean squared error)的二分之一。当该代价函数值越小,预测结果越好,也就是说线性回归函数

那么我们的目标就是找到合适的

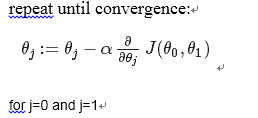

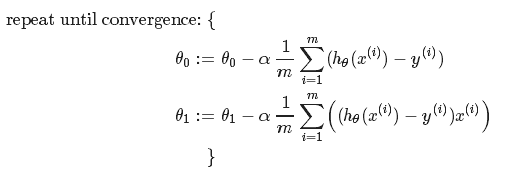

3. 梯度下降法找最佳 、

、

,其中α为学习率(自已定义的,不能太大,也不能太小),代价函数

注意:

当

4056

4056

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?