这是2015年NIPS的一篇经典的剪枝文章,由韩松大神所作,由于年代比较久远,所以就大概说一下它的重点内容,以便给模型剪枝有个初始印象。

Introduction

文章首先讲了LeNet、AlexNet和VGG这些当时经典的网络的参数量的非常大,同时需要的存储空间也越来越大;然后以能量消耗的角度谈了这些模型运行具体能消耗多少能量。这就引出了本文的目标,就是对较大的网络模型进行剪枝以降低能量消耗从而能在移动端实时运行。

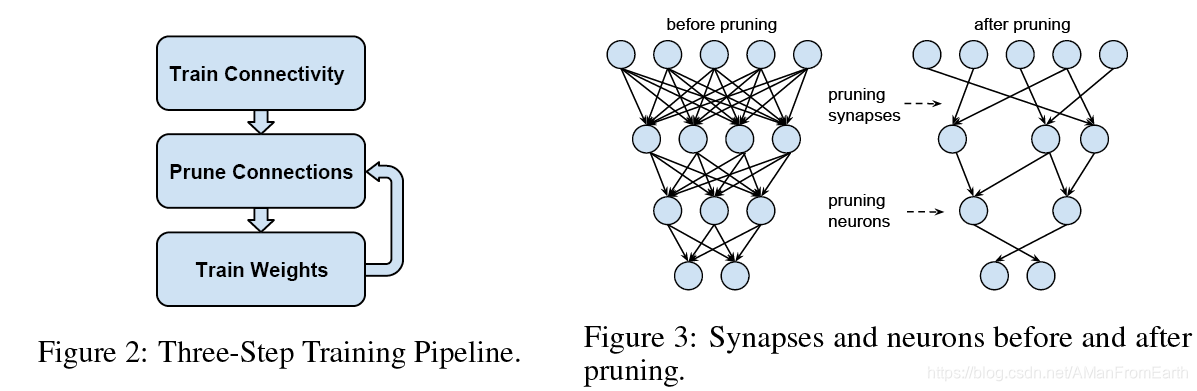

文章提出的剪枝策略是:①在初始模型训练完成后,②移除权重低于特定阈值的所有连接,即从稠密连接的网络剪枝得到一个稀疏连接的网络,③然后重新训练得到的网络用来减小精度损失。其中,②③两步可以多次迭代进行以得到最优模型。如图所示:

该策略能在剪枝后还能保持原有的精度几乎不损失。

Learning Connections in Addition to Weights

这

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

529

529

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?