点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

添加微信号:CVer111,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

组织机构:台湾大学, UC Merced, Google

论文:https://arxiv.org/abs/2405.10589

主页:https://apgcc.github.io/

簡介:

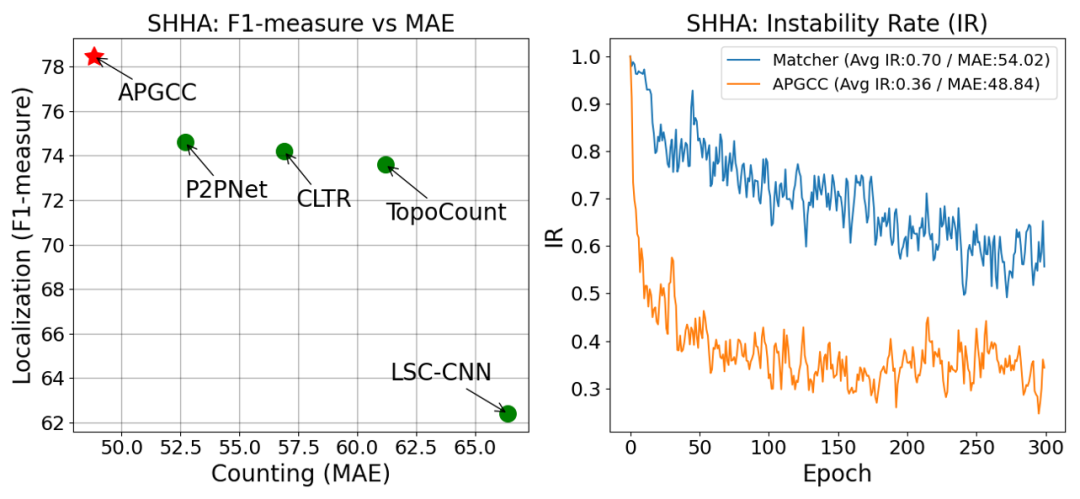

人群计数与定位(Crowd Counting and Localization) 是一种计算机视觉技术,用于估算图像或视频中的人数,并确定他们的精确位置,可应用于监控、事件管理和城市规划等重要领域。其中,基于点的人群计数(Point-based Crowd Counting) 可直接透过点标签(Point Annotation) 进行回归和预测学习,而不是依赖密度图(Density Map)和边界框(Bounding Box)等伪标签资讯。该方法在处理不同密度的人群和遮挡方面表现出色,提供了更高的准确性和精确性。然而,传统基于点的人群计数方法在训练过程仅依赖匹配策略进行训练,不稳定的匹配结果将导致训练目标不一致,不仅容易选择偏远的点提案(Point Proposal),更容易导致复杂区域产生高估或低估等现象(线条表示Proposal到预测点的可视化):

因此,本论文的目的在于提升点预测方法训练时的鲁棒性。我们提出了APGCC的模型,通过引入辅助点指导(Auxiliary Point Guidance, APG)来解决不稳定性的问题,使优化过程能够更加有效地区分潜在的正负匹配点,从而提高模型的鲁棒性和准确性,同时不产生额外的推理运算资源。

方法:

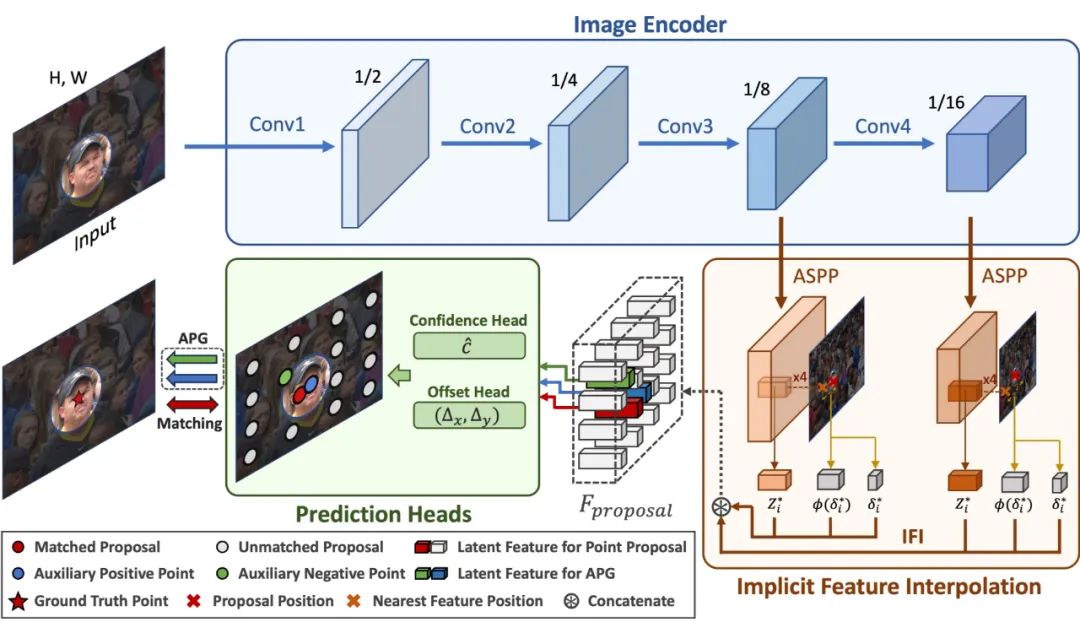

Overview of APGCC

上图显示了大致的训练流程,除了传统基于点的人群计数方法的Point Proposal预测、Proposal-Target匹配和损失函数计算外(红、灰色点表示),我们还提出了辅助点指导策略(Auxiliary Point Guidance, APG),以优化训练稳定度(蓝、绿色点表示)。此外,在解码的过程中引入了隐式特征插值(Implicit Feature Interpolation, IFI)模块,使模型能精确地获取任意点的特征表示,从而提升定位准确性和鲁棒性。整體訓練過程包括以下步驟:

特征提取:使用预训练好的骨干网络(如VGG-16)提取影像特征。

多尺度特征融合:通过金字塔池化(ASPP)整合多尺度特征。

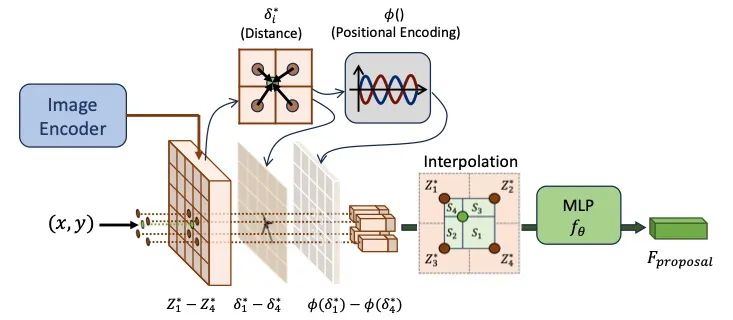

隐式特征插值:使用IFI模块解码过程计算所有位置的响应特征Fproposal。

置信度和偏移量预测:将每个独立的Fproposal输入置信(Confidence)和回归(Offset)模块,得到每个预测点的置信度和偏移量。

匹配与损失计算:使用匈牙利算法(Hungarian algorithm)进行Proposal-Target匹配,并针对每个点计算MSE点回归和Cross Entropy损失。然而,仅依赖匹配策略进行学习容易导致优化过程不稳定。因此,我们引入了APG模块,为模型提供明确的学习目标,从而提高稳定性和准确性。

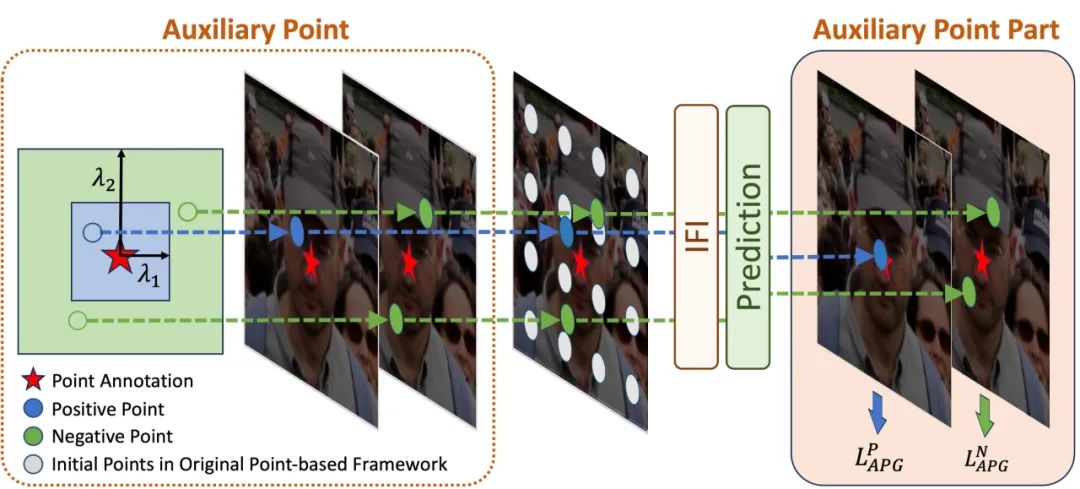

Auxiliary Point Guidance (APG)

APG模块旨在通过引入辅助点来增强基于点的人群计数和定位方法的稳定性和准确性。这一策略可以分为两部分:

正辅助点(Auxiliary Positive Points):

这些辅助点由真实标签点加上些微空间噪声产生于每个真实标签点附近。

用于提高正匹配点的置信度和预测偏差的精度。

通过确保正辅助点的置信度接近1和位置预测接近对应真实标签点,使模型倾向于选择最近点,提高定位精度和置信度。

负辅助点(Auxiliary Negative Points):

这些辅助点由真实标签点加上较大噪声生成。

旨在防止负匹配点通过偏差接近真实标签点。

负辅助点的置信度和偏差应尽可能接近0,避免负匹配点邻近于匹配点,从而提高匹配过程的稳定性。

Implicit Feature Interpolation (IFI)

为了在任意位置有效插入辅助点并增强特征座标与真实座标之间的对齐,我们提出了隐式特征插值(Implicit Feature Interpolation)。IFI的具体步骤包括:

邻近特征提取:找寻目标座标的四个邻近特征向量,以及各自对应的空间距离和位置编码信息。

特征转换:将这些信息共同输入到多层感知机(MLP)进行连续特征转换。

特征合并:通过插值方法合并四项参考特征以得到最终特征表示。通过在特征空间进行连续性转换,模型能够更好地捕捉场景中的细微差异,从而提高整体预测能力。

实验结果:

此篇论文做了许多实验来证明其有效性。

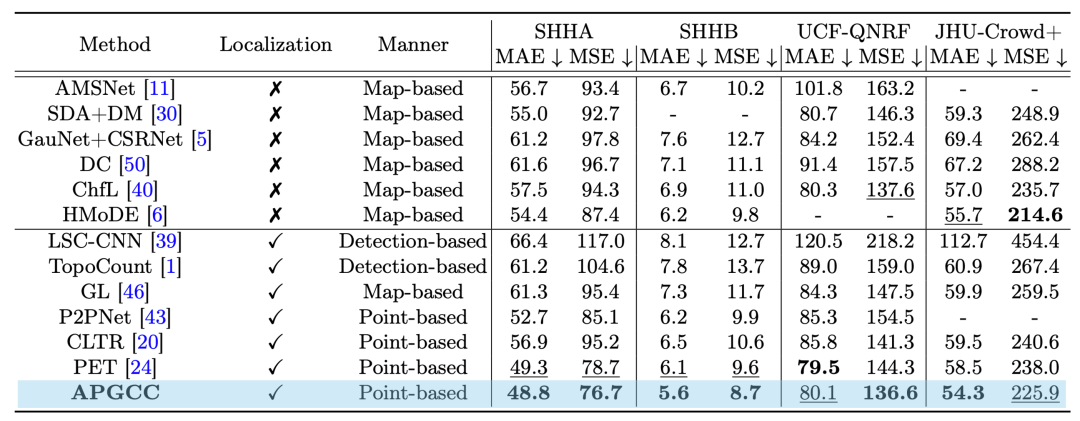

人群计数量化比较(Crowd Counting Quantitative Comparison)

论文在多个数据集上进行了测试,包括SHHA、SHHB、UCF-QNRF和JHU-Crowd++数据集。

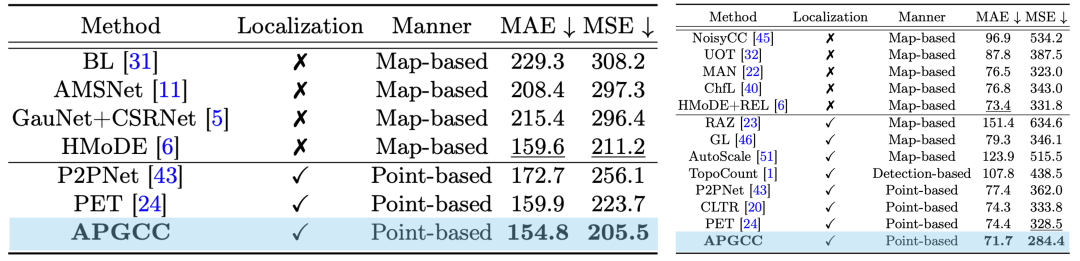

此外,论文还在UCF_CC_50和NWPU Testing Set数据集上进行了测试。

从以上结果得知,AGPCC方法能有在不同密度和复杂场景下表现得更加稳定和鲁棒,能有效区分正负预测点,提高整体性能。

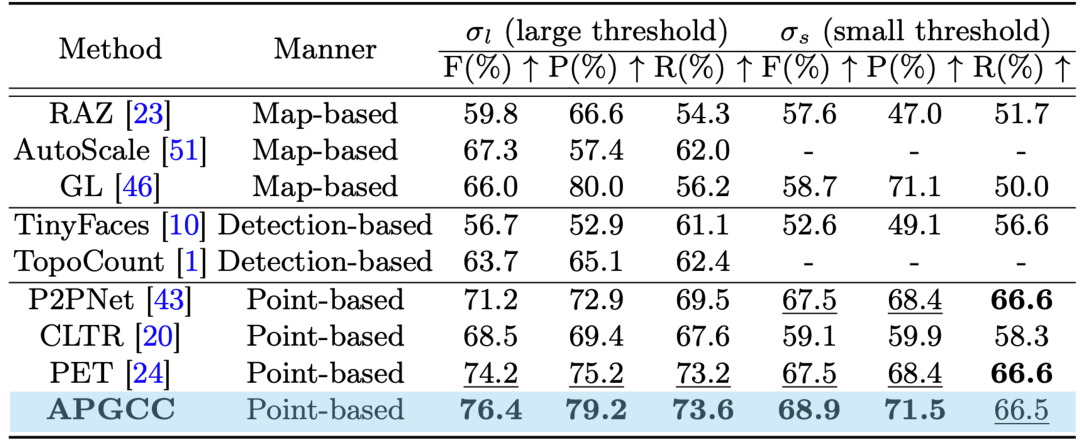

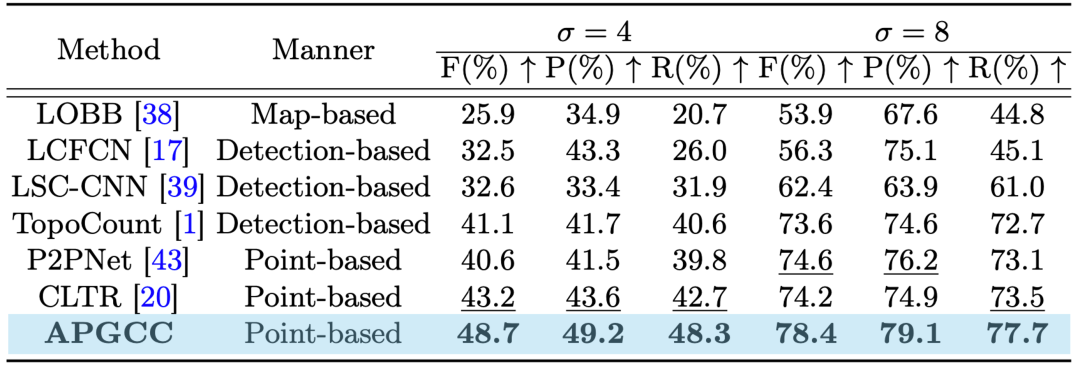

人群定位量化比较(Crowd Localization Quantitative Comparison)

论文还进行了人群定位的量化比较实验,主要在NWPU Testing Set和SHHA数据集上进行测试。

由以上结果分析,与其他现有基于点的人群际数方法相比,APGCC框架通过正辅助点指导回归预测以及IFI增强特征表示,达到更精确地定位人群中独立个体的效果。

可视化结果分析(Qualitative Analysis)

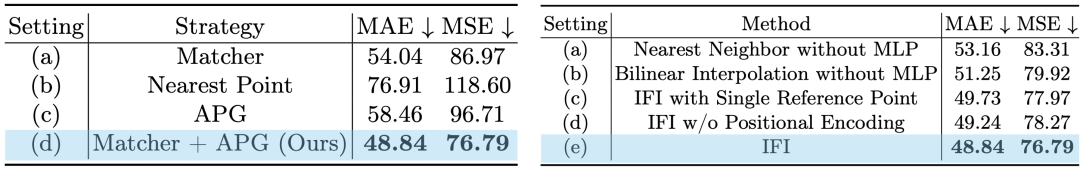

消融实验(Ablation Study)

APG策略有效性分析 & IFI模块有效性分析。

从消融实验结果中可以得到以下结论:

APG策略:直接匹配邻近点可能导致低估,Matcher用于训练模型学习置信度,而APG提供成对正负样本,弥补直接匹配策略的不足。因此,Matcher + APG组合策略在提供明确训练目标和有效判别正负预测点方面达到最佳表现。

IFI模块:结合了插值的优势,通过空间距离信息和MLP实现特征空间中的连续性转换,显著增强了任意位置的特征表示,提高了模型整体性能。

结语

本文提出APGCC模型,用以改善传统基于点的人群计数在学习过程中的不稳定问题。通过引入辅助点和精确的特征表示方法,APGCC大大提升了模型优化过程中区分正负样本的能力,同时增强了在各种复杂场景下计数准确性和定位的精度。这一创新方法为人群计数和定位技术的发展提供了新的方向和思路。

何恺明在MIT授课的课件PPT下载

在CVer公众号后台回复:何恺明,即可下载本课程的所有566页课件PPT!赶紧学起来!

ECCV 2024 论文和代码下载

在CVer公众号后台回复:ECCV2024,即可下载ECCV 2024论文和代码开源的论文合集CVPR 2024 论文和代码下载

在CVer公众号后台回复:CVPR2024,即可下载CVPR 2024论文和代码开源的论文合集Mamba、多模态和扩散模型交流群成立

扫描下方二维码,或者添加微信号:CVer111,即可添加CVer小助手微信,便可申请加入CVer-Mamba、多模态学习或者扩散模型微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF、3DGS、Mamba等。

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba、多模态学习或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群▲扫码或加微信号: CVer111,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集上万人!

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号

整理不易,请赞和在看

3736

3736

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?