1 基本概念

(1)数据库邻近性:对于两个数据库D和D',它们之间仅有一个个体数据不同

(2)敏感性:对于查询函数f,其敏感性定义为从数据库D和D'的任意邻近数据库的查询差值的最大绝对值。

例如:数据库查询select count(*) from D where type="糖尿患者",由于类型只有糖尿患者和非糖尿患者,因此,查询结果最大改变为1,即敏感性为1

(3)概率敏感性:对于查询函数f,其概率敏感性考虑了使用随机化算法添加噪音或扰动的情况。它定义为从数据库D到D'的任意邻近数据库,通过随机化算法添加噪音后,查询结果的最大差值的概率:

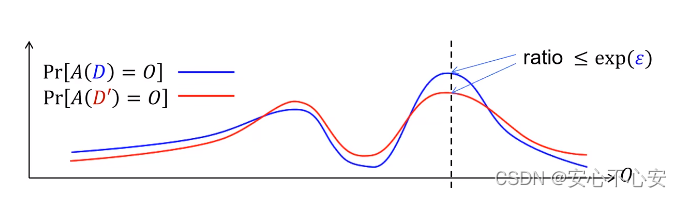

2 差分隐私定义

一随机算法A满足ε-差分隐私,当且仅当

对任意“相邻”数据集D和D'及任意输出O都成立,则称算法满足ε-差分隐私

3 差分隐私常用机制及代码实现

3.1 拉普拉斯机制(严格差分隐私)

拉普拉斯机制(Laplace Mechanism)是差分隐私中最常用的随机化机制之一,用于在查询结果中添加噪音以保护个体隐私。它基于拉普拉斯分布(Laplace Distribution),通过向查询结果添加服从拉普拉斯分布的噪音来实现隐私保护。

拉普拉斯分布是一个以0为均值、尺度参数为λ的对称指数分布,其概率密度函数定义如下:

敏感度:

以下证明拉普拉斯机制满足ε-差分隐私,有:

这里,令λ=S(f)/ε即可得拉普拉斯机制满足差分隐私条件。其中,ε也叫做隐私预算,ε越大,噪声越小,ε越小,噪声越大

以下是python代码实现拉普拉斯机制加噪

"""

@Time : 2023/10/8 0008 15:49

@Auth : yeqc

"""

# 基于 拉普拉斯机制的 差分隐私方法,拉普拉斯噪声 (1/2λ)*exp(-x/λ)

import numpy as np

class LaplaceDiffPrivacy:

def __init__(self, epsilo):

self.epsilo = epsilo

def add_noise(self, data):

# 计算拉普拉斯噪声的尺度,b = λ,一般取sensitive/epsilo,sensitive(敏感度)是指改变一个人数据查询结果改变的最大值

sensitive = 1

lamda = sensitive / self.epsilo

# 生成拉普拉斯噪声,这里另随机种子random_state = 42 让它每次运行产生的噪声都一样

noise = np.random.laplace(loc=0.0,scale=lamda,size=len(data))

# 加噪后的数据

noised_data = data + noise

return noised_data

dp_laplace = LaplaceDiffPrivacy(epsilo=0.1)

data = [i for i in range(1, 11)]

noise_data = dp_laplace.add_noise(data)

print(noise_data)

3.2 高斯机制(松弛差分隐私)

高斯机制(Gaussian mechanism)是差分隐私中一种常用的连续机制,用于在查询结果中引入噪声以保护隐私。其核心思想是在真实查询结果上添加来自正态分布的随机噪声。

高斯分布是一种连续型的概率分布,具有钟形曲线的特征。它由两个参数完全描述:均值(μ)和标准差(σ)。均值决定了分布的中心位置,标准差决定了分布的广度和分布的峰值。

其中,μ一般取0,σ=S(f)/ε通过控制 σ的取值可以决定噪声的尺度。高斯机制中敏感度定义为:

以下是python代码实现高斯机制加噪

"""

@Time : 2023/10/15 0015 19:09

@Auth : yeqc

"""

# 基于 高斯机制的 差分隐私方法

import numpy as np

class GaussianDiffPrivacy:

def __init__(self, epsilo):

self.epsilo = epsilo

def add_noise(self, data):

sensitve = 1

# 高斯噪声中的标准差

noise_stddev = sensitve / self.epsilo

# np.random.normal()函数生成均值为loc=0、标准差为noise_stddev的高斯噪声

noise = np.random.normal(loc=0.0, scale=noise_stddev, size=len(data))

# 加噪后的数据

noised_data = data + noise

return noised_data

dp_gaussian = GaussianDiffPrivacy(epsilo=0.1)

data = [i for i in range(1, 11)]

noised_data = dp_gaussian.add_noise(data)

print(noised_data)

354

354

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?