哈喽,我是子牙,一个很卷的硬核男人

深入研究计算机底层、Windows内核、Linux内核、Hotspot源码……聚焦做那些大家想学没地方学的课程。为了保证课程质量及教学效果,一年磨一剑,三年先后做了这些课程:手写JVM、手写OS、带你用纯汇编写OS、手写64位多核OS、实战Linux内核…

最近在备课《实战Linux内核》内存专题,把NUMA好好研究了一下,写成文章,Mark一下,顺便分享给有缘人

NUMA是什么呢?一种内存访问架构,与它相对应的是SMP架构,它俩之间有什么区别呢?既然有了SMP架构,又为什么会出现NUMA架构呢?等下解释

回到这篇文章的主题,为什么我说不深入理解NUMA,就看不懂Linux内核?因为Linux内核的内存模块是基于NUMA架构设计的,而几乎所有的内核模块,都是基于内存模块起家的。你可能要问:那SMP架构怎么办?等下会讲到

关于NUMA,我研究了哪些呢:

- Linux内核是如何取到所有的NUMA节点的信息的?为此我还在我之前写的64位多核操作系统上把代码写出来了,才得以真正理解,等下展示给大家看。所以我说,你只有有能力写一个Linux内核,你才有能力自己去研究Linux内核,才能真正玩明白,否则只能听别人告诉你!

- CPU个数、CPU核、CPU线程与NUMA节点之间的关系

- Linux内核在当前NUMA节点内存不足的时候,会去相邻节点分配内存,相邻节点的定义标准是什么?

- 每个NUMA节点都是从地址0开始的吗?还是跟SMP架构是一样的,每个NUMA节点占一段内存,那每个NUMA节点占多少内存呢?是平均分配吗?还是可以配置?那如何配置呢?

- Linux内核中的ZONE_DMA、ZONE_DMA32、ZONE_NORMAL、ZONE_HIGHMEM与NUMA节点又是怎样的关系?

- Linux内核中的内存空洞(unused hole)到底是什么?

以下,enjoy

NUMA vs SMP

先来点铺垫知识,让我们在此处达成共识

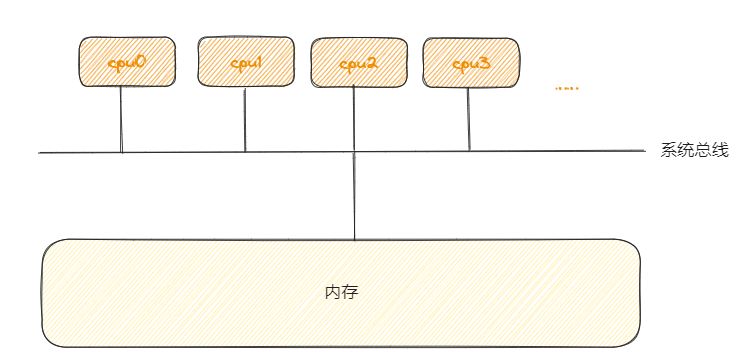

我们平时接触的设备都是SMP架构,只有一个内存节点,所有CPU通过总线访问内存

那NUMA架构呢?每个CPU有其直接访问的内存,当前CPU能直接访问的内存不够时,还可以去兄弟节点分配内存,这就是Linux内核中讲的去相邻节点分配内存

这个有点像Java虚拟机hotspot中的TLAB,线程私有内存(堆),解决高并发。NUMA实现的是CPU私有内存。毕竟一个是虚拟机,一个是硬件本身,解决问题的维度就不同。所以你看,思想是相通的

那什么样的设备用NUMA架构呢

有了SMP架构,为什么还要NUMA架构,因为SMP架构下,所有的核都要通过总线去访问内存,为了支持高并发,我们一般都要用到CPU提供的原子指令,原子指令的底层一般是通过锁总线或者CPU缓存实现的。

我们就拿锁总线来理解,比如CPU0要原子访问内存,其他CPU核就无法访问内存,可以想象在高并发场景下,这样的硬件性能如何。只要有一个核要访问内存,其他核都要等待,直到那个核释放总线

总结一下:SMP架构简单,但是在CPU核特别多的场景下,原子访问内存的开销很大,所以衍生了NUMA架构。一般新的技术是为了解决旧技术存在的问题,同时带来的是更高的复杂性。

Linux2.6内核被看成是Linux内核发展的里程碑,因为这个版本引入了很多新特性,NUMA也是这个版本引入的。你对比看下2.6前后的内核源码,你会发现2.6以后的内存模块的代码,对比之前的,要复杂很多很多。接下来我们就来讲讲,Linux内核是如何支持NUMA的

NUMA在Linux中的存在形式

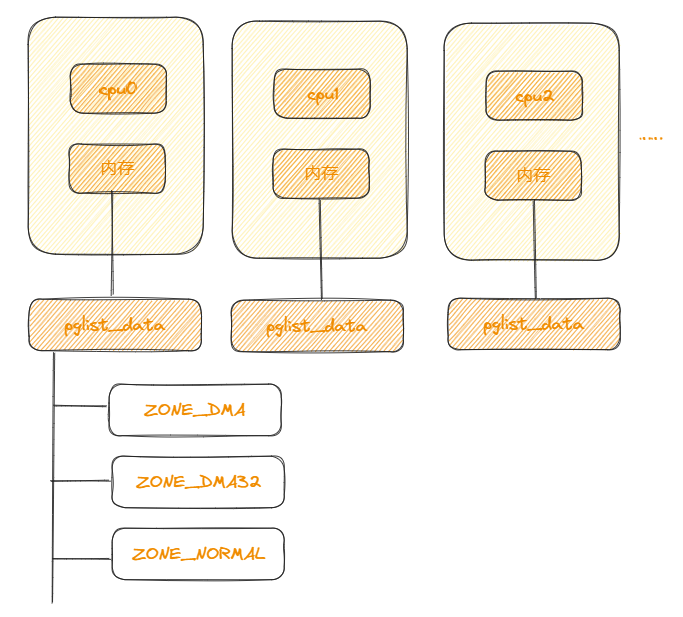

来张可以说明一切的图

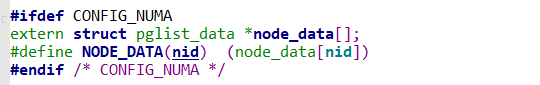

在Linux内核中,每个NUMA节点用结构体pglist_data来描述。那SMP架构呢?Linux内核会当成只要一个NUMA节点来处理

图中的ZONE_DMA、ZONE_DMA32、ZONE_NORMAL又是什么?这就要说到64位Linux内核要兼容硬件、32位等各种兼容问题,所以将内存拆成了一个一个的zone,理解这个对Linux内核非常非常重要

什么是DMA,你可以理解成主板提供的一种机制,能够在CPU不参与的情况下读写数据,大大节省了CPU的性能。有些主板提供的DMA只能访问低16M内存,所以有ZONE_DMA,有些32位主板提供的DMA能够访问4G以内的内存,所以有ZONE_DMA32。

32位CPU开启PAE的情况下,能够访问的物理内存超过4G,29912分页下,最多可访问的物理内存是64G,因此设立了ZONE_HIGHMEM。这个区域只在32位Linux内核中存在,4G-64G内存在这个ZONE中。16M-4G之间的内存,就是ZONE_NORMAL区域

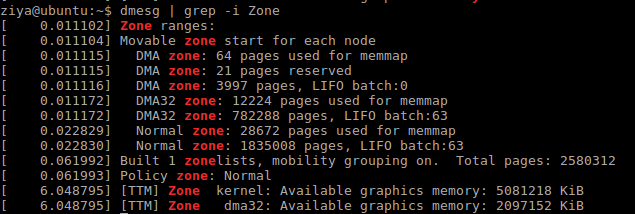

看下64位Linux内核中存在的Zone

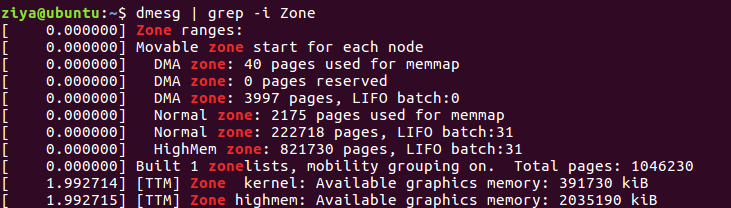

再看下32位Linux内核中存在的Zone。你觉得为什么没有ZONE_DMA32呢?留言区告诉我你的答案

最后看下Linux内核中,我的启动参数如下

我设置的机器有4个CPU,两个NUMA节点,每个NUMA节点的内存容量是2.5G

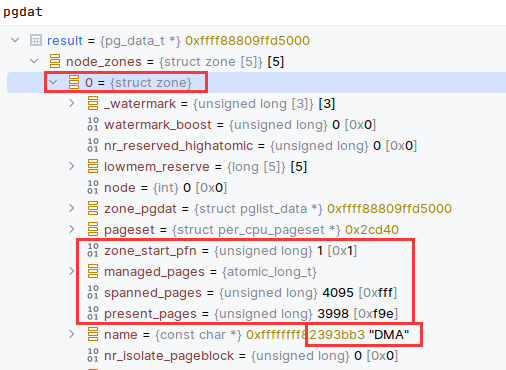

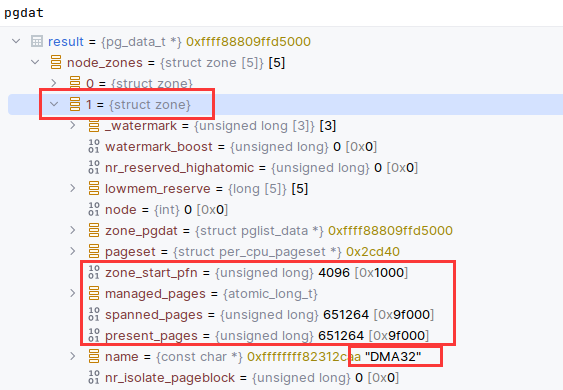

看下NUMA节点0的ZONE_DMA,看zone_start_pfn、spanned_pages,内存范围是从1-0xffffff,图中显示的是页数,要乘以4096才是真实的内存大小

按理说这个访问应该是0-0xffffff,为什么是从1开始的,我问了下chatgpt

看下NUMA节点0的ZONE_DMA32,你是不是想问这些数据是怎么来的,等下就会讲到

NUMA节点1的ZONE_DMA,是空的。言外之意就是在NUMA架构中,每个CPU访问的内存不是从0开始的,是在前面的NUMA节点中的内存累加过来的

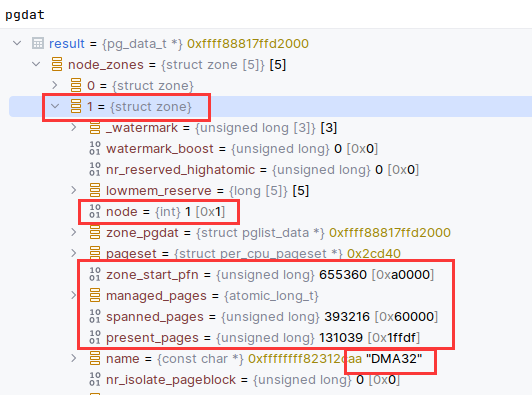

NUMA节点1的ZONE_DMA32

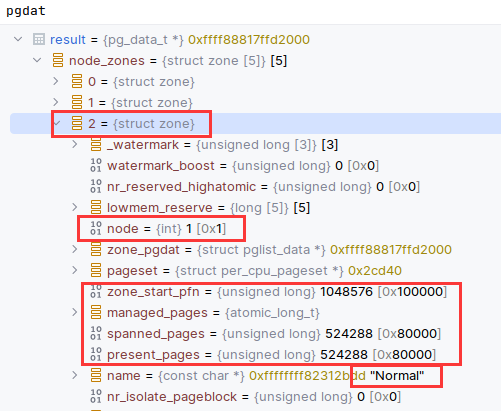

NUMA节点1的ZONE_NORMAL

我本来试图找一篇类似的文章也像我这样把这些东西讲清楚,真是找遍了都找不到,才发现,大家对Linux内核的理解,绝大多数都只是纸上谈兵而已!

数据怎么来的

我们自实现操作系统,或者是Linux内核、Windows内核,都需要获取到内存条的信息,那谁有这些信息呢?主板

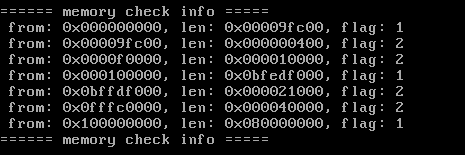

主板提供了e820功能让操作系统内核可以获取到内存信息,其中flag=2的区域就是所谓的内存空洞

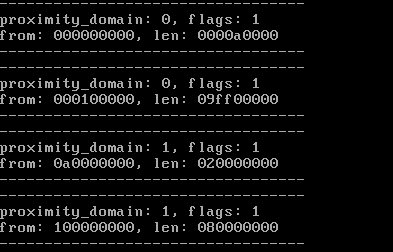

在NUMA架构下,e820功能返回的数据过于简单了,无法支持Linux内核支持NUMA架构,就需要通过ACPI获取到最正宗的NUMA信息

对比前面贴的Linux内核中各个ZONE的数据,是不是几乎一样呢?

这篇文章,应该是你看过的把Linux内核与NUMA讲的最透彻的文章吧!创作不易,能不能麻烦各位帮忙分享一下

如果你也想像我一样,能够自由使用各种技术、自由研究各种问题而不用等着别人告诉你答案……你得有能力写一个操作系统内核。

有能力写一个64位多核操作系统,是你能够玩转Linux内核的唯一方式!

1615

1615

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?