啊作为一个没学过线代的人……当初写eigenface的时候看PCA看了非常之久……

这里尽量简单的描述这个概念

啊全是随手画的图

基本介绍

需要知道的:

矩阵乘法的本质是坐标变换。

主要通过二维到一维的方式来通俗的描述一下PCA。定义什么可以参考维基之类的。

https://zh.wikipedia.org/wiki/%E4%B8%BB%E6%88%90%E5%88%86%E5%88%86%E6%9E%90

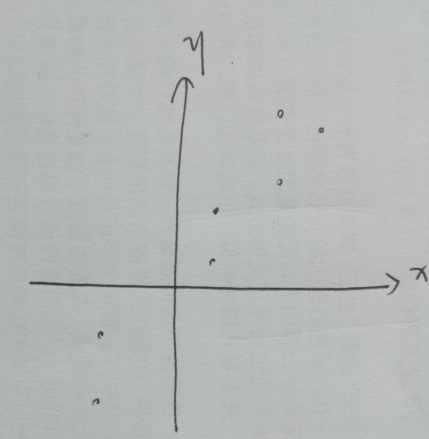

看到下面这幅图上有一堆的二维点。

那我们要找一个方式把他转换到一维的。

当然如果考虑非线性就很复杂了……这里就考虑线性的。

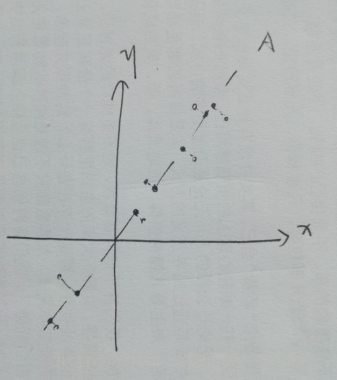

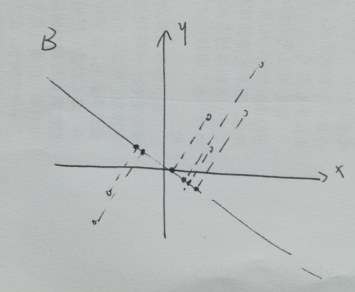

提供AB两种降维方式。实心的点是他们降到一维之后的坐标。

或许这个图看起来可以说是A这种降维【我无数次打出来姜维小哥哥】比较合理,直观上来讲

- 每个点的失真比较小(就空心点到实心点的距离比较小)

- 最后结果比较分散,也就是说在A这条直线上点的差异性得以保留,而在B这条直线上提取出来的更多是它们的共性。

主成分分析中,这种直观的判断方式,被确定为投影之后方差最大

(后来看资料发现两种定义都有)

而经过求解,这个向量正好对应协方差矩阵最大特征值对应的特征向量。(证明放在最后)

那么来一个直观一点的方式……【这里的一些符号定义和下面证明里一样】

如果求出的两个特征向量分别为【markdown公式啥时候那么丑了……预览不是这样的不是!】

a1=⎡⎣2√22√2⎤⎦ a 1 = [ 2 2 2 2 ]

a2=⎡⎣2√2−2√2⎤⎦ a 2 = [ 2 2 − 2 2 ]

那么降到特征空间之后得到的值为

PCA主成分分析是一种线性降维方法,通过找到数据最大方差的方向进行投影,以保留数据的主要特征。在二维到一维的转换中,PCA寻找使得点失真最小的直线,即方差最大的方向。降维后,可以通过特征向量还原数据,但可能会有失真。非人脸图像降维到人脸空间会导致重构失真。PCA简化计算时,当数据点数量少时,只需一个特征向量。PCA可能无法保证提取k维特征时结果最优,仅确保单个特征向量最大化方差。

PCA主成分分析是一种线性降维方法,通过找到数据最大方差的方向进行投影,以保留数据的主要特征。在二维到一维的转换中,PCA寻找使得点失真最小的直线,即方差最大的方向。降维后,可以通过特征向量还原数据,但可能会有失真。非人脸图像降维到人脸空间会导致重构失真。PCA简化计算时,当数据点数量少时,只需一个特征向量。PCA可能无法保证提取k维特征时结果最优,仅确保单个特征向量最大化方差。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7841

7841

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?