**

1. 线性回归的问题:

**

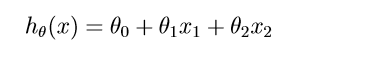

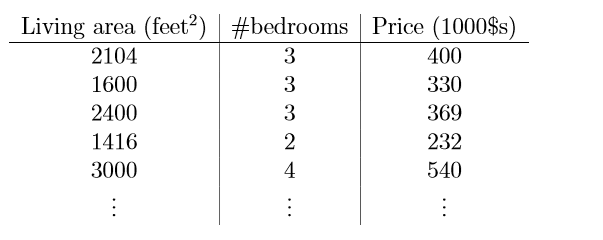

仍然使用andrew NG 机器学习课程中的第一个例子, 房价预测。 这里每个房屋有使用面积和卧室数两个属性, 在训练集中我们当然也有每个房间的价格。

我们学习的目标是找到

向量Θ,使得对每一个Xi有:Θ * X = Yi,对于所有的训练样本,构成矩阵A;A中第一列为全 1 ,使得:

就是要找到 A*Θ = y 的解;

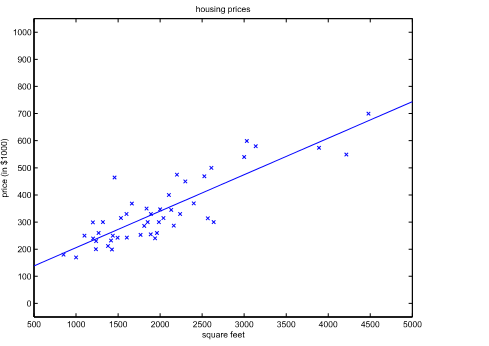

如果所有的样本都在一条直线上, 那么这个解是存在的 ,但是如上图所示这些样本并没有在一条直线上,所以这个问题可以转为求A*Θ = y 的最小二乘解。

2. 最小二乘问题:

对大型方程组求解, 通常会写成Ax = b 的形式, 其中A 为系数矩阵, x为要求解的变量构成的向量, b是方程组中“=” 右边的值构成的向量。

如果该方程组没有解 ,而我们又需要求解时一个好的办法就是用最近似的解来代替, 使得Ax 尽可能接近b。最小二乘问题就是找出使得|b-Ax|尽量小的x;

定义:

如果m*n 矩阵A和向量b属于Rn , Ax = b 的最小二乘解时Rn 中的x* , 使得

|b-Ax*| <=|b-Ax| , 对所有x∈Rn 成立。

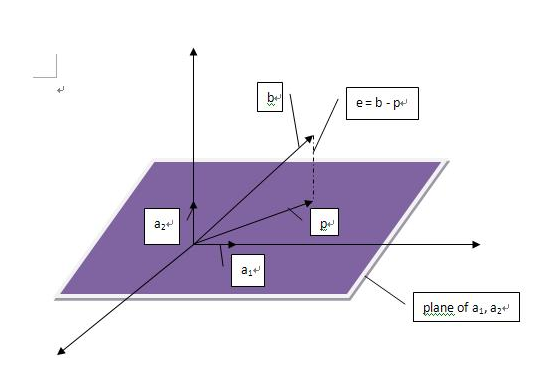

矩阵A乘向量x, 是A种列向量的线性组合,求解Ax = b的过程就是找到一个A中列向量的线性组合使得这个线性组合能得到b, 但是如图所示, b不在A的列向量构成的平面上(下称A平面),也就是Ax = b 无解。该方程组的最小二乘解就是找到一个A的线性组合x*, 使得该线性组合离向量b尽可能近。明显,这个新的线性组合必然在A的列向量构成的平面上。 在该平面上离b最近的点当然是b在该平面上的映射,在图中为p。

图中e 可以表示为 b-p , 由于e是从b向A平面的垂直线, 所以e垂直于A平面中的所有直线 , 也就正交于A矩阵中的所有列向量。

有

AT(b-Ax*) = 0

ATb-ATAX*=0

ATb = ATAX*

X* = (ATA)-1 ATb

4481

4481

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?