前言:正则化其实是基于代价函数来说的一个概念,主要用于处理过拟合等问题。

吴恩达机器学习笔记(七):代价函数

Regularized linear regression

如前言所述,正则化为了让模型更好地切合数据,同时降低过拟合的可能。

具体形式如下,在常规的J(θ)代价函数的后面增加一部分: λ倍∑j到n的θj^2,此举会用来限制参数的大小,,因为在梯度更新时,有一个2λθ的项。而往往我们将 λ设置的较大,所以θ必须足够小才能完成梯度的更新,这样做便能防止过拟合问阿提。

正则化线性回归的Gradient decent

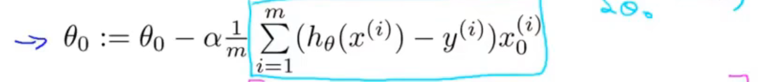

原来的梯度下降:

正则化后:

在后方插入的λ/(2m) * θ^2 求导后变成了下图中的λ/m * θ

前言:正则化其实是基于代价函数来说的一个概念,主要用于处理过拟合等问题。吴恩达机器学习笔记(七):代价函数Regularized linear regression如前言所述,正则化为了让模型更好地切合数据,同时降低过拟合的可能。具体形式如下,在常规的J(θ)代价函数的后面增加一部分: λ倍∑j到n的θj^2,此举会用来限制参数的大小,,因为在梯度更新时,有一个2λθ的项。而往往我们将 λ设置的较大,所以θ必须足够小才能完成梯度的更新,这样做便能防止过拟合问阿提。正则化线性回归的Gradient

前言:正则化其实是基于代价函数来说的一个概念,主要用于处理过拟合等问题。吴恩达机器学习笔记(七):代价函数Regularized linear regression如前言所述,正则化为了让模型更好地切合数据,同时降低过拟合的可能。具体形式如下,在常规的J(θ)代价函数的后面增加一部分: λ倍∑j到n的θj^2,此举会用来限制参数的大小,,因为在梯度更新时,有一个2λθ的项。而往往我们将 λ设置的较大,所以θ必须足够小才能完成梯度的更新,这样做便能防止过拟合问阿提。正则化线性回归的Gradient

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

226

226

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?