主要内容

- 研究背景:语言模型的反思能力对解决复杂问题至关重要,以往研究多关注其在强化学习中的发展,本文聚焦于预训练阶段。

- 方法:提出一种系统方法创建六个跨领域数据集,通过在思维链中引入错误,测试模型识别和纠正错误的能力,以此衡量反思能力。将反思分为情境反思和自我反思,以及显式反思和隐式反思。

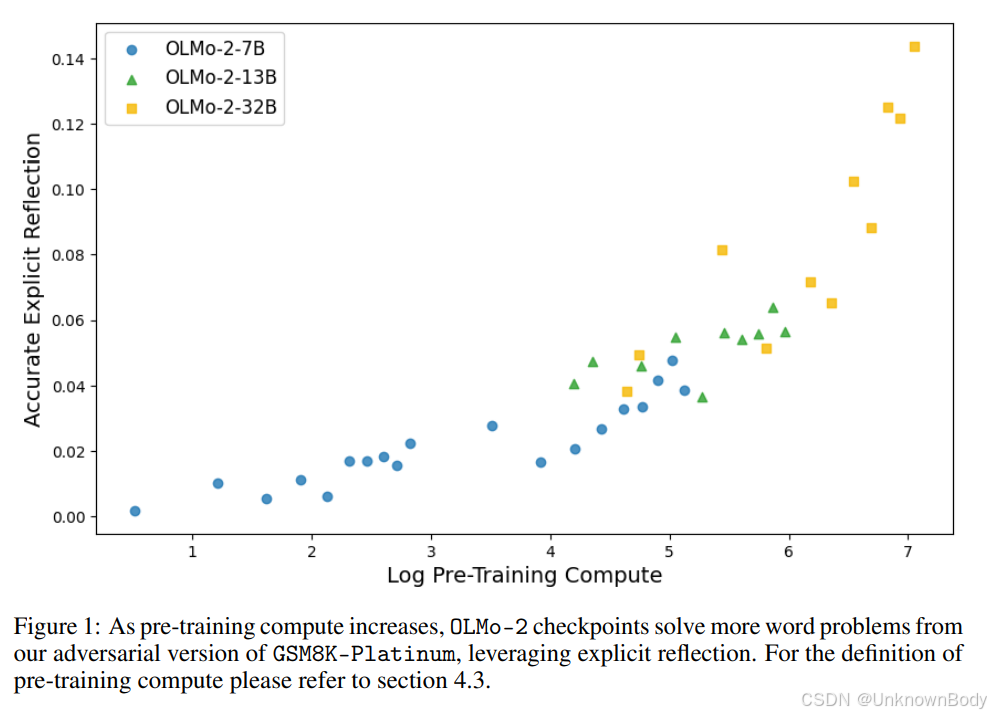

- 实验设置:评估不同计算预算、参数数量和训练token数的部分预训练模型,包括OLMo - 2和Qwen2.5等模型家族,在多种对抗任务上进行测试,并使用自动方法测量模型的反思能力。

- 实验结果:发现模型在预训练阶段就表现出反思能力,且随着预训练计算量增加,反思能力增强,更多地使用显式反思,同时训练时间和测试时间的计算量存在权衡。

- 研究结论:验证了模型在预训练阶段具备反思能力,且能力随预训练增强,为理解语言模型推理能力发展提供新视角。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?