欢迎关注我的CSDN:https://spike.blog.csdn.net/

本文地址:https://spike.blog.csdn.net/article/details/144113087

免责声明:本文来源于个人知识与公开资料,仅用于学术交流,欢迎讨论,不支持转载。

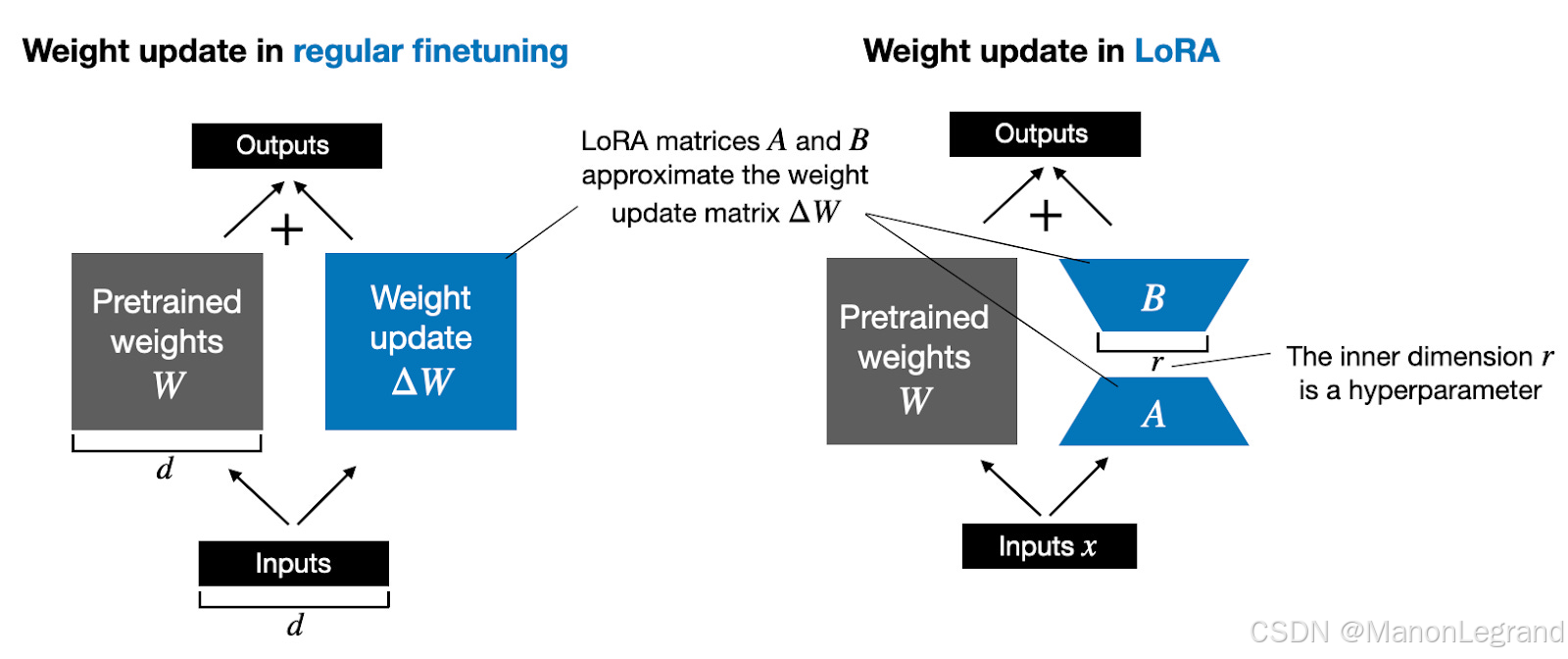

LoRA(Low-Rank Adaptation, 低秩适配),微调预训练大模型的技术,即参数有效微调(Parameter-Efficient Fine-tuning, PEFT),在不改变原始权重的基础上,引入可训练的 低秩分解矩阵 调整模型参数,适应特定任务或领域。冻结预训练模型的参数,在 Transfomer 的每一层中,加入可训练的旁路矩阵(低秩可分离矩阵),将旁路输出与初始路径输出相加

订阅专栏 解锁全文

订阅专栏 解锁全文

3545

3545

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?