近年来,大型语言模型(LLMs)如GPT-4的发展极大地推动了自然语言处理(NLP)领域的进步。这些模型在内容生成、语言翻译和对话系统等多个应用中展示了其强大的能力。然而,传统语言模型的局限性在于它们只能进行语言生成,无法与外部系统、API或自定义函数进行交互。本文将介绍如何通过Function Calling和LangChain技术架构,将LLMs与业务系统连接,探索其在实际业务流程中的应用和价值。

一、大型语言模型的概述

1.1 LLMs的定义与发展

LLMs通过训练海量数据生成高级语言模型,从最初的GPT-3到如今的GPT-4,这些模型在理解和生成自然语言文本方面取得了显著进步,被广泛应用于自动化内容创作、聊天机器人、语言翻译等多个领域。

1.2 传统LLMs的局限性

尽管LLMs在语言生成方面表现出色,但它们的局限性也非常明显。传统的LLMs无法获取实时数据,也不能与外部系统进行交互,这限制了它们在复杂业务场景中的应用。

二、Function Calling与LangChain的概念与机制

2.1 什么是Function Calling?

Function Calling是一种使LLMs能够与外部系统、API或自定义函数进行交互的新兴技术。通过解析用户请求并自动选择和调用适当的外部功能,Function Calling实现了更复杂和动态的交互。

2.2 什么是LangChain?

LangChain是一种用于构建和管理复杂语言模型应用的框架。它提供了模块化和可扩展的架构,使开发者能够轻松集成多种功能和服务,从而增强LLMs的能力。

2.3 Function Calling与LangChain的结合

将Function Calling与LangChain结合,可以实现LLMs与业务系统的无缝对接。Function Calling负责解析和执行请求,LangChain提供框架和工具,以便管理这些交互过程。

三、Function Calling+LangChain的技术架构

3.1 技术架构概览

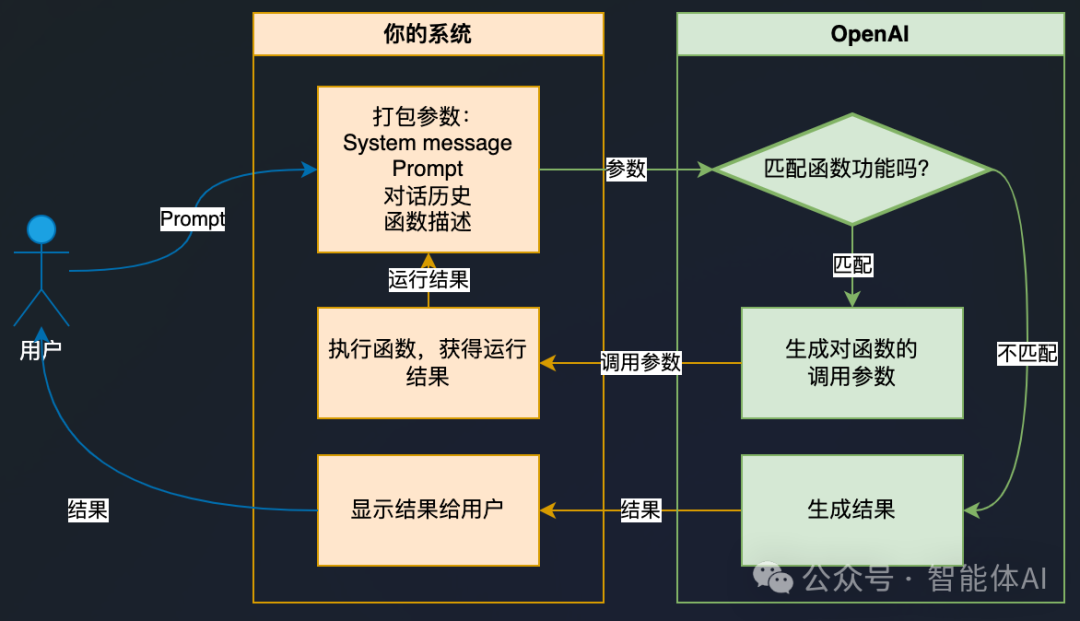

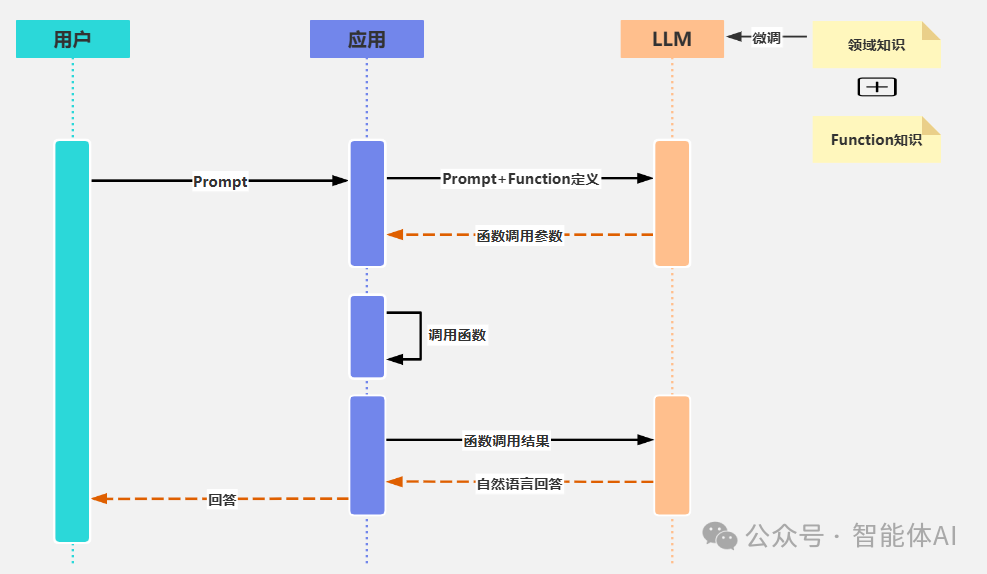

技术架构包括以下几个核心组件:

-

用户接口层:通过自然语言输入需求(prompt),用户与业务系统(应用)交互。

-

解析与路由层:利用Function Calling解析用户请求,并确定所需的外部功能。

-

功能调用层:通过LangChain框架管理和执行具体的功能调用。

-

数据处理层:处理和分析从外部系统获取的数据。

-

结果反馈层:将处理后的结果反馈给用户。

3.2 解析与路由

用户通过自然语言输入需求,Function Calling模块解析请求内容和意图,并确定所需的外部功能或API。LangChain框架则负责管理这些解析过程,确保请求被正确路由到相应的功能模块。

3.3 功能调用与数据处理

在功能调用层,LangChain通过预先设定的接口,选择并调用相关外部功能。外部系统返回数据后,数据处理层进行处理和分析,将结果转换为自然语言反馈给用户。例如,模型可以将复杂的金融数据分析结果生成简明的投资建议报告。

3.4 结果展示与交互

结果反馈层通过用户友好的界面展示处理结果,用户可以进一步与模型进行交互,提出新的请求或调整需求,从而实现连续、动态的交互流程。

3.5代码示例

`import openai``import os``import tiktoken``# 加载 .env 文件``from dotenv import load_dotenv, find_dotenv``from langchain.prompts import PromptTemplate``from langchain.llms import OpenAI``from langchain.chains import LLMChain``from langchain.chains import LLMRequestsChain``#from langchain.chat_models import AzureChatOpenAI``from langchain.chat_models import ChatOpenAI #直接访问OpenAI的GPT服务`` ``_ = load_dotenv(find_dotenv())``# 从环境变量中获得你的 OpenAI Key和配置URL``openai.api_key = os.getenv('OPENAI_API_KEY')``openai.api_base = os.getenv('OPENAI_API_URL')``model = os.getenv('OPENAI_API_MODEL')`` `` `` ``llm = ChatOpenAI(model_name=model, temperature=0) #直接访问OpenAI的GPT服务``#llm = AzureChatOpenAI( model_name=model, temperature=0, max_tokens=200) # 通过Azure的OpenAI服务``#根据查询的结果结果返回给大模型,大模型再组装后进行返回``def query_baidu(question):` `template = """Between >>> and <<< are the raw search result text from web.` `Extract the answer to the question '{query}' or say "not found" if the information is not contained.` `Use the format` `Extracted:<answer or "not found">` `>>> {requests_result} <<<` `Extracted:"""`` ` `PROMPT = PromptTemplate(` `input_variables=["query", "requests_result"],` `template=template,` `)`` ` `inputs = {` `"query": question,` `"url": "http://www.baidu.com/s?wd=" + question.replace(" ", "+")` `}` `requests_chain = LLMRequestsChain(llm_chain = LLMChain(llm=llm, prompt=PROMPT), output_key="query_info", verbose=True)` `res = requests_chain.run(inputs)` `return res`` ``#python 程序入口``if __name__ == "__main__":` `print(query_baidu("今天长沙的天气?"))`

四、Function Calling+LangChain的应用场景

4.1 实时数据获取与处理

在金融市场分析中,Function Calling+LangChain架构可以帮助模型实时获取市场数据,进行分析并提供最新的投资建议。在新闻与信息监控中,模型可以实时跟踪热点事件,提供及时的信息更新。

4.2 业务流程自动化

在客户服务和支持方面,通过与客户关系管理系统的交互,模型可以自动处理客户查询,提高客户满意度。此外,作为自动化办公助手,模型可以处理日常的办公任务,如安排会议、发送邮件等,提高工作效率。

4.3 复杂决策支持

在智能推荐系统中,Function Calling+LangChain架构可以根据用户的实时数据和偏好,提供个性化的推荐。在供应链管理中,模型可以与供应链系统进行交互,优化库存管理和物流安排,提升整体运营效率。

五、Function Calling+LangChain的优势与挑战

5.1 优势分析

Function Calling与LangChain的结合,使得LLMs不仅限于语言生成,而是能够参与到实际的业务流程中。通过实时获取和处理数据,模型的实用性和应用范围得到了极大的提升,增强了与用户的交互能力。

5.2 面临的挑战

尽管Function Calling与LangChain架构带来了诸多优势,但也面临一些挑战。首先是安全与隐私问题,如何确保数据的安全传输和存储是一个重要课题。其次,技术实现的难度较高,需要投入大量的资源和精力。此外,该架构的实现也涉及到较高的成本,需要企业在预算和资源分配上做出合理的规划。

六、未来展望

6.1 技术趋势预测

随着技术的不断发展,Function Calling与LangChain的结合将变得更加智能和高效。未来,我们可以预见到更多跨领域的应用,模型将能够在更多复杂的场景中提供解决方案。

6.2 对企业与个人的影响

Function Calling与LangChain架构将推动企业的数字化转型,提升企业的运营效率和竞争力。同时,个人用户也将从中受益,获得更高效的生产力工具,改善工作和生活方式。

总结

Function Calling与LangChain架构为LLMs的发展带来了新的契机,使其能够超越纯粹的语言生成能力,参与到实际的业务流程和复杂决策中。通过这一技术架构,LLMs的应用范围得到了极大的扩展,为企业和个人带来了更多的价值。未来,我们期待看到更多企业和开发者利用这一技术,实现业务的创新和发展。

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

本文转自 https://blog.csdn.net/m0_59164304/article/details/140534104?spm=1001.2014.3001.5501,如有侵权,请联系删除。

2700

2700

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?