GPT(autoregressive)模型是一个自回归模型,利用left-to-right语言模型,由于不是双向attention 机制,因此不能再NLU任务中,获取充分的上下文信息,BERT类似自编码(autoencoding),通过MLm任务学习,但是不能直接应用到text generation;encoder-deconder模型采用再encoder部分双向attention,在decoder部分单向attention,在摘要提取回应生成 DeBERTa

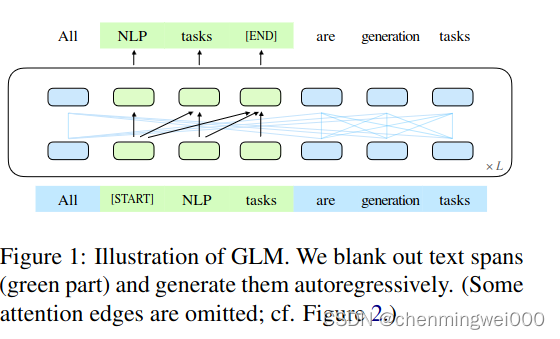

本模型提出的是自回归空白填充(autoregressive),从题目上看,没什么创新,具体的,随机掩盖连续得tokens与自编码思想相同,顺序得重构对应得掩盖连续spans,遵循自回归预训练,如果单独,从这几句话来讲,说实话和 DeBERTa完全一样,唯一不同的是Deberat是在encoder-decoder decoder部分生成目 标,但是GLM是在原始位置处生成,如图1

标,但是GLM是在原始位置处生成,如图1

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?