如何安装spark?

spark比Hadoop良心,既提供了Windows的运行方式,又提供了Linux的运行方式,不过推荐在Linux环境下使用。

spark依赖 Java运行环境(最低1.7版本),请自行搭建。需要使用Linux环境的同学,自行准备Linux环境。笔者使用的是Linux 环境。可以是虚拟机,也可以是真实的环境

虚拟机Linux 安装 http://jingyan.baidu.com/article/a948d651484fba0a2dcd2e15.html

Linux Jdk安装 http://www.cnblogs.com/shihaiming/p/5809553.html

正式步骤

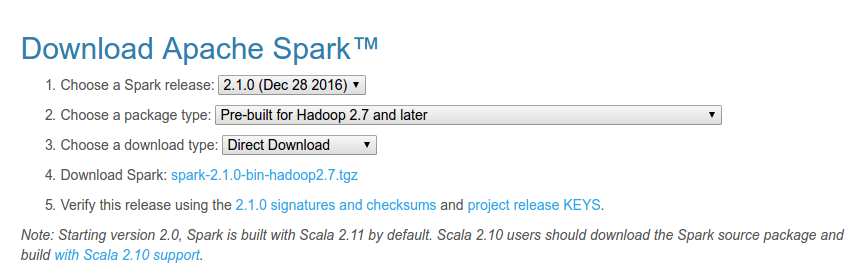

首先需要下载spark。在官网可以下载,下载地址:

http://spark.apache.org/downloads.html

注意选择自己需要的版本,这儿我们使用目前最新的,下载的时候可以选择一个比较快的镜像。

Linux 命令环境也可以用 wget 命令下载。

笔者下载的是这个版本 spark-2.1.0-bin-hadoop2.7.tgz

1. 下载完成后移动到 /usr/local/spark 目录里面。

mv spark-2.1.0-bin-hadoop2.7.tgz /usr/local/spark 如果没有这个目录,你可能需要先新建这个目录。

2. 解压文件

tar -zxvf /usr/local/spark/spark-2.1.0-bin-hadoop2.7.tgz

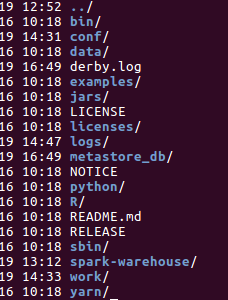

解压完成后有如下目录

一看这些目录,还是比较熟悉的,和Hadoop的目录有些类似

不过唯一不同的是 spark有1个bin目录 和一个 sbin目录,其中bin目录放置着 和任务运行相关的一些执行脚本。 sbin目录放置的才是和集群启动和关闭的执行脚本。

着两个目录都需要有运行的权限 为了避免麻烦 给个775的权限

chmod -R 775 bin/

chmod -R 775 sbin/

然后在spark主目录执行一下

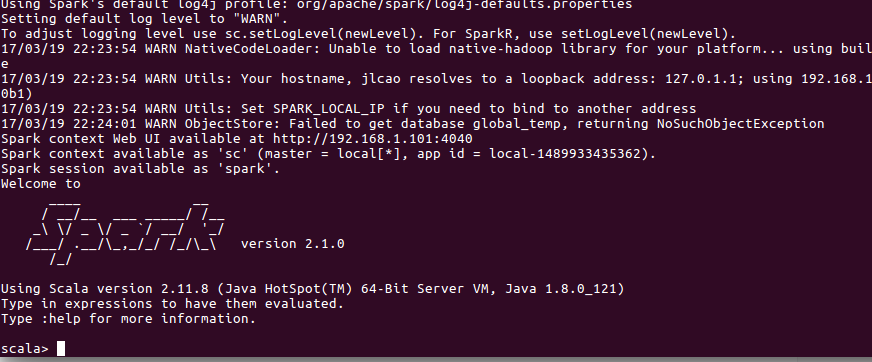

./bin/spark-shell 启动spark的shell测试界面

当出现以下界面时代表安装成功

spark-shell 将会在下一章介绍。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?