http://blog.csdn.net/pipisorry/article/details/52791036

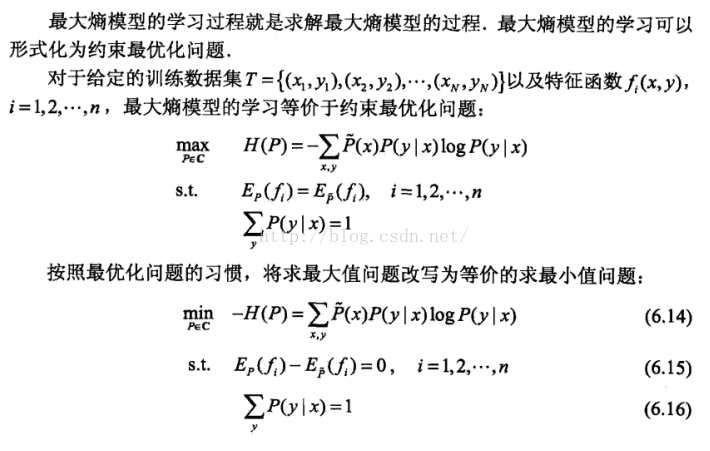

最大熵模型的训练和学习

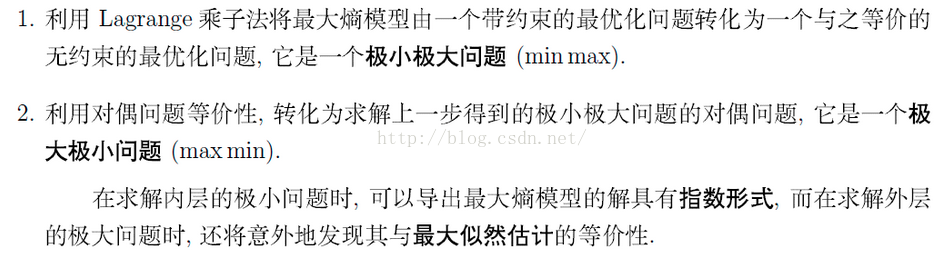

最大熵模型求解的思路和步骤

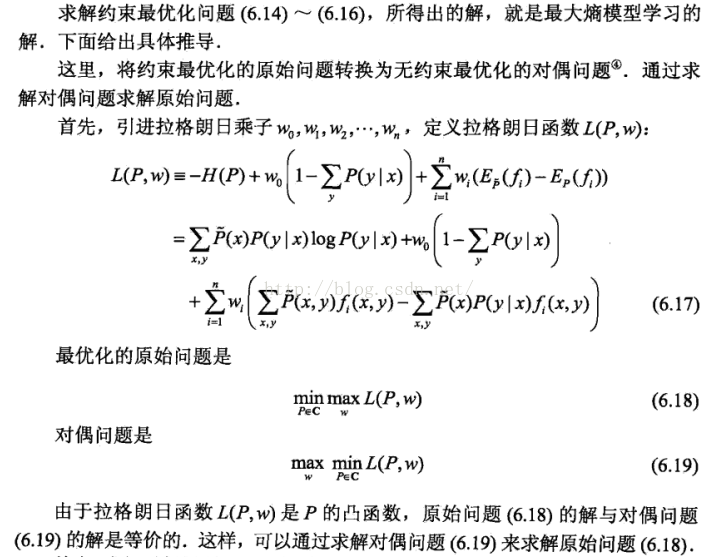

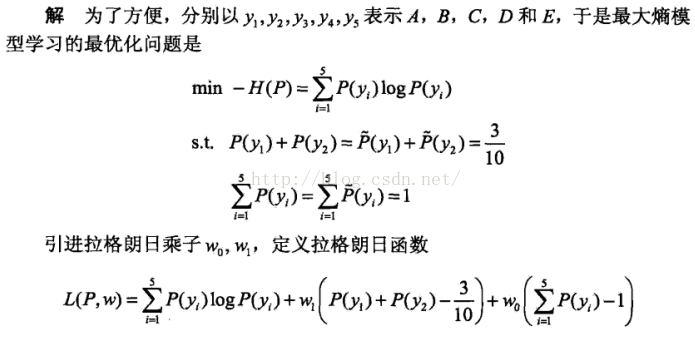

最大熵模型学习的具体推导

Note: 通过交换极大极小位置,即得其对偶问题。

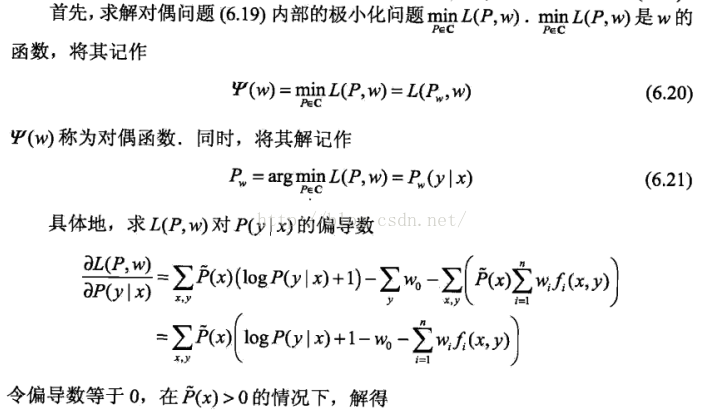

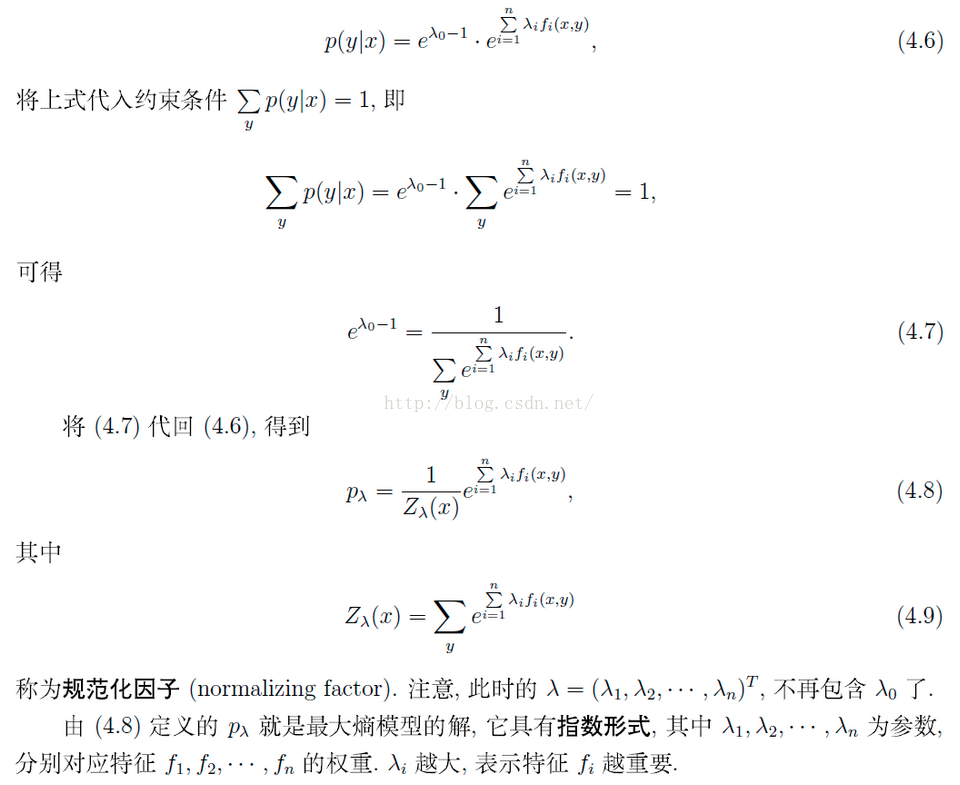

求解内部极小化问题:lagrange乘子法

右边更详细的解释

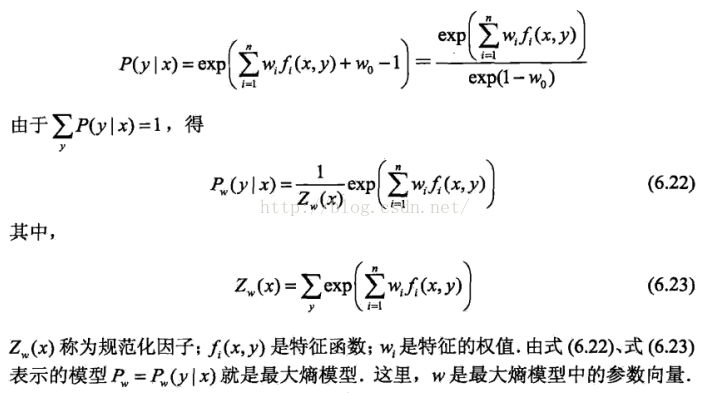

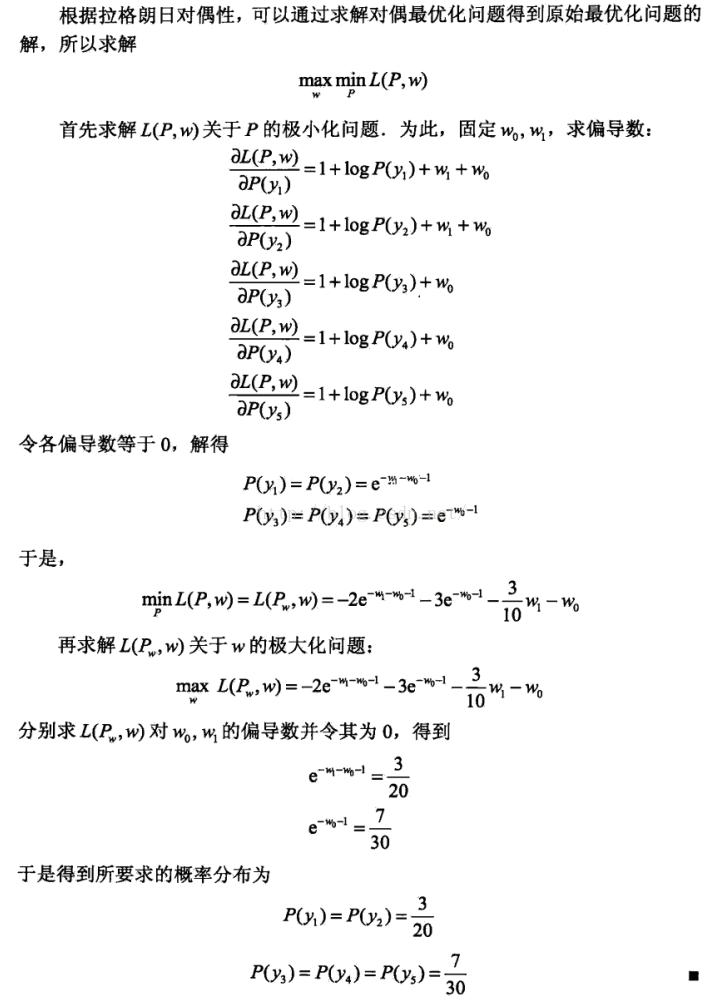

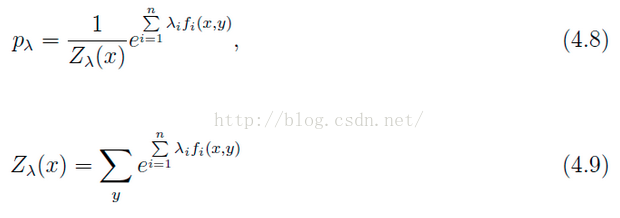

从式6.22中可以看出,通过式6.22可以进行最大熵分类(x为文本d, y为类别c),只需要求解出wi参数(如下)和定义好所有n个特征f。

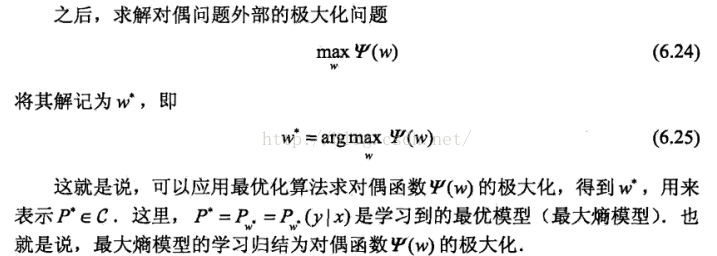

求解外层极大值问题:最大似然估计

{这里要求解对偶问题外部的极大化,求解出w代入6.22式中作为特征的权重,不过这里只是给出了对偶问题外部极大化问题关于w的表示,在下节将给出w的具体求解方法。}

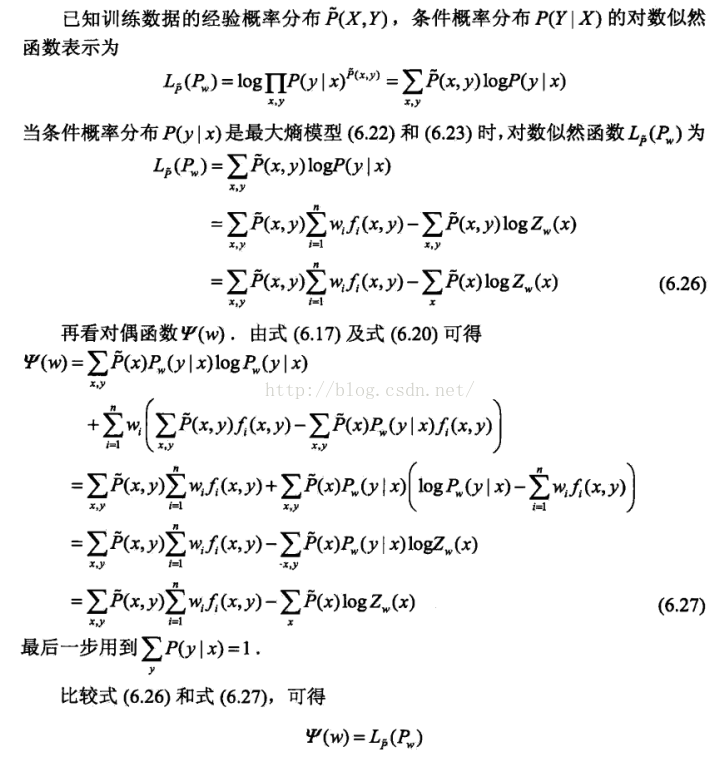

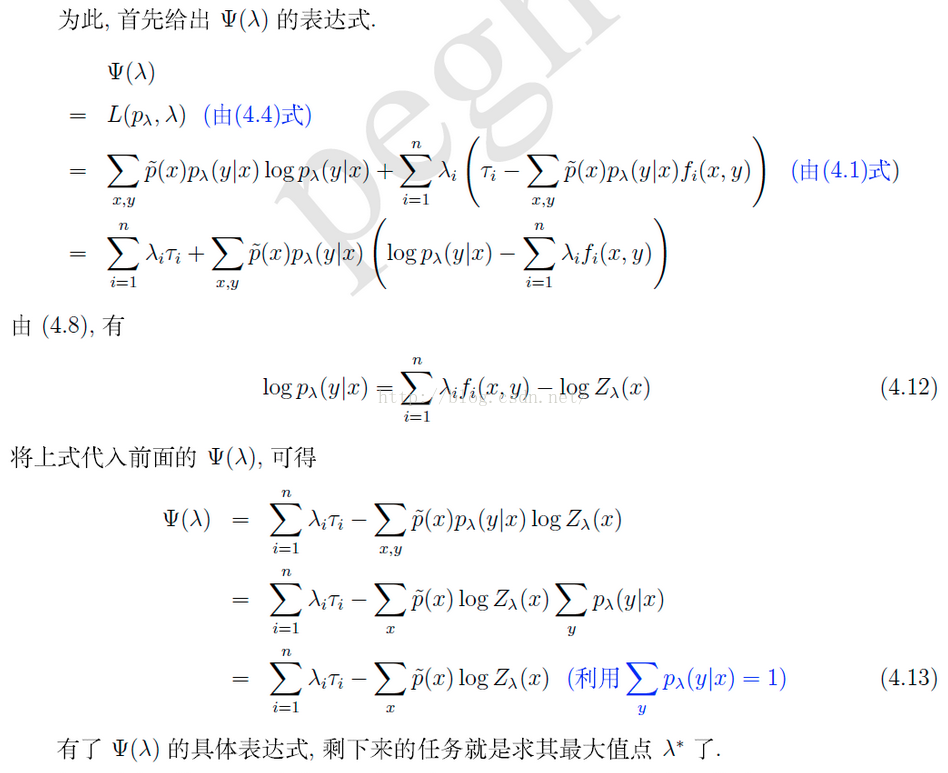

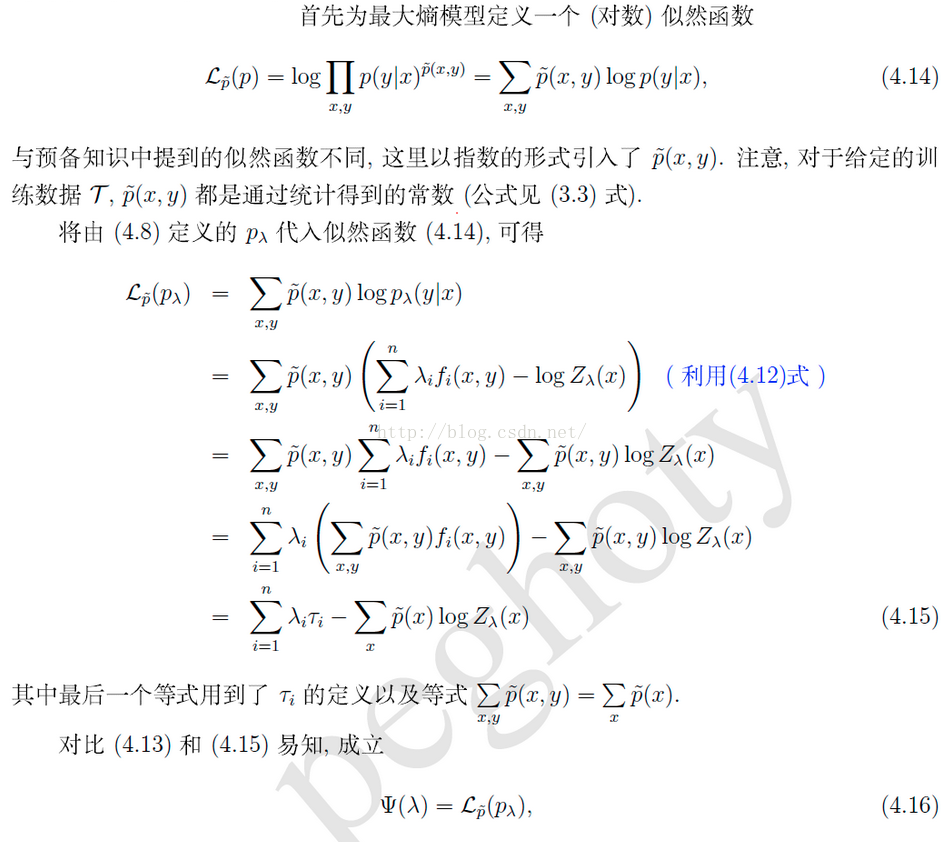

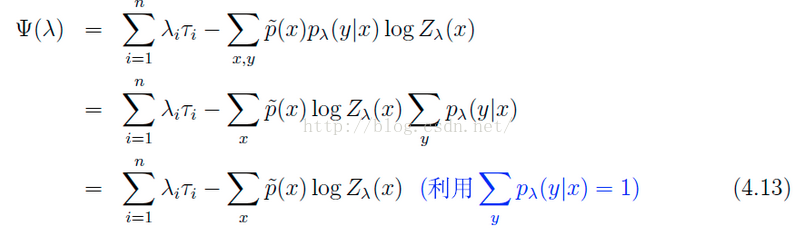

对偶函数的极大化和最大熵模型的极大似然估计的等价性

{这里要说明的问题是,如果我们定义一个特定的函数,求解这个似然函数的极大值和求解对偶函数的极大化问题的公式是一样的。也就是

![]() }

}

至此,我们得到了这个对偶问题外部极大问题关于w的表达式了。

最大熵模型学习的示例

最大熵模型的学习方法

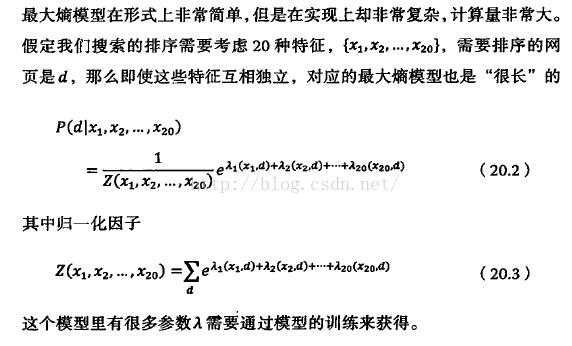

上面一节中,我们已经得到了对偶问题外部极大值问题关于w的表达式了,要求解这个表达式需要使用数值方法求解其极大值。

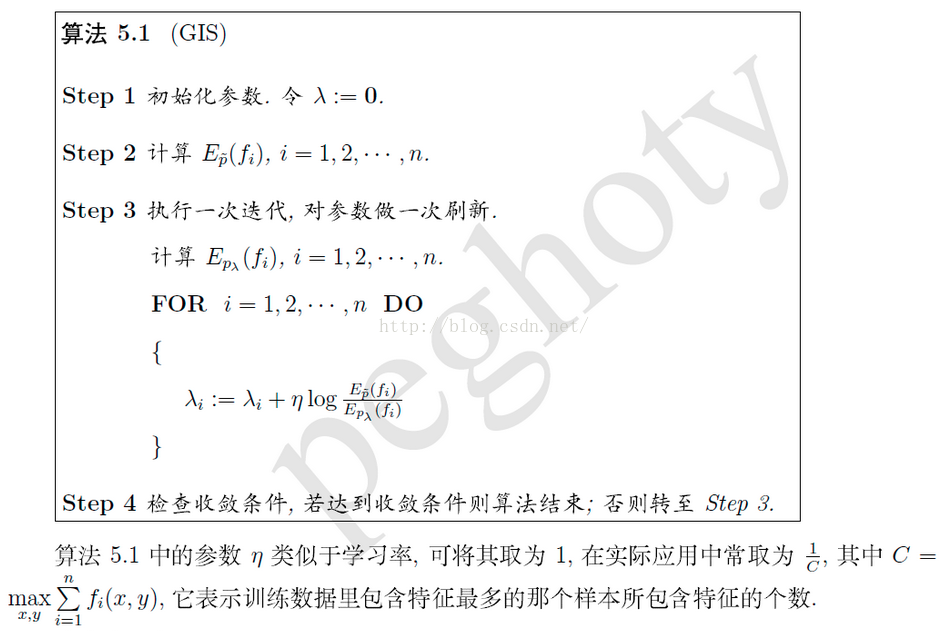

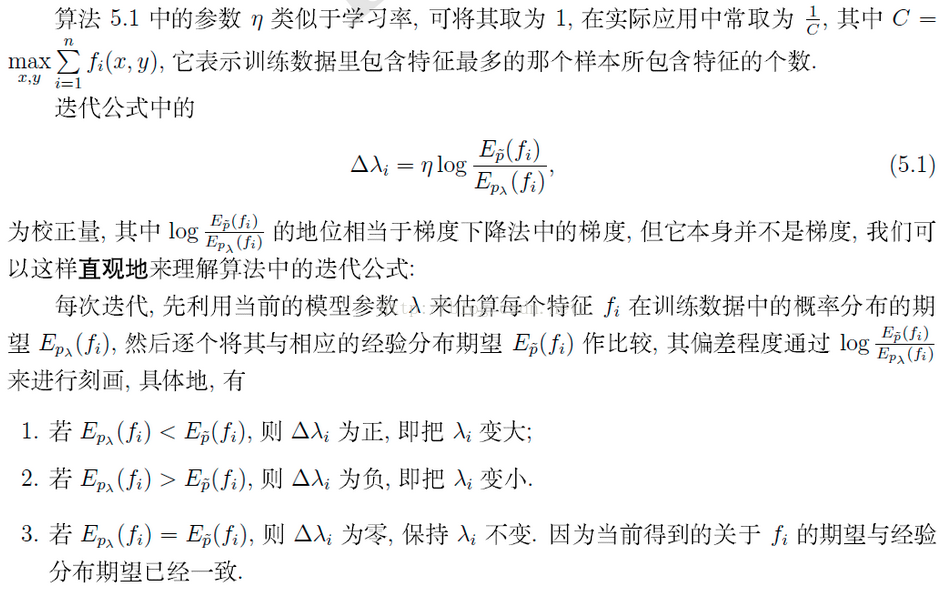

GIS通用迭代尺度法

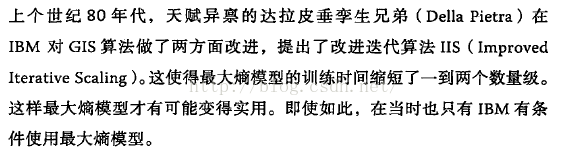

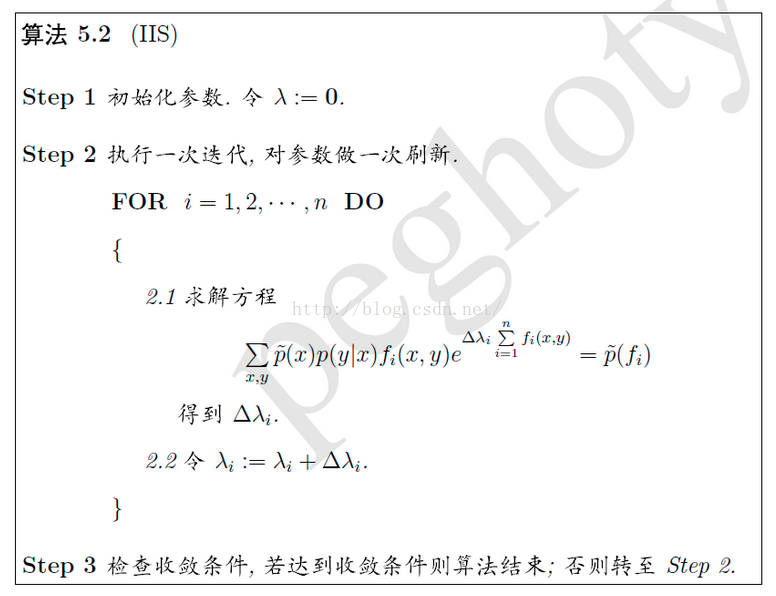

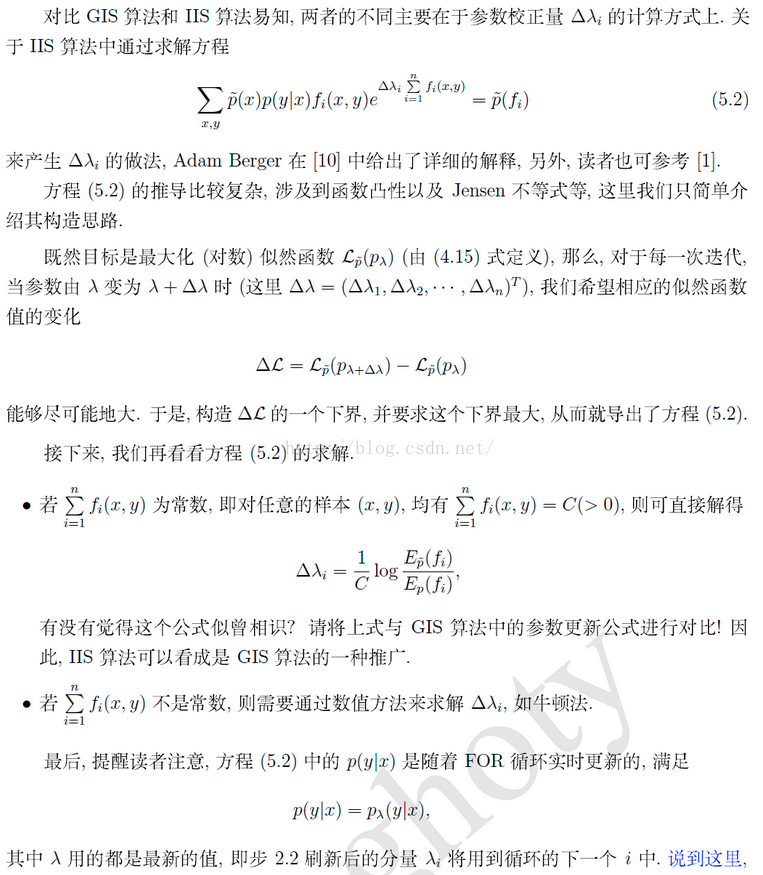

IIS改进的迭代尺度法

[10 Adam Berger. The Improved Iterative Scaling Algorithm: A Gentle Introduction. 1997.]

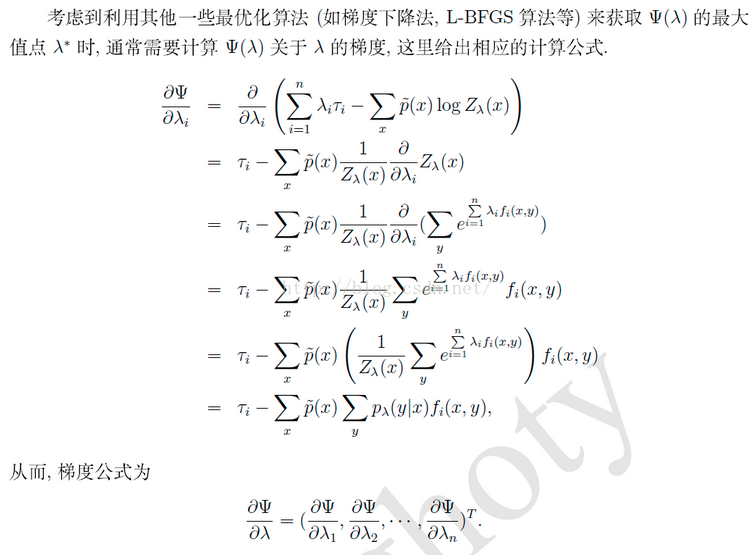

梯度下降法

from: http://blog.csdn.net/pipisorry/article/details/52791036

ref: [李航 统计学习方法]

[数学之美 吴军]

[52nlp MIT自然语言处理第五讲:最大熵和对数线性模型(第一部分)]

[北大常宝宝 《自然语言处理的最大熵模型》]

2714

2714

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?