1. 为什么要知道每个样本其所属类别的概率?

虽然决策树可以做到对样本分类,但在算法使用中也会遇到这种情况,模型对样本X进行预测,样本X属于A的概率为51% 属于B的概率为49%,这时虽然算法给出结论是样本X属于A类。但是其对这次预测的结果把握性并不是很大。对于现实中某些宁可不做也不要出现错误的场景来说,这次预测并不是我们所需要的。所以,做算法的时候我们需要模型输出样本属于每个类别的概率。

2. 决策树如何计算每个样本的概率?

2.1 决策树结果可视化

为了方便理解,这里面先讲决策树的可视化,可视化出来后,应该十分容易理解,决策树是如何给出每个样本概率的!

这里以决策树模型,对鸢尾花数据分类为例,代码如下:

from sklearn.datasets import load_iris

from sklearn.tree import DecisionTreeClassifier

import numpy as np

from sklearn import tree

from sklearn.ensemble import RandomForestClassifier

import graphviz

if __name__ == '__main__':

x = load_iris().data

y = load_iris().target

feature_names = load_iris().feature_names

np.random.seed(12) # 打乱顺序,使用相同的seed,保证输入特征和标签一一对应

np.random.shuffle(x)

np.random.seed(12)

np.random.shuffle(y)

x_train = x[:10, :] # 因为这里面主要为了看效果,所以这里只用了10个样本

y_train = y[:10]

model = DecisionTreeClassifier(min_samples_leaf=3).fit(x_train, y_train)

probility = model.predict_proba(x[146, :].reshape(1, -1)) # 观察第146个样本,属于每个样本的概率

print(feature_names)

print(x[146, :]) # 观察需要预测样本的特征值

print(probility)

dot_data = tree.export_graphviz(model,

feature_names=feature_names,

filled=True,

rounded=True)

graph = graphviz.Source(dot_data)

graph.view()

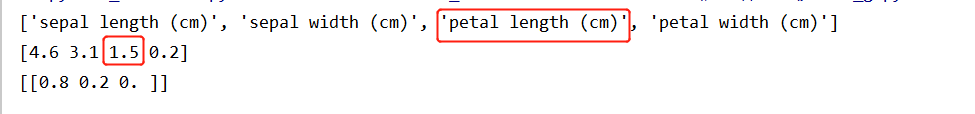

输出的结果为: 第146样本的概率【0.8 0.2 0. 】,记属于第一类概率为0.8,第二类概率为0.2 ,第三类概率为0。

为什么会这样呢?

2.2 解释决策树输出概率如果计算出来的?

这个图是用10个样本得到决策树模型,可以看到模型中只用了petal length(cm)这个特征,如果这个特征小于4.55,那么样本【4,1,0】,4/(4+1)=0.8 证明属于第一类可能性为0.8。

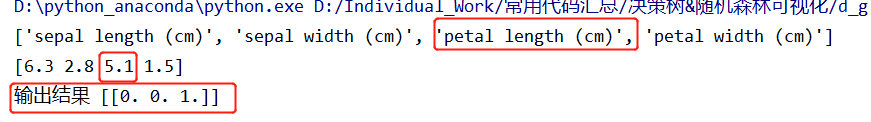

现在我们看一下预测的样本petal length(cm)这个特征是不是小于4.55,如果小于,那么可以得到第一类概率为0.8,第二类概率为0.2 ,第三类概率为0。如果不小于他理论上输出的结果应该是:第一类概率为0,第二类概率为0 ,第三类概率为1.下图为预测样本的特征值

可以看到值为1.5小于4.55,可以解释模型的输出结果为什么为【0.8 0.2 0. 】。

为了增加理解再换一个样本,

因为其大于4.55,所以输出概率为【0,0,1】,相信写到这里大家都可以明白了。

总结,从上面的也可以看出,如果树的深度很深,或者叶子节点min_sample=1(min_spilt=2),都可以使得样本属于某一类的结果的概率增加,接近100%,但是这时候往往也会出现过拟合的情况。

1427

1427

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?