简介

正则化(Regularization)使神经网络应用广泛。对前馈神经网络,dropout是最有效的正则化方法。但是dropout不适用于RNN,因为递归(recurrence)会放大噪音,持续影响网络学习。RNN通常使用small model,large RNN趋于overfit。

这篇文章主要贡献是使用dropout在non-recurrent connections。如下图所示。在虚线箭头处应用dropout,在实线箭头处不应用。

1、LSTM units 长短记忆单元

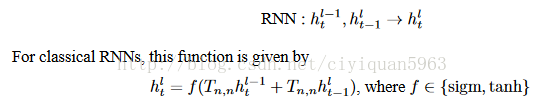

首先RNN可以用表示为:

LSTM具体可以看这篇文章【Graves.Generating sequences with recurrent neural networks(2013)】

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4315

4315

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?