公式来源于:http://blog.csdn.net/lilyth_lilyth/article/details/8973972

参考知乎:https://zhuanlan.zhihu.com/p/25765735

梯度下降法常用于最小化风险函数或者损失函数,分为随机梯度下降(Stochastic Gradient Descent)和 批量梯度下降(Batch Gradient Descent )。除此之外,还有梯度上升法(Gradient Ascent),应用于极大似然估计,与下降法区别就是朝着梯度上升还是下降的方向迭代。

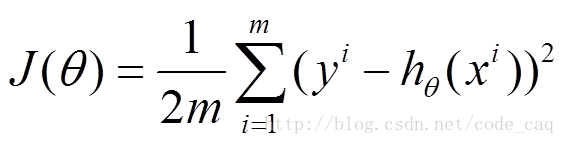

设hθ(x)是预测值,其中θ是模型的参数,J(θ)是损失函数,对于最小化损失函数问题,采用梯度下降法来求解。

1、批量梯度下降法:

假设J(θ)是平方损失函数,其中m是样本个数,i表示第i个样本,yi是真实值

J(θ)对每一个θj求偏导,j指的是第j个参数

本文介绍了批量梯度下降和随机梯度下降两种优化算法,包括它们的更新规则、优缺点和收敛特性。批量梯度下降利用所有样本更新参数,寻找全局最优解,但计算速度慢;随机梯度下降则以单个样本更新参数,虽可能受噪声影响,但计算速度快,整体趋向全局最优解。此外,还提到了小批量梯度下降作为两者折衷的选择。

本文介绍了批量梯度下降和随机梯度下降两种优化算法,包括它们的更新规则、优缺点和收敛特性。批量梯度下降利用所有样本更新参数,寻找全局最优解,但计算速度慢;随机梯度下降则以单个样本更新参数,虽可能受噪声影响,但计算速度快,整体趋向全局最优解。此外,还提到了小批量梯度下降作为两者折衷的选择。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1627

1627

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?