做深度学习的同学对卷积肯定都不陌生了。

我曾在很多文章中解释过这个算法,卷积算法之所以如此重要,是因为我们可以把它看作是一个特征提取器。

如何理解这个特征提取器呢?

我们先看下卷积的核心运算。

可以回想一下在介绍卷积的时候,描述的卷积运算的场景是:一个窗口在图片上滑动,窗口中的数值是卷积核的参数,也就是权值。

和矩阵乘法一样,卷积在每一次扫描的过程中,完成的是权值数据和输入图像的乘累加运算。

这个过程是乘累加运算(点击链接学到更多),乘累加便可以理解为特征提取和融合。

如此一来,卷积的多层循环以及多个卷积核,便可以认为是一种特征提取器。

在很多神经网络,都可以看到以卷积为主的骨干网络(BackBone Network)。

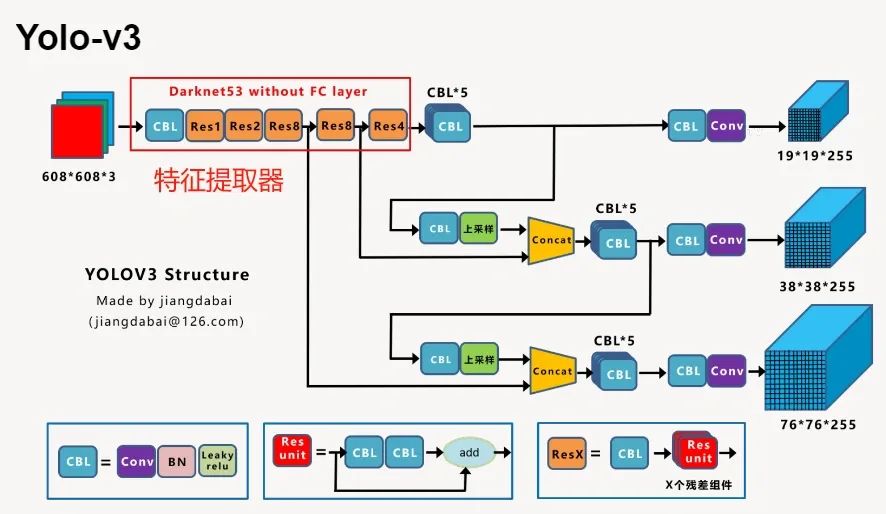

比如大名鼎鼎的 Yolo 系列,会将以卷积为主的 resnet 网络当做自己的骨干网络,其目的就是为了使用 resnet 进行图片的特征提取。

然后完成后面的图像检测功能。

图源公众号:江大白

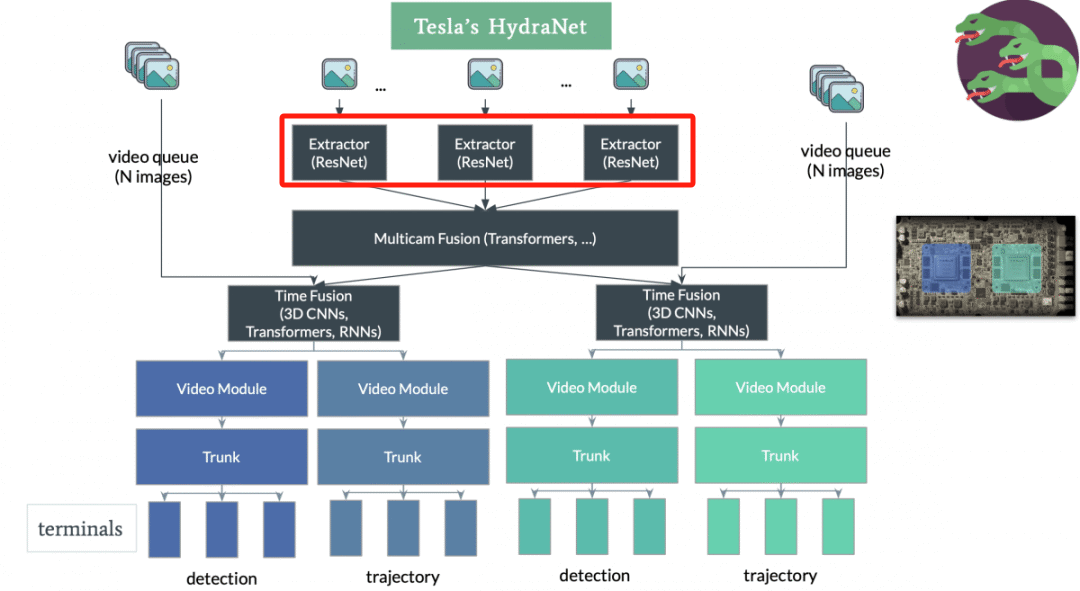

再比如,之前介绍小米汽车的占用网络时,可以看到在特斯拉的占用网络中,也存在 resnet 作为特征提取器的身影。

上图是特斯拉占用网络架构图,红框为resnet为主的特征提取器。

这是因为 resnet 中有大量的设计好的卷积层,因此,大部分将 resnet 作为骨干网络的神经网络,都是把 resnet 这一部分结构当做一个图像的特征提取器来使用。

而网络中的其他结构,是在对 resnet 提取出来的特征进行更进一步的操作。

看到这,是不是就对卷积这一算法有了一个新的认识了呢?

https://blog.csdn.net/dongtuoc/article/details/138633936?spm=1001.2014.3001.5501

https://blog.csdn.net/dongtuoc/article/details/138633936?spm=1001.2014.3001.5501

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?