首先向大家推荐一本好书:Matthew Scarpino的 OpenCl IN ACTION。

大约在去年这个时候,浪潮集团来我校讲解并行计算,超级计算等等的概念。当时正巧在学习linux,所以对并行计算的概念理解为“linux下的C并行计算”,当然,并行计算是什么当时是不知道的。(虽然现在读了两三本书,但也不敢说对这个多么了解)

当时的学习后了解到的是,借用学校(或是浪潮集团)的一个api接口,在程序之前加上几句模板式的语句便可以来大大提高计算速度。虽然很想利用一下学校给提供的良好条件,但是一直没有真正找到办法来接触了解,原因之一便是网络的不便(不得不提,现在学校360°wifi覆盖!!!赞!!)

于是便想到了OpenCl。正巧图书馆里面有这样一本不错的书,便拿了仔细学学吧。

本人用的显卡是nvidia公司GTX765M的,win10系统。从nvidia官网下载了大约两个半天(这个下载实在太慢了,有需要又嫌时间长不想自己下载的可以留邮箱^_^)

于是开始了坎坷的安装过程。

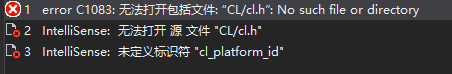

第一次把安装目录放到了D,也就是平时放一些软件的盘。出现sample文件夹下为空;新建项目的时候对于opencl自带的头文件,比如CL/cl.h。一直显示 : error C1083:无法打开包括文件:”CL/cl.h”:No such file or directory

我了解这是由于疏忽未加头文件的地址。

具体为:在项目->属性->C/C++附加包含目录 和 链接器->附加库目录 这两个地方把头文件所在的文件夹位置配置好。

如我的include文件夹位置是:D:\cuda_sdk\toolkit\include

就写到这里就好了。

几次波折,这个地方都没有写正确,但是我不了解是这里出的问题,就不断的重装,全部卸载后安装到C盘,还是不行。现在想想也是蛮有意思的。

后来找到问题的原因就是上面的那个头文件位置,而且本人亲身经历证明安装到非C盘是毫无问题的(我全部都是选择安装到了D,就是说只要有的选就不在C)。

下一步在有时间继续研究OpenCl的同时找机会研究一下环境变量跟VS这个IDE的各种奇怪组织形式。

9188

9188

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?