在3.3.3节,我们看到,对于新的输⼊

x

x

x,线性回归模型的预测的形式为训练数据集的⽬标值的线性组合,组合系数由“等价核”(3.62)给出,其中等价核满⾜加和限制(3.64)。

我们可以从核密度估计开始,以⼀个不同的角度研究核回归模型(3.61)。假设我们有⼀个训练集

{

x

n

,

t

n

}

\{\textbf{x}_n, t_n\}

{xn,tn},我们使⽤Parzen密度估计来对联合分布

p

(

x

,

t

)

p(x,t)

p(x,t)进⾏建模,即

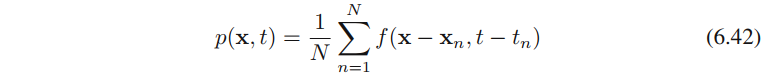

其中

f

(

x

,

t

)

f(\textbf{x},t)

f(x,t)是分量密度函数,每个数据点都有⼀个以数据点为中⼼的这种分量。我们现在要找到回归函数

y

(

x

)

y(\textbf{x})

y(x)的表达式

简单起见,我们现在假设分量的密度函数的均值为零(对所有

x

\textbf{x}

x都成立),即

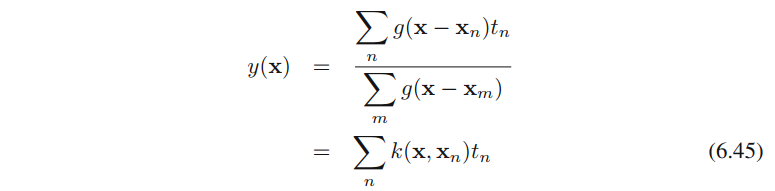

使⽤⼀个简单的变量替换,我们有(公式6.45的推导见附录“公式推导”)

其中

n

,

m

=

1

,

.

.

.

,

N

n,m = 1,...,N

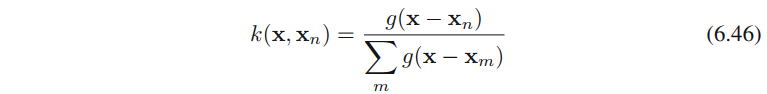

n,m=1,...,N,且核函数

k

(

x

,

x

n

)

k(\textbf{x}, \textbf{x}_n)

k(x,xn)为

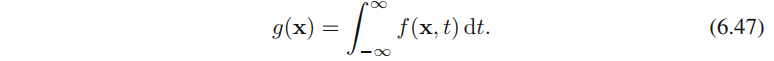

其中

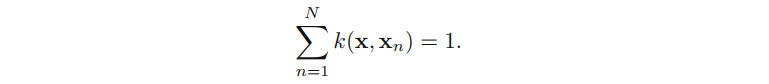

公式(6.45)给出的结果被称为Nadaraya-Watson模型,或者称为核回归。对于⼀个局部核函数,它的性质为:给距离

x

\textbf{x}

x较近的数据点

x

n

\textbf{x}_n

xn较⾼的权重(如何看出这一点的)。注意,核(6.46)满⾜加和限制

附录

公式推导

- 公式6.43如何推导到公式6.45

先看公式6.43的分母,由公式6.47,很容易得

∑ m ∫ f ( x − x n , t − t n ) d t = ∑ m g ( x − x n ) \sum_{m}{\int{f(\textbf{x}-\textbf{x}_n,t-t_{n})dt}}=\sum_{m}g(\textbf{x}-\textbf{x}_n) m∑∫f(x−xn,t−tn)dt=m∑g(x−xn)再看分子

∑ n ∫ t f ( x − x n , t − t n ) d t \sum_{n}{\int{tf(\textbf{x}-\textbf{x}_n,t-t_{n})dt}} n∑∫tf(x−xn,t−tn)dt做变量替换 l = t − t n l=t-t_{n} l=t−tn,得 t = l + t n t=l+t_{n} t=l+tn, d t = d l dt=dl dt=dl,于是

∑ n ∫ t f ( x − x n , t − t n ) d t = ∑ n ∫ ( l + t n ) f ( x − x n , l ) d l = ∑ n ∫ l f ( x − x n , l ) d l + ∑ n ∫ t n f ( x − x n , l ) d l = ∑ n g ( x − x n ) t n \sum_{n}{\int{tf(\textbf{x}-\textbf{x}_n,t-t_{n})dt}}=\sum_{n}{\int{(l+t_{n})f(\textbf{x}-\textbf{x}_n,l)dl}} \\ =\sum_{n}{\int{lf(\textbf{x}-\textbf{x}_n,l)dl}}+\sum_{n}{\int{t_{n}f(\textbf{x}-\textbf{x}_n,l)dl}} \\=\sum_{n}g(\textbf{x}-\textbf{x}_n)t_n n∑∫tf(x−xn,t−tn)dt=n∑∫(l+tn)f(x−xn,l)dl=n∑∫lf(x−xn,l)dl+n∑∫tnf(x−xn,l)dl=n∑g(x−xn)tn

延展讨论

- 核函数的加和限制(文末)必须满足么,还是仅仅在核回归中必须满足?

应该不是必须满足(例如公式6.9),但是核回归应该是要满足的。 - 如何选择核函数,如何求解核函数

930

930

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?