写在前面: 跟朋友讨论的时候,发现妆容迁移也有挺大的市场,看到一篇关于这个的介绍文,学习一下~

论文地址: https://arxiv.org/pdf/1909.06956.pdf

这篇论文是CVPR2020 oral. 没有开源训练代码~

古老的美容行业(The age-old beauty industry)正在经历一场变革, 成千上万的博主在互联网上分享美容、化妆技巧、技术和化妆偏好。 但是,当问题来到: "我应该涂哪种唇膏或者为啥我画出来的妆跟demo video里的差这么大?"的时候,

人工智能可能更有能力提供答案(AI may be better equipped to provide the answer)。

最近,来自多个研究机构提出的PSGAN被放出来: Pose-Robust Spatial-Aware GAN for Customizable Makeup Transfer, 这个论文提出了一种将reference的makeup style迁移到给定用户上面的方法。

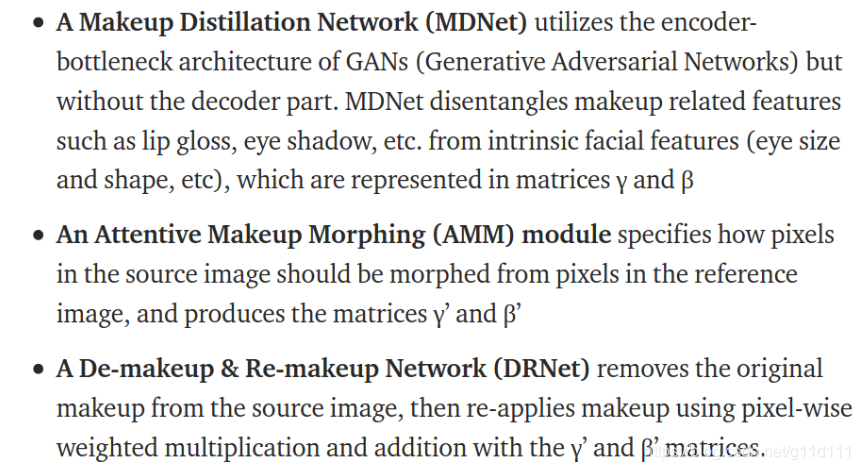

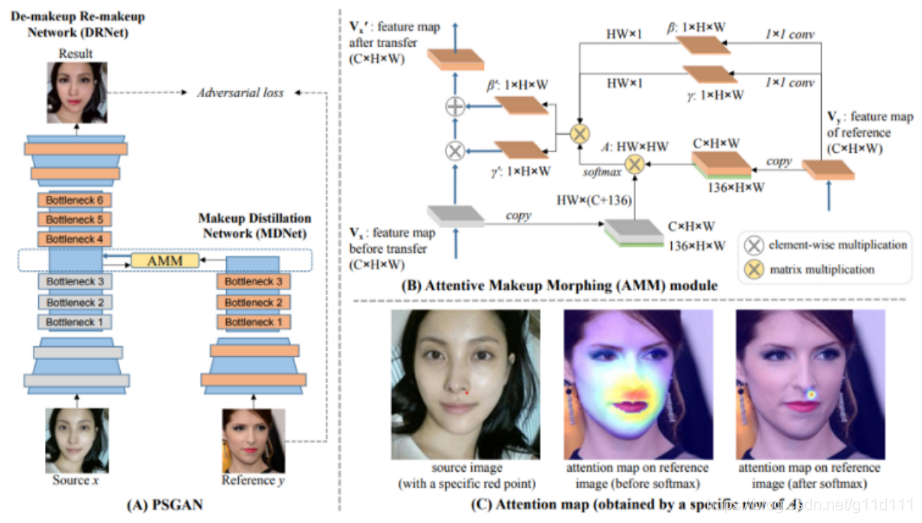

PSGAN由3个网络组成,

可以看到,PSGAN有1个Makeup 蒸馏网络,其目的在于disentangle妆发特征: 比如口红,眼影等.

然后有1个对source image区域进行morphing的AMM网络,最后还有1个De-makeup&Re-makeup网络

用于消除source image的妆容,并pixel-wise的施加新的makeup上去。

其操作都是对matrix

β

\beta

β和

γ

\gamma

γ来进行的。

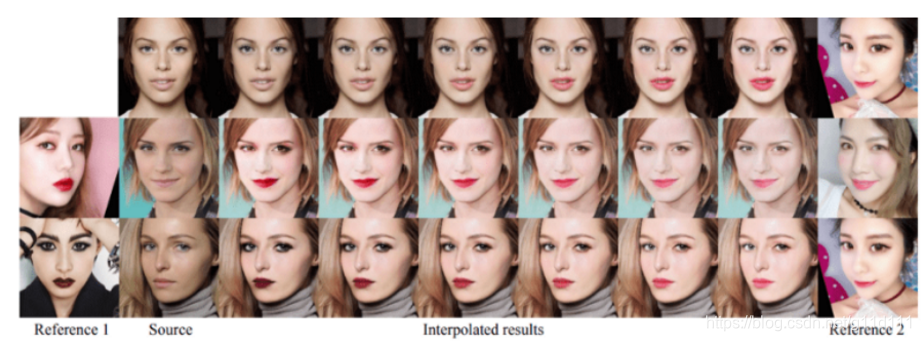

按照论文所说,PSGAN不仅可以从含有不同姿态和面部表情的参考图像(reference)中转换化妆风格,还可以从多个参考图像中处理局部化妆风格和对化妆风格进行插值(interpolate), 以取得渐变效果。

对化妆风格进行插值的结果

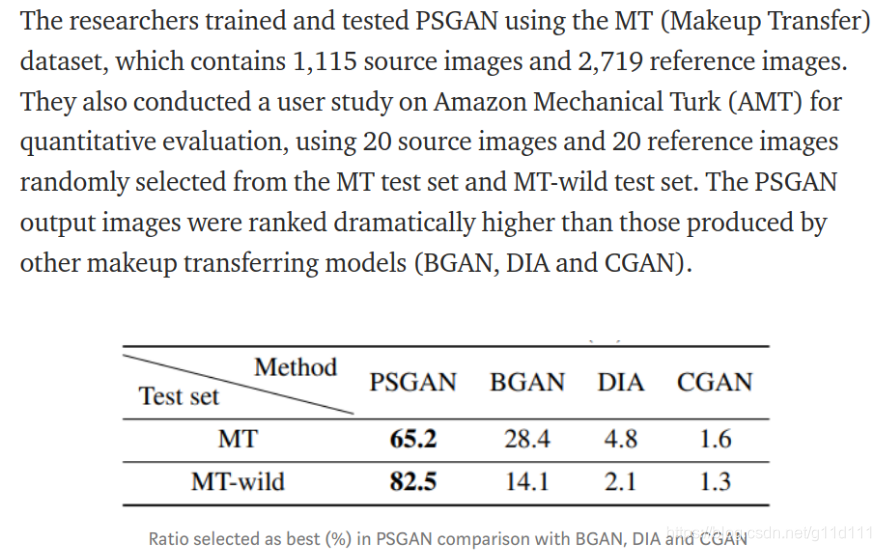

作者们在MT数据集上训练了PSGAN。并在Amazon Mechanical Turk上做了user study(定量分析)——通过使用20个source image和20个reference image (从MT的测试集中随机挑选)。

实验表明,PSGAN输出的图片的效果 远远好于(dramatically higher than) BGAN, DIA和CGAN这些其它的makeup transferring model.

可以看出,虚拟化妆效果的产生可以减少顾客为了尝试新的化妆品而去实体店化妆柜台的需求,并且可以鼓励用户尝试新的外观和新的产品。

这篇论文是北航,中科院,新加坡国立,依图一起做的。

Author: Victor Lu | Editor: Michael Sarazen; Tony Peng

PSGAN是一种创新的GAN模型,能够实现不同姿态和表情的参考图像间的妆容风格迁移,支持局部化妆风格处理及渐变效果,显著优于其他化妆转移模型。

PSGAN是一种创新的GAN模型,能够实现不同姿态和表情的参考图像间的妆容风格迁移,支持局部化妆风格处理及渐变效果,显著优于其他化妆转移模型。

914

914

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?