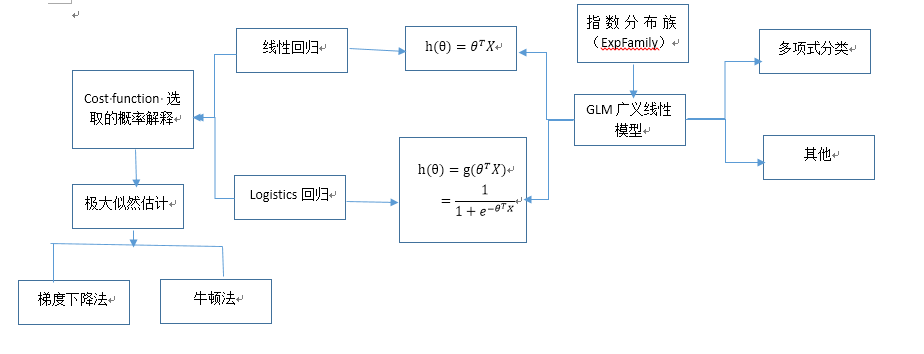

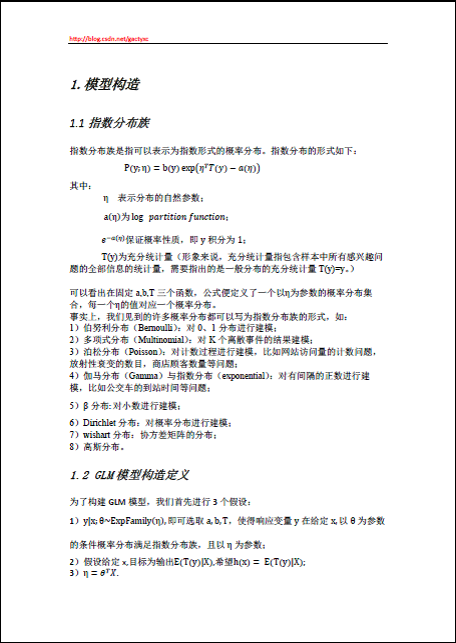

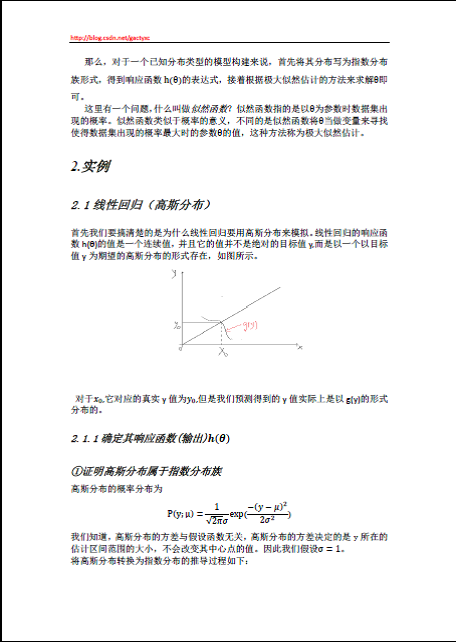

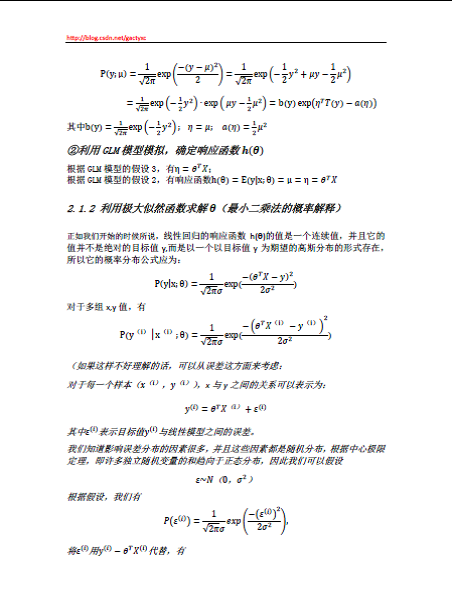

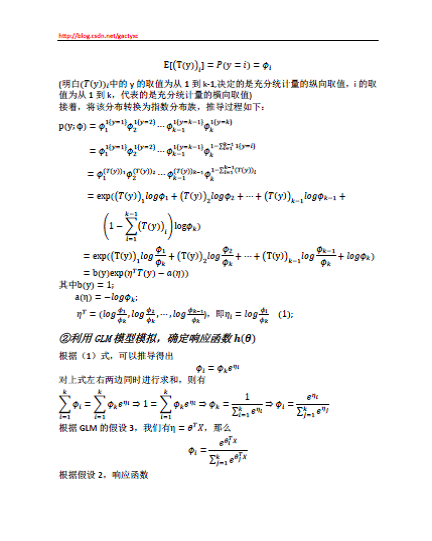

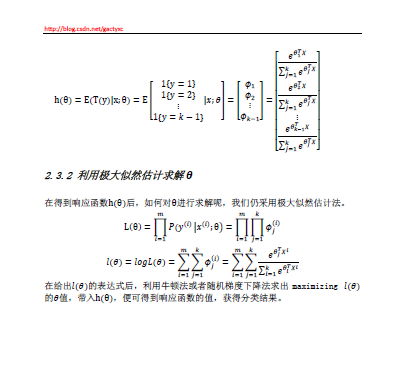

作为一名机器学习的爱好者,最近在跟着Andrew Ng 的 Machine Learning 学习。在讲义的第一部分中,Ng首先讲解了什么叫做监督学习,其次讲了用最小二乘法求解的线性模型,用sigmod函数表示响应函数的logistics回归,接着,利用这两种模型,推出了一种应用十分广泛的指数分布族,在指数分布族的基础上,进行模型的假设,创建了GLM模型,利用这种模型,创建了多项式分布的模型求解(softmax regression),在这中间,还穿插讲了极大似然估计,高斯分布、伯努利分布的cost function函数选择的概率解释,一种新的求解线性模型的算法—局部加权平均法,以及求解函数最值的两种方法:梯度下降法和牛顿法。

但这样存储在脑中的这些东西显得太过杂乱,希望对脑中这些知识进行梳理,能够和同样喜欢机器学习的人交流学习。

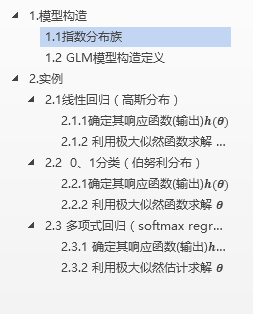

整理目录为

由于在CSDN编辑器上边敲公式太繁琐,因此直接在word里边编辑的,后来转换为图片格式上传了上来。

本文跟随Andrew Ng的课程,从监督学习出发,介绍了线性回归、逻辑回归等模型,并基于此提出了GLM模型。同时,文章涵盖了多项式分布模型、softmax回归、极大似然估计等内容,以及梯度下降和牛顿法等优化算法。

本文跟随Andrew Ng的课程,从监督学习出发,介绍了线性回归、逻辑回归等模型,并基于此提出了GLM模型。同时,文章涵盖了多项式分布模型、softmax回归、极大似然估计等内容,以及梯度下降和牛顿法等优化算法。

2643

2643

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?