深度学习之路

介绍深度学习的相关知识与应用,从入门到逐渐深入

GavinZhou_xd

一名小小程序员的努力,因为热爱,所以坚持

展开

-

LSTM入门

之前一直在搞CNN,现在开始学习RNN,先上手一篇LSTM的入门吧 原文: Understanding LSTM Networks 中文译文地址: 理解长短期记忆网络摘要:作者早前提到了人们使用RNNs取得的显著成效,基本上这些都是使用了LSTMs。对于大多数任务,它们真的可以达到更好的效果!写了一堆方程式,LSTMs看起来很吓人。希望通过这篇文章中一步一步的剖析,能更好理解它们。原创 2017-03-31 15:12:24 · 2369 阅读 · 0 评论 -

深度学习中的优化算法

一般来说,深度学习通过仔细的设计Objective function和constraints来确保优化问题是convex的,从而避开一下通用优化算法的难题。 优化(optimization)说的有点大,因为存在一阶优化(first-order)和二阶(second-order)优化算法。我们常用的优化算法,比如Adam,SGD等其实都是一阶优化算法(基于gradient),这篇写的也是一阶优化算法原创 2017-04-05 18:05:36 · 2864 阅读 · 0 评论 -

验证码破解之一:定长文本验证码

之前写过一篇验证码的破解,地址在这,其实效果不好,有很多朋友来问,其实我已经说了只是个demo;既然如此,就写下文本验证码的破解;本次的主题是定长的,就是验证码的长度是个定值,也是大家在上网过程中遇到的最多的验证码。其实挺简单的,网上也有很多的总结性的文章,基本验证码破解就两个思路(deep learning): 定长类:卷积 + 多个Softmax 不定长类: LS原创 2017-04-03 21:36:30 · 3217 阅读 · 0 评论 -

ResNet && DenseNet(实践篇)

上篇博客说了ResNet和DenseNet的原理,这次说说具体实现ResNetdef basic_block(input, in_features, out_features, stride, is_training, keep_prob): """Residual block""" if stride == 1: shortcut = input else: sho原创 2016-12-05 10:06:28 · 5535 阅读 · 1 评论 -

ResNet && DenseNet(原理篇)

这篇博客讲现在很流行的两种网络模型,ResNet和DenseNet,其实可以把DenseNet看做是ResNet的特例 文章地址: [1]Deep Residual Learning for Image Recognition,CVPR2015 [2]Densely Connected Convolutional Networks,CVPR2016本篇博客不讲论文的内容,只讲主要思想和我自己的原创 2016-12-03 16:29:45 · 30040 阅读 · 4 评论 -

Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning

转载自: http://www.jianshu.com/p/329d2c0cfca9Google Research的Inception模型和Microsoft Research的Residual Net模型两大图像识别杀器结合效果如何?在这篇2月23日公布在arxiv上的文章“Inception-v4, Inception-ResNet and the Impact of Residual Conn转载 2016-11-20 17:23:59 · 2891 阅读 · 0 评论 -

Image Style Transfer Using Convolutional Neural Network(理论篇)

好久没有写博客了,也是惭愧,最近事情比较多,现在抽空写一篇吧今天这篇是关于neual art的,也就是style transfer算法; 文章来源: A Neural Algorithm of Artistic Style, CVPR2015 Image Style Transfer Using Convolutional Neural Networks, CVPR2016前一段时间有一个比较原创 2016-11-12 23:01:51 · 11386 阅读 · 5 评论 -

Batch Normalization

Batch Normalization 学习笔记原文地址:http://blog.csdn.net/hjimce/article/details/50866313作者:hjimce一、背景意义本篇博文主要讲解2015年深度学习领域,非常值得学习的一篇文献:《Batch Normalization: Accelerating Deep Network Training by Reducing转载 2016-09-09 15:14:37 · 1320 阅读 · 0 评论 -

Fully Convolutional Networks for Semantic Segmentation

主要思想传统的做图像分割的方式大概是这样的: 以某个像素点中心取一个区域,取图像块的特征做样本训练分类器,分类结果作为此像素点的结果 这样做确定很明显,比如: 如何确定图像块的大小 从小的图像块(patch)中获得的上下文信息(contex)较少,且极端耗时 FCN的做法是训练一个end-to-end的网络,做pixel-wise的原创 2016-08-05 16:50:27 · 9621 阅读 · 1 评论 -

使用Faster-Rcnn进行目标检测(实践篇)

原理上一篇文章,已经说过了,大家可以参考一下,Faster-Rcnn进行目标检测(原理篇)实验我使用的代码是python版本的Faster Rcnn,官方也有Matlab版本的,链接如下:py-faster-rcnn(python)faster-rcnn(matlab)环境配置按照官方的README进行配置就好,不过在这之前大家还是看下硬件要求吧 For training s原创 2016-07-28 10:42:15 · 79772 阅读 · 92 评论 -

使用Faster-Rcnn进行目标检测

论文笔记:Faster-Rcnn进行目标检测Object Detection发展介绍Faster rcnn是用来解决计算机视觉(CV)领域中Object Detection的问题的。经典的解决方案是使用: SS(selective search)产生proposal,之后使用像SVM之类的classifier进行分类,得到所有可能的目标. 使用SS的一个重要的弊端就是:特别耗时,而且使用像传统的S原创 2016-07-22 17:02:30 · 41764 阅读 · 5 评论 -

NeuralTalk2---自动产生图片的语句描述

最近被逼看了点自然语言处理(NLP)的论文,好吧我看不懂,本来我就不是搞这个方向的,说的我迷迷糊糊的,哎,隔行如隔山啊不过在过程中倒也是收获到了一些东西,比如今天的这篇博客,怎样自动的去产生图片的语句描述???就是: 我给你张图,你给我自动生成描述这张图片的文字具体如下:这个理论说起来实际很高端,涉及到神经网络,自然语言处理等方方面面的知识,推荐几篇论文有兴趣的可以看看: Deep原创 2016-04-01 14:16:25 · 9376 阅读 · 3 评论 -

Caffe上训练使用自己的数据

接着上篇,上篇讲解了怎么在ubuntu下安装Caffe,如果一切没问题的话应该是可以用了,下面自己测试一下。测试mnist首先切换到caffe-master的主目录,mnist是作为一个演示存在于caffe-master/examples/mnist下的,需要三步来运行: <1>获得mnist手写数据库数据$ sh data/mnist/get_mnist.sh<2>根据获得的原始数据建立数据集(原创 2015-08-09 11:52:11 · 18146 阅读 · 17 评论 -

KNN(k-NearestNeighbor)识别minist数据集

KNN算法介绍KNN(K Nearest Neighbors,K近邻 )算法是机器学习所有算法中理论最简单,最好理解的。KNN是一种基于实例的学习,通过计算新数据与训练数据特征值之间的距离,然后选取K(K>=1)个距离最近的邻居进行分类判断(投票法)或者回归。如果K=1,那么新数据被简单分配给其近邻的类。KNN算法算是监督学习还是无监督学习呢?首先来看一下监督学习和无监督学习的定义。对于监督学习,数原创 2015-10-24 11:55:57 · 7919 阅读 · 0 评论 -

正则化方法:L1和L2 regularization、数据集扩增、dropout

转载自CSDN博客: http://blog.csdn.net/u012162613/article/details/44261657正则化方法:防止过拟合,提高泛化能力在训练数据不够多时,或者overtraining时,常常会导致overfitting(过拟合)。其直观的表现如下图所示,随着训练过程的进行,模型复杂度增加,在training data上的error渐渐减小,但是在验证集上的erro转载 2016-07-30 11:42:03 · 1144 阅读 · 0 评论 -

机器学习基本概念-3

前两篇博客介绍了ML中的一些基本概念,还有一些很重要的概念也还没有说到,作为入门教程还是需要直观点,所以先举个最简单的例子线性回归(linear regresion),接下来引出后续的概念.从线性回归说起线性回归很简单,给定一定的输入X,输出相应的输出Y,输出是输入的线性函数.这里使用Andrew Ng ML课程中的线性回归的例子,假设是单变量的linear regression.这里有一些约定,以原创 2016-08-30 15:06:30 · 2194 阅读 · 1 评论 -

机器学习基本概念-2

Capacity上篇博客说过,ML的central challenge就是model的泛化能力,也就是generalization. The ability to perform well on previously unobserved inputs is called generalization. 那什么是Capacity呢?通俗的说就是你的model能够很好地表达exam原创 2016-08-28 13:08:42 · 3820 阅读 · 0 评论 -

机器学习基本概念-1

Learning algorithmML中的算法无疑都是学习型的算法,那么什么才是学习型算法(learning algorithm)呢? 机器学习大牛Bengio给出的解释是: A machine learning algorithm is an algorithm that is able to learn from data. 这里的learn,Mitchell(1997)原创 2016-08-27 23:13:34 · 2570 阅读 · 0 评论 -

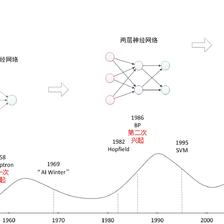

Machine Learning基础入门

断断续续接触机器学习也差不多有1年多的时间了,论文看了一些,教程也看了一些,也动手写过一些东西,自认略微优点心得吧(大牛莫笑) 之前写的也很零散,所以这次就当做总结吧,也算是给自己的一个参考! 写的很浅显,主要追求通俗易懂,当然也是我的水平有限,目标就是做最好的入门资料[捂脸],有问题欢迎讨论!声明:本专栏是在参考了网上众多资料和大牛的博客下整理收录的,如有侵权请联系作者删除,谢谢!发展历史这个原创 2016-08-26 15:09:27 · 3461 阅读 · 0 评论

分享

分享