1:Boosting

Boosting是一个迭代提升的过程,所以它肯定是串行的算法(尽管xgboost可以在节点分裂属性选择上做并行计算)。基于训练集,先训练弱学习器,然后根据前一个弱学习器分错的样本,改变样本的概率分布构成新的训练集,从而可以训练出一个更强的学习器。这样反复迭代提升,就能得到一系列分类器。最后,将这些分类器组合起来,就能构成一个很强的学习器。

Adaboost算法是“加性模型”,通过基学习器的线性组合H(x)=a1ht(x)+...aTht(x)来最小化指数损失函数,算法流程看看本:P174页。

AdaBoost的主要思想就是在不改变训练数据的情况下,通过在迭代训练弱学习器中,不断提升被错分类样本的权重(也就是使被错分的样本在下一轮训练时得到更多的重视),不断减少正确分类样本的权重。最后通过加权线性组合M个弱分类器得到最终的分类器,正确率越高的弱分类器的投票权数越高,正确率低的弱分类器自然投票权数就低。

2:GBDT

GBDT的基本原理是boosting里面的boosting tree(提升树),并且使用梯度提升。GBDT是回归树不是分类树,gradient boost需要按照损失函数的梯度近似的拟合残差,因此是回归树。Gradient Boosting是一种Boosting的方法,其与传统的Boosting的区别是,每一次的计算是为了减少上一次的残差(residual),而为了消除残差,可以在残差减少的梯度(Gradient)方向上建立一个新的模型。所以说,在Gradient Boosting中,每个新的模型的建立是为了使得之前模型的残差往梯度方向减少,与传统Boosting对正确、错误样本进行加权有着很大的区别。这个梯度代表上一轮学习器损失函数对预测值求导。与Boosting Tree的区别:Boosting Tree的适合于损失函数为平方损失或者指数损失。而Gradient Boosting适合各类损失函数(损失函数为:平方损失则相当于Boosting Tree拟合残差、损失函数为:使用指数损失则可以近似于Adaboost,但树是回归树)

GBDT是一种迭代的决策树算法,该算法由多棵决策树构成,GBDT是用来做回归预测的,但是调整之后也能做分类。

回归树:回归树的每一个节点有一个预测值,改值为这个节点多有值的平均值。分之时穷举每个特征的每个阈值找最好的分割点,但衡量标准不再是最大熵,而是最小平方误差。即预测出错的人越多错的就越离谱。通过最小化平方误差来找到最可靠的分支依据。枝直到每个叶子节点上人的年龄都唯一或者达到预设的终止条件(如叶子个数上限),若最终叶子节点上人的年龄不唯一,则以该节点上所有人的平均年龄做为该叶子节点的预测年龄。

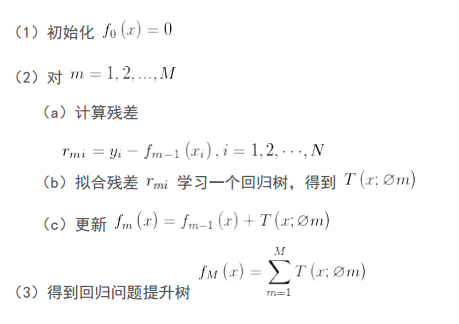

提升树的算法流程:

提升树利用加法模型和前向分步算法实现学习的优化过程。当损失函数是平方损失和指数损失函数时,每一步的优化很简单,如平方损失函数学习残差回归树。

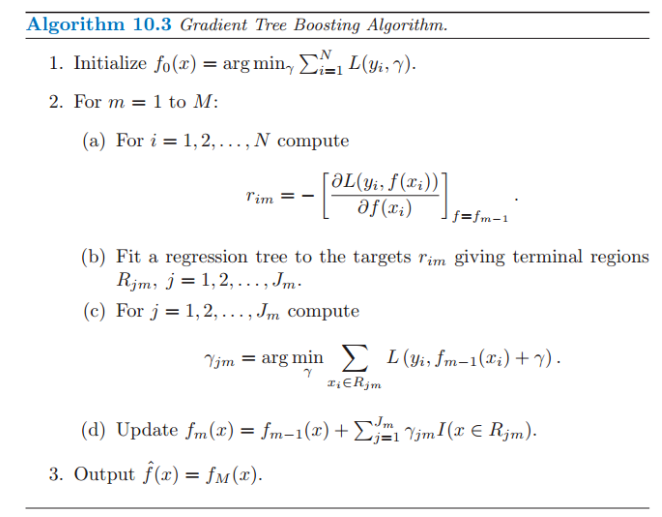

GBDT算法的流程:

3:xgboost

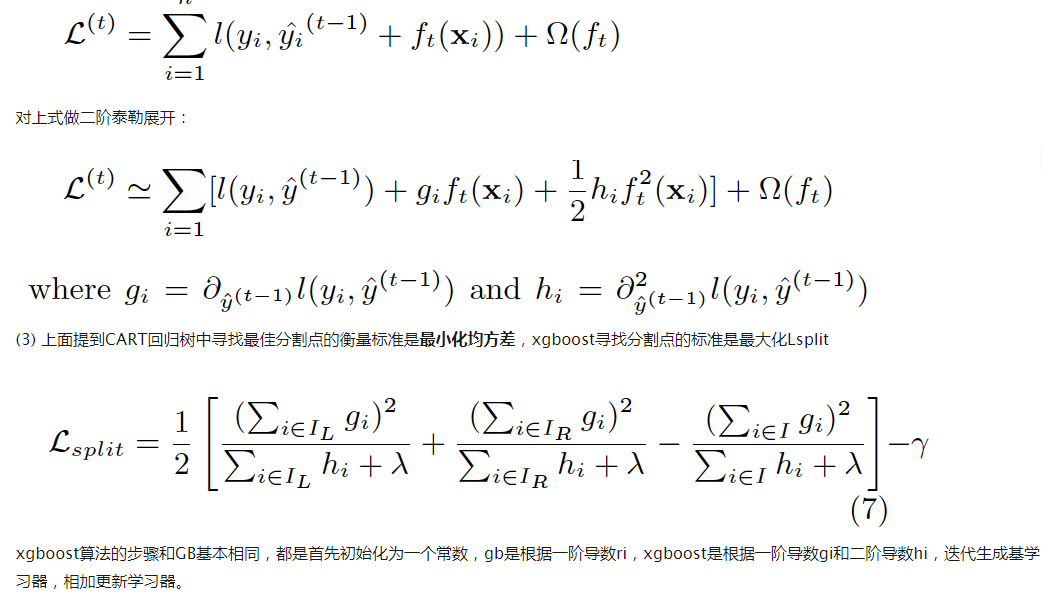

1.损失函数是用泰勒展式二项逼近,而不是像gbdt里就是一阶导数

2.对树的结构进行了正则化约束,防止模型过度复杂,降低了过拟合的可能性

3.节点分裂的方式不同,gbdt是用的gini系数,xgboost是经过优化推导后的

GB中使用Loss Function对f(x)的一阶导数计算出伪残差用于学习生成fm(x),xgboost不仅使用到了一阶导数,还使用二阶导数。第t次的loss:

728

728

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?