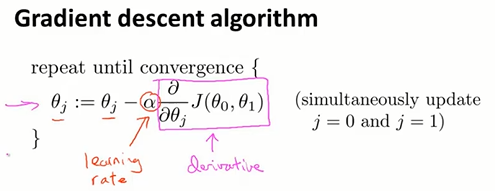

梯度下降

:= assignment 赋值 a:=b 将b的值赋给a

= 判断

α

\alpha

α learning rate 学习率 影响梯度下降的速度

同步更新

Θ

1

\Theta1

Θ1和

Θ

2

\Theta2

Θ2

公式:

倒数项会越来越小 因此不用刻意变

α

\alpha

α的值

batch: 全览整个训练集

batch: 全览整个训练集

单词:

slope 斜率

converge 收敛

diverge 发散

derivative 导数

1664

1664

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?