市面上的统一回答是:

由于Transformer的注意力机制无法捕获位置信息 ,因此需要引入位置编码。

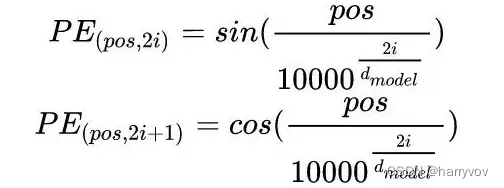

其公式为:

通过计算不难发现位置编码的值基本分布在-1到1之间

而时间序列输入归一化以后值也分布在-1到1之间,假设输入值为0.8,若加上pe的值-0.2以后为0.6很大概率会影响输入值大小,对预测值不会产生影响吗?

市面上的统一回答是:

由于Transformer的注意力机制无法捕获位置信息 ,因此需要引入位置编码。

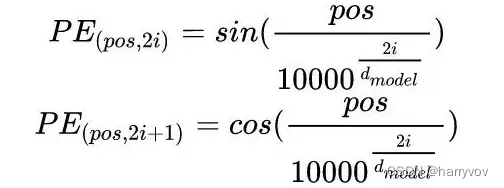

其公式为:

通过计算不难发现位置编码的值基本分布在-1到1之间

而时间序列输入归一化以后值也分布在-1到1之间,假设输入值为0.8,若加上pe的值-0.2以后为0.6很大概率会影响输入值大小,对预测值不会产生影响吗?

1541

1541

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?