1-安装ollama和运行模型

安装ollama,自动安装到C盘

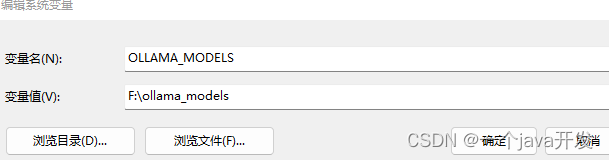

配置ollama环境变量,调整模型存放的位置

右下角退出ollama程序,然后再次启动

ollama run llama3

此时模型会被自动下载到环境变量配置的地址,并且启动一个对话界面

输入/bye退出对话界面

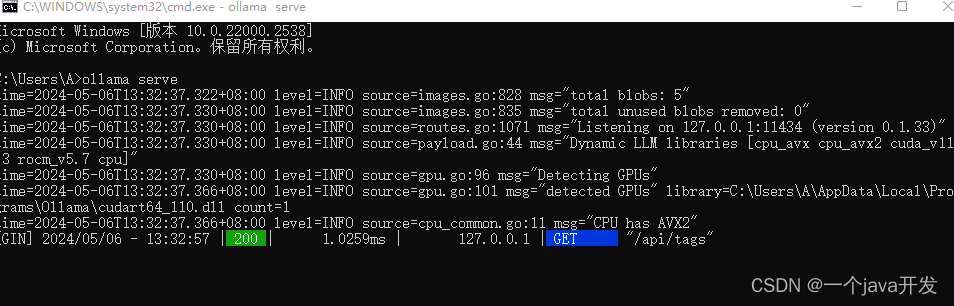

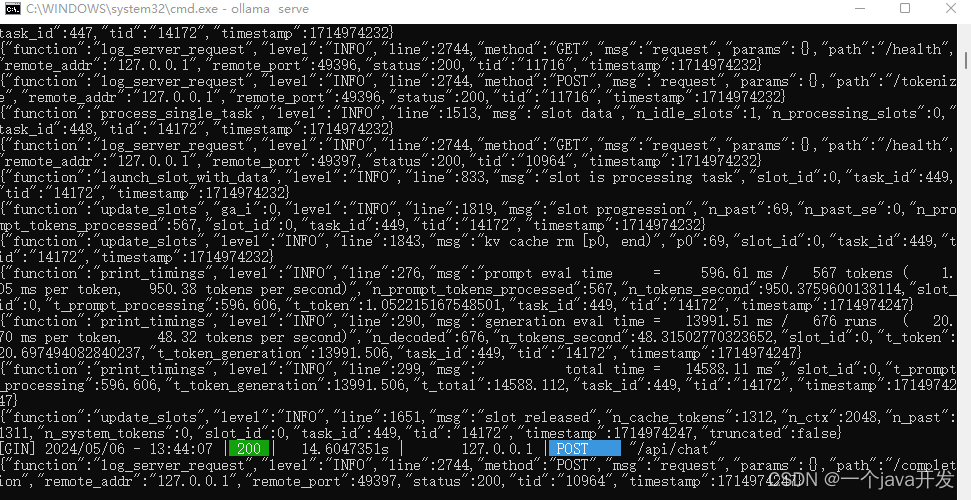

将ollama启动成一个后端服务器ollama serve

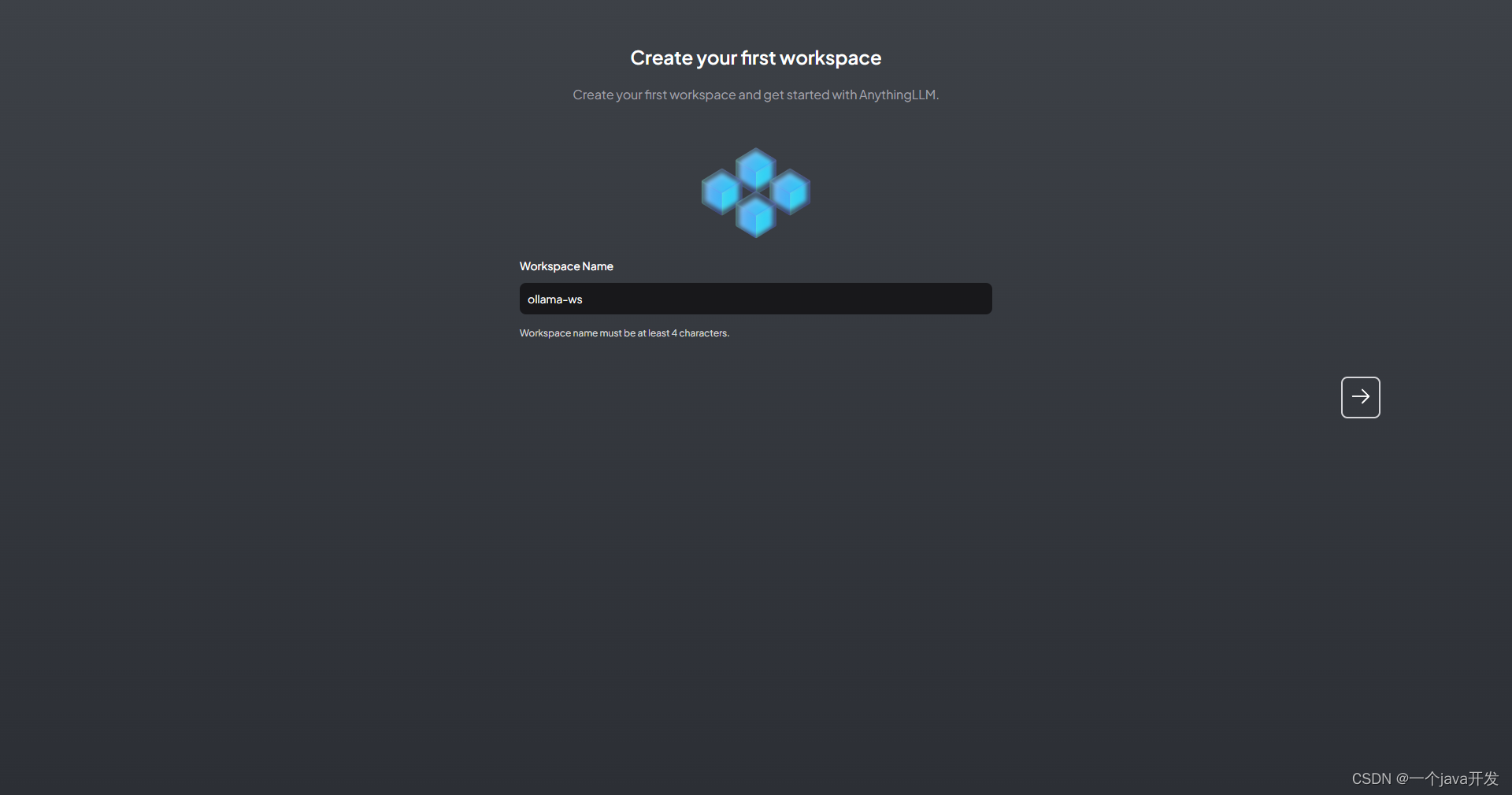

2-下载安装anythingllm

下载安装anythingllm

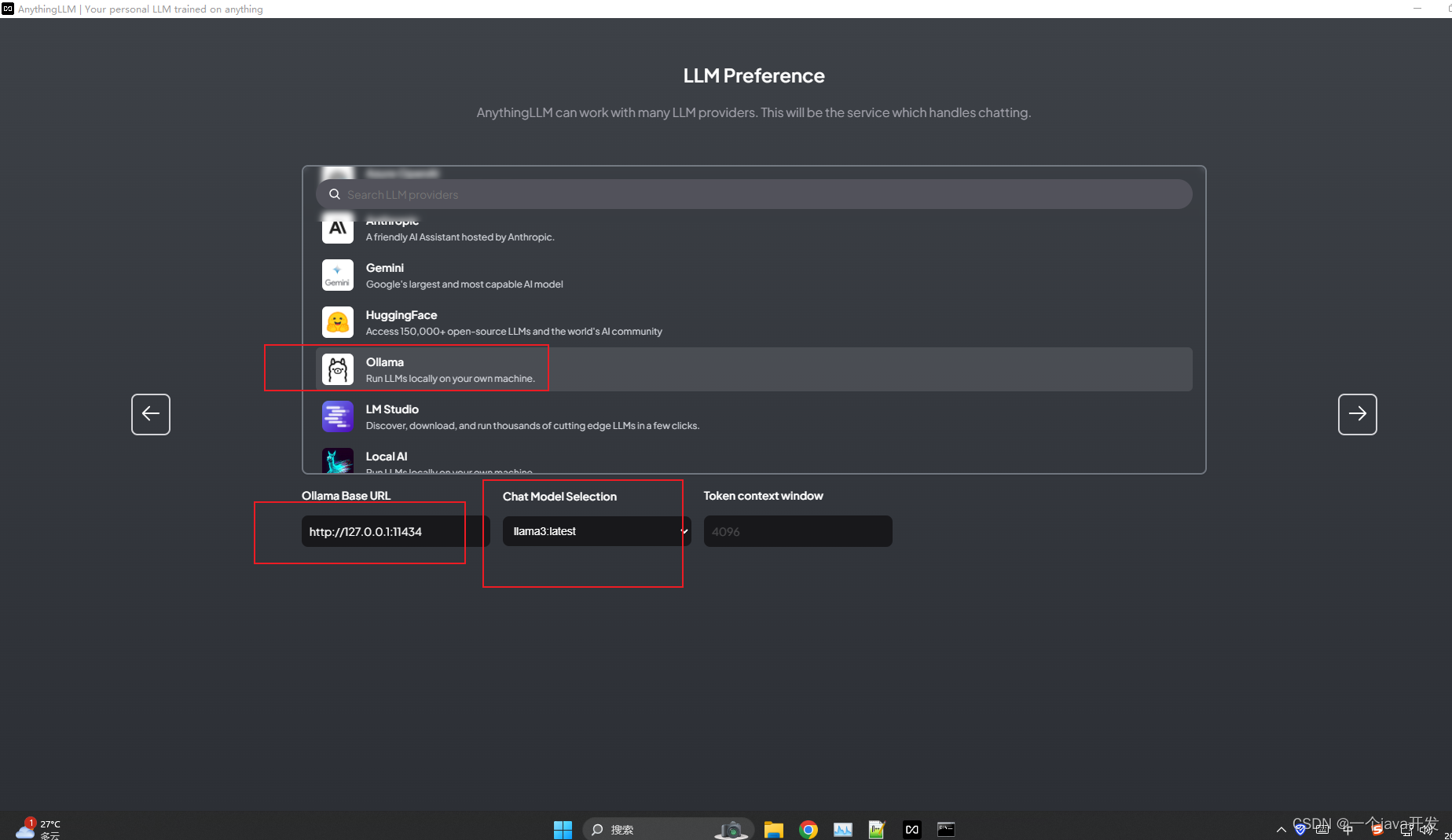

安装完成后打开,输入ollma服务器的地址,然后可以选择使用ollama中的哪个模型

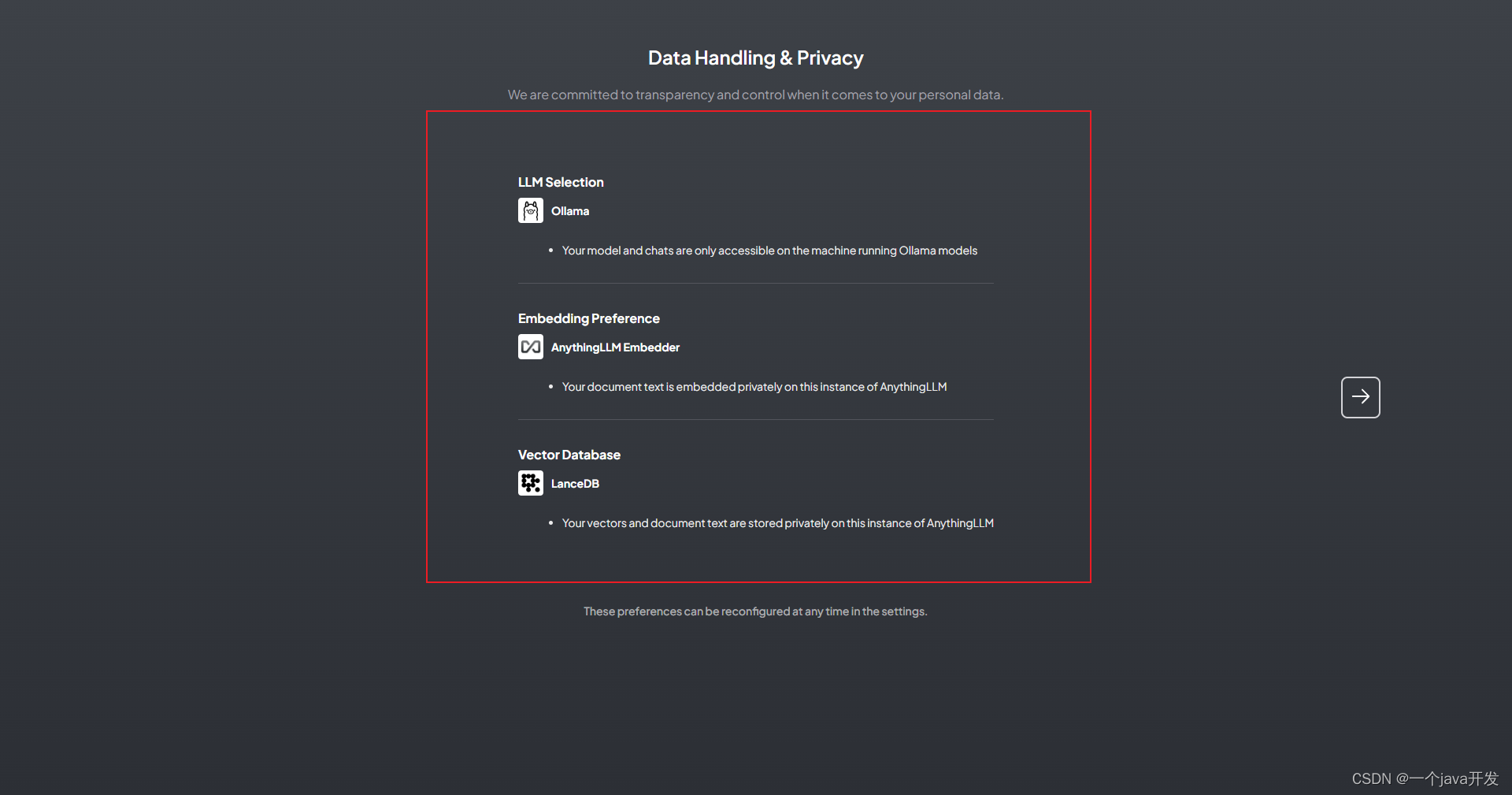

可以看到默认的向量数据库配置

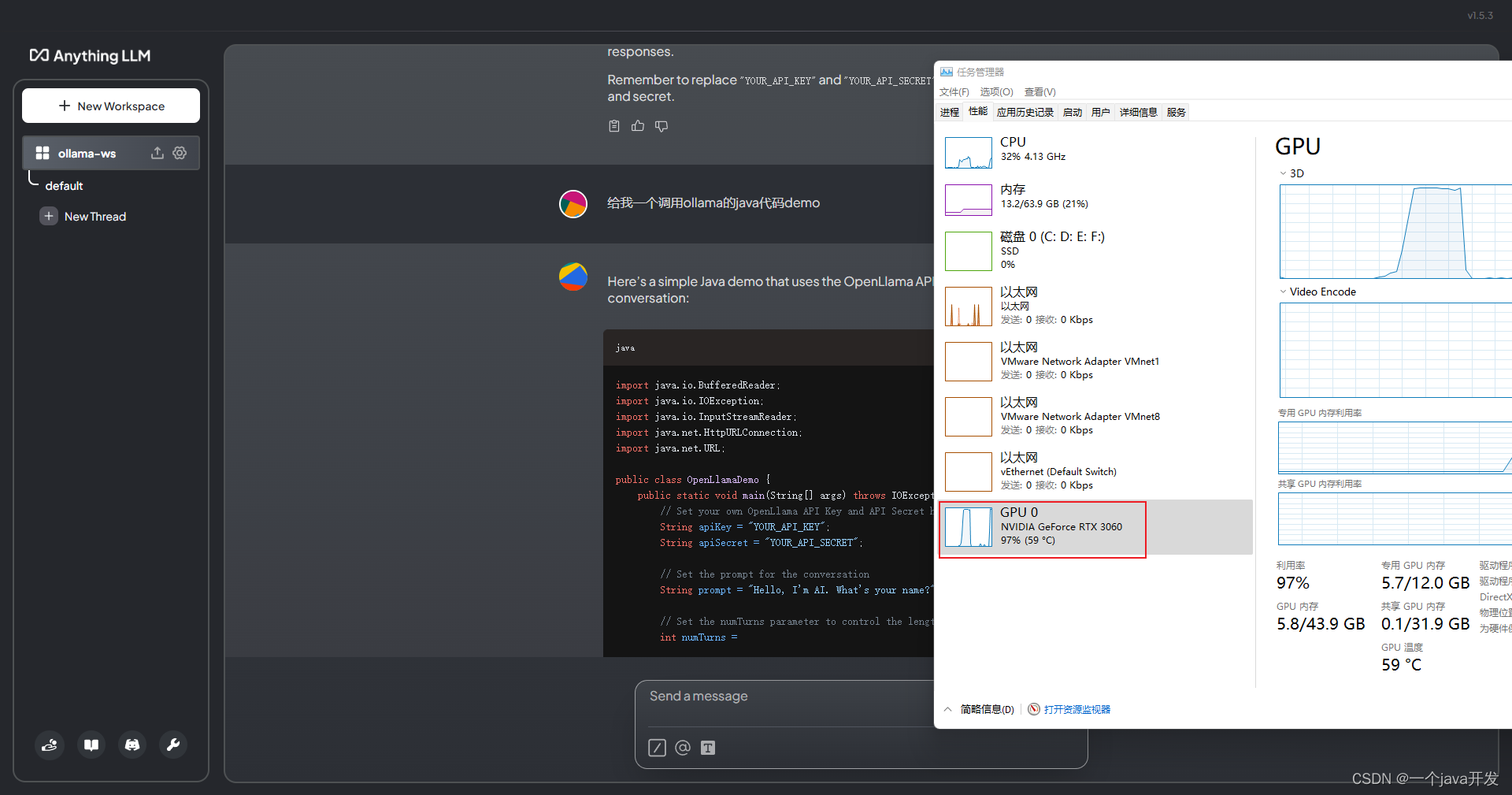

测试下文本问答,可以看到走的GPU,并且可以在ollama服务端看到了来自anythingllm的请求日志

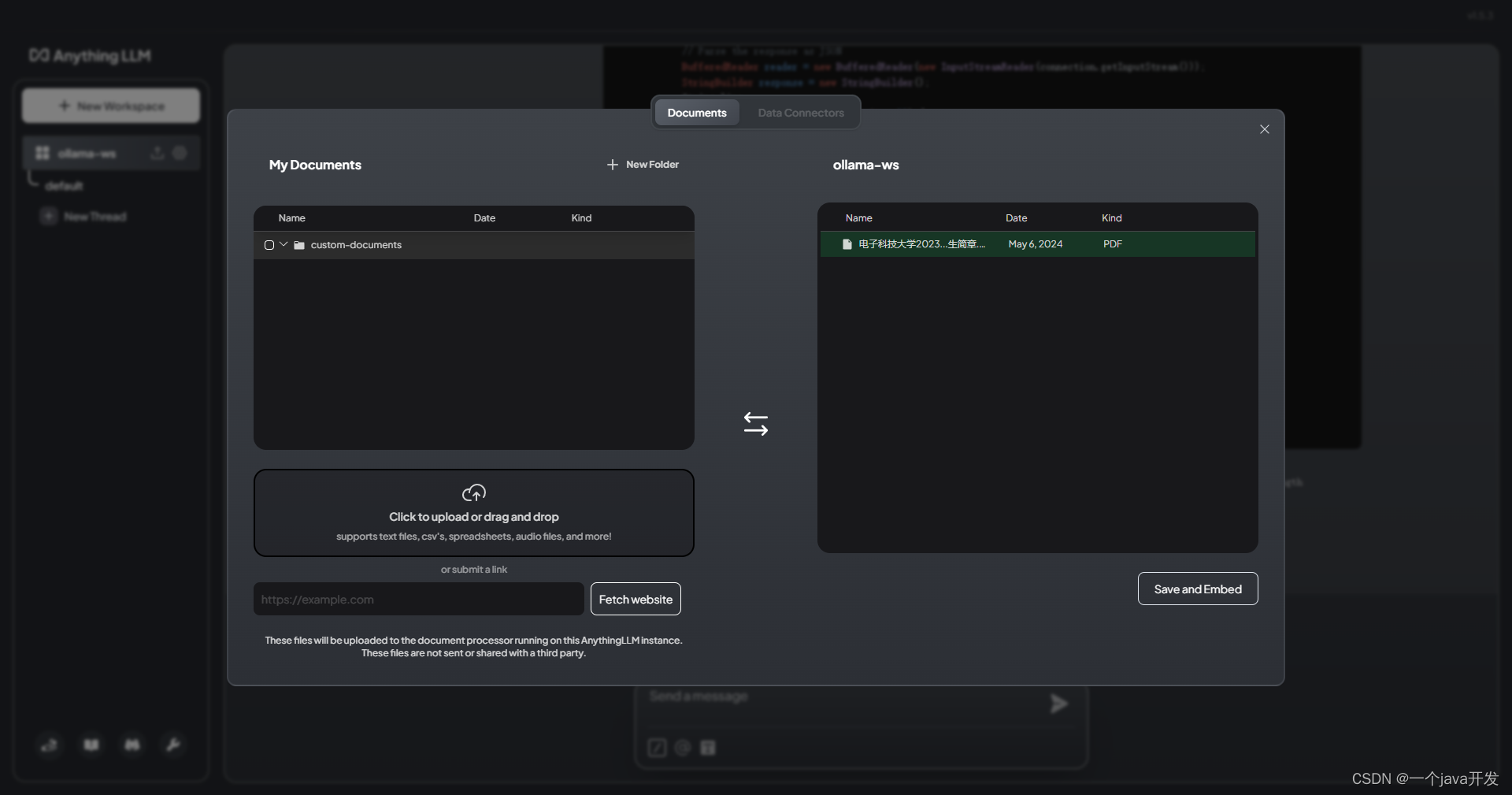

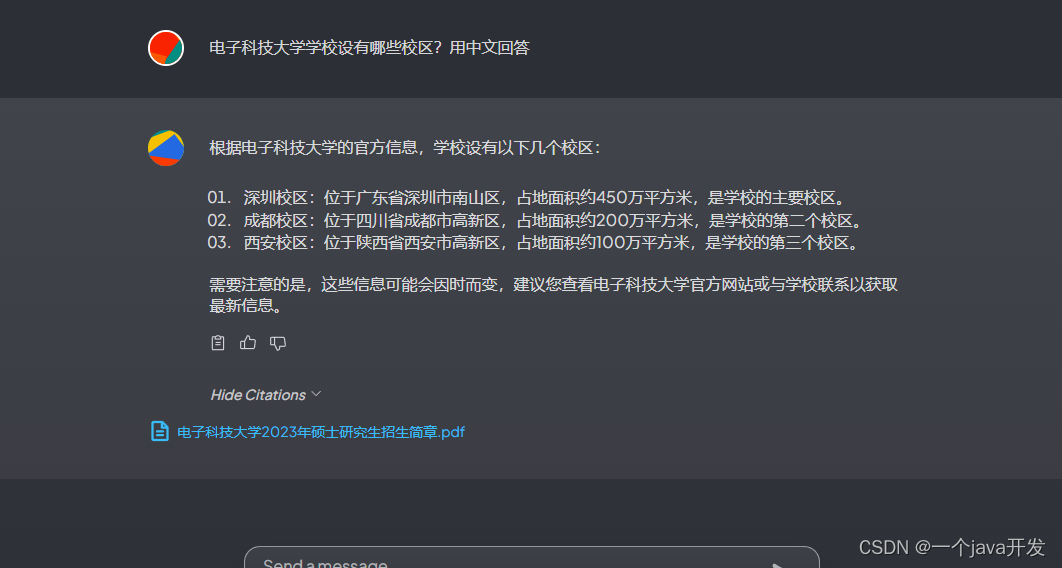

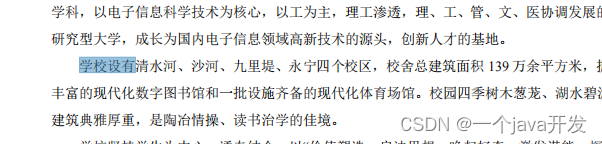

3-矢量数据库。本地文档知识库

上传文件并且move to workspace

save and embed

根本不准,可能是文档不太行。

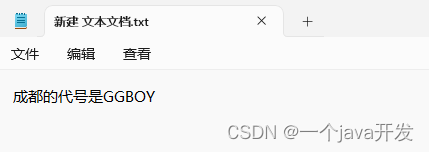

自己写手写个TXT吧,我在TXT里写的内容为

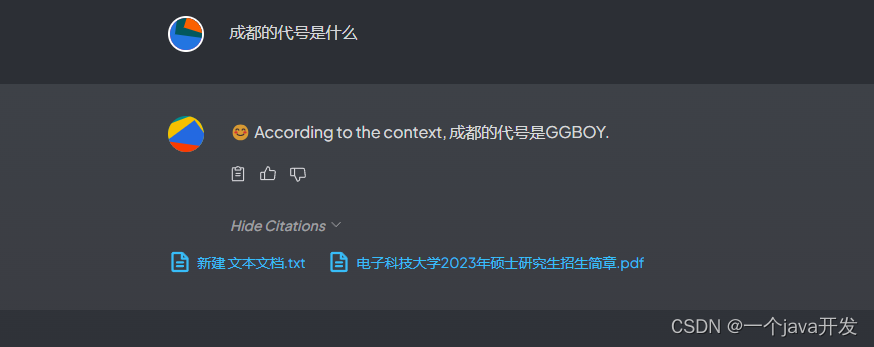

上传TXT并向量化

然后再问,可以发现这下准了,所以准确度还是对投入的文档有一定的准确度要求的。

本文介绍了如何安装和配置Ollama及anythingllm,展示如何将模型部署为后端服务器,以及利用它们进行文本问答和本地文档向量化。文章强调文档质量对准确度的影响。

本文介绍了如何安装和配置Ollama及anythingllm,展示如何将模型部署为后端服务器,以及利用它们进行文本问答和本地文档向量化。文章强调文档质量对准确度的影响。

705

705

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?