在AutoDL上部署百川2大模型

AUTO DL相关

- 选择容器实例

- 租用新实例

- 选择配置

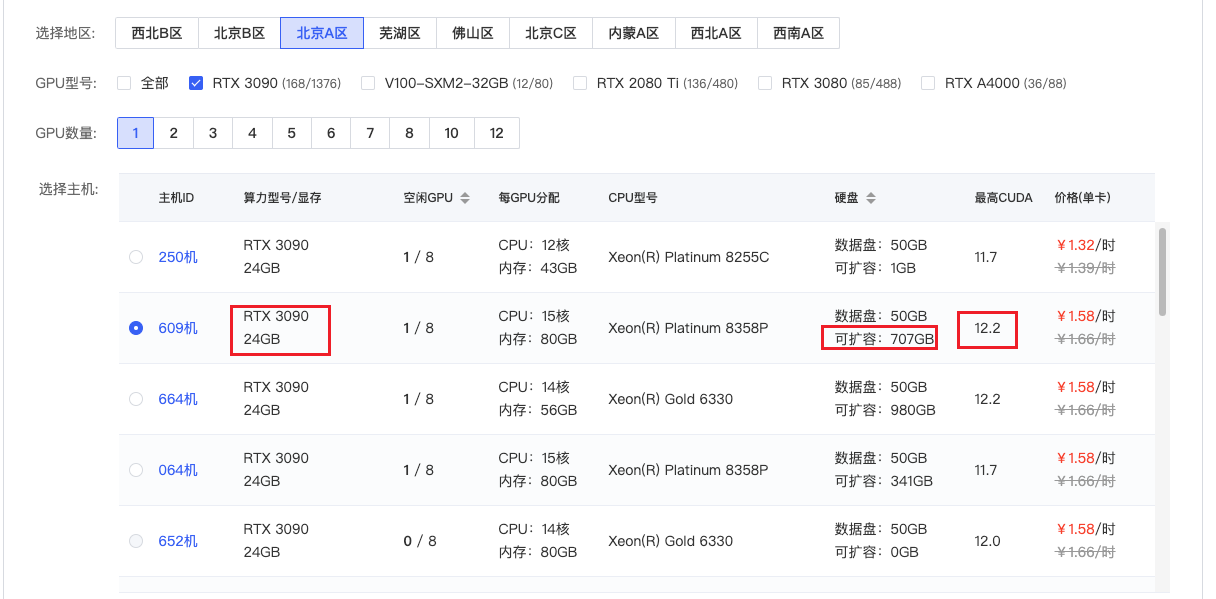

我这里选择3090 , 硬盘尽量选择可以扩容的 , CUDA版本尽量高一点

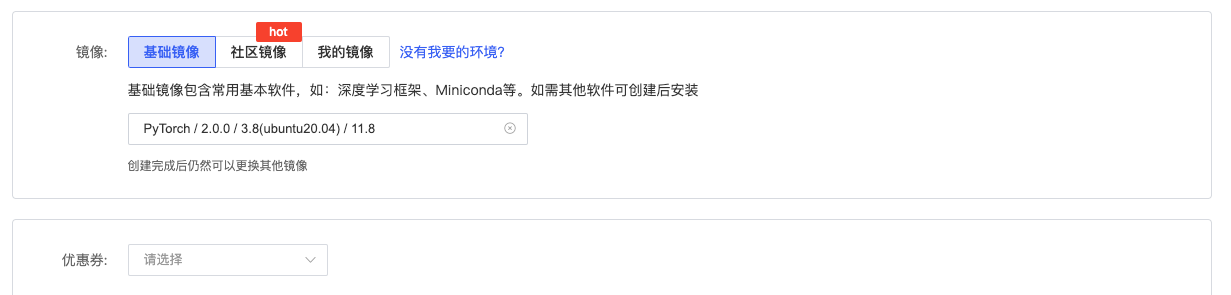

- 选择镜像

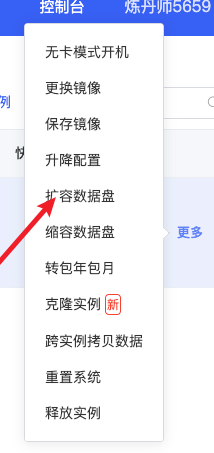

- 先将机器关机

- 先扩容一下数据盘

50G就可以了

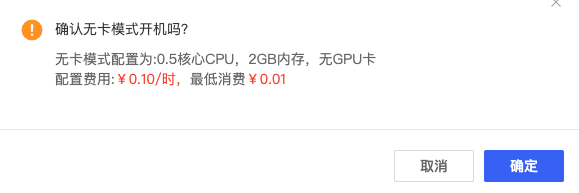

- 然后选择无卡模式开机

- 因为无卡模式下开机费用会变低

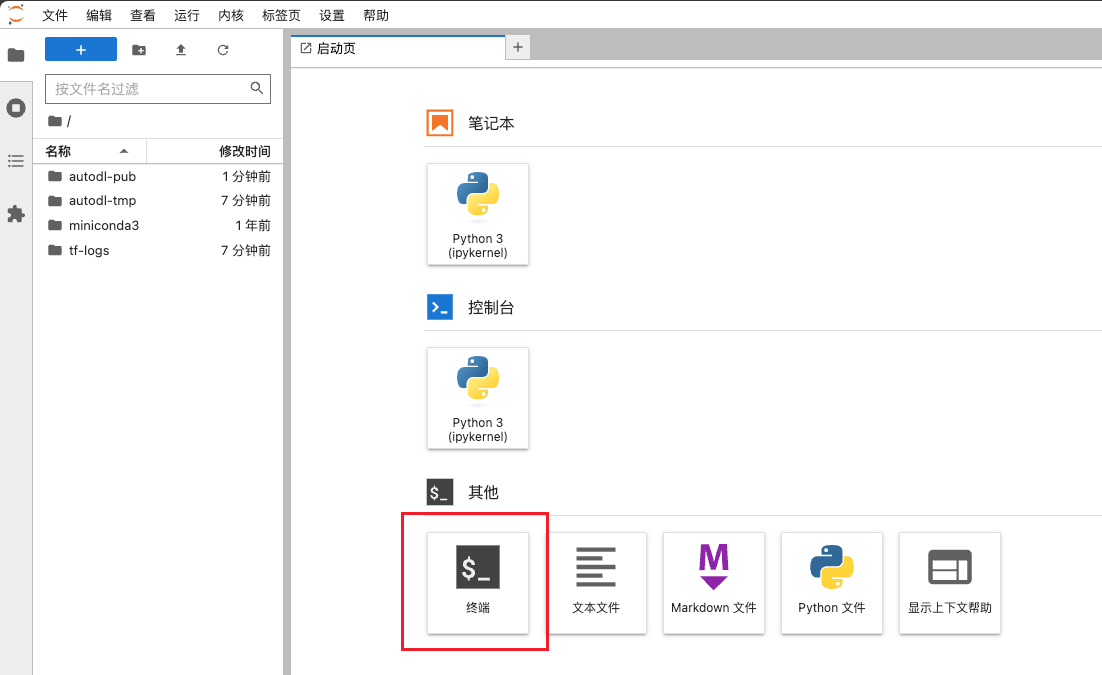

- 使用JupyterLab进行服务器配置

- 选择终端

终端配置

# 进入到AutoDL提供的数据盘

cd autodl-tmp

# 垃取Baichuan2的代码

git clone https://github.com/baichuan-inc/Baichuan2.git

# 进入文件夹

cd Baichuan2

# 创建一个文件夹,用于存放模型

mkdir model

# 更新apt

apt-get update

# 安装git-lfslfs

apt-get install git-lfs

# 初始化git

git init

# 确认lfs是否安装

git lfs install

# 垃取modelscope平台的Baichuan2-13B模型文件

git lfs clone https://www.modelscope.cn/baichuan-inc/Baichuan2-13B-Chat.git

- 模型下载完毕后 , 把服务器关机然后带上显卡一起启动

# 进入目录

cd /root/autodl-tmp/Baichuan2

# 安装运行模型所需要的依赖

pip install -r requirements.txt

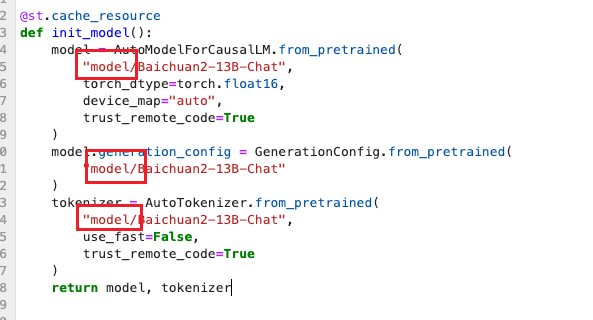

- 配置web_demo脚本

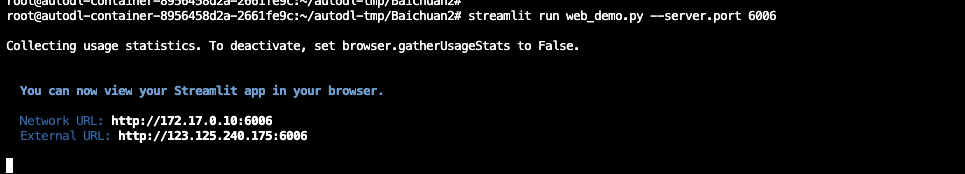

# 运行web_demo 端口暴露为 6006

streamlit run web_demo.py --server.port 6006

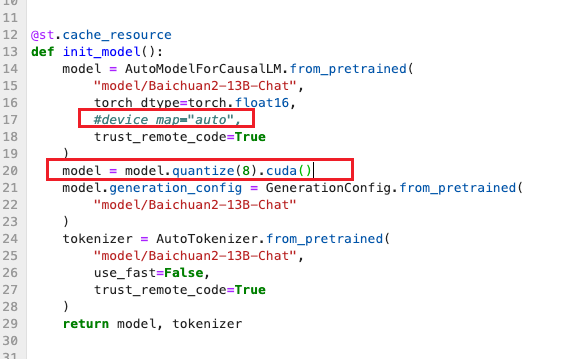

量化模型

重新启动

streamlit run web_demo.py --server.port 6006

本地访问

# 正常代理

ssh -CNg -L 6006:127.0.0.1:6006 root@connect.beijinga.seetacloud.com -p 42420

# 后台代理

ssh -f -CNg -L 6006:127.0.0.1:6006 root@connect.beijinga.seetacloud.com -p 42420

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?